Jak filmy generowane przez AI napędzają rosyjską dezinformację w sieci

Źródło zdjęcia, Social Media

- Autor, Daria Mosolova

- Stanowisko, BBC Monitoring

- Czas czytania: 5 min

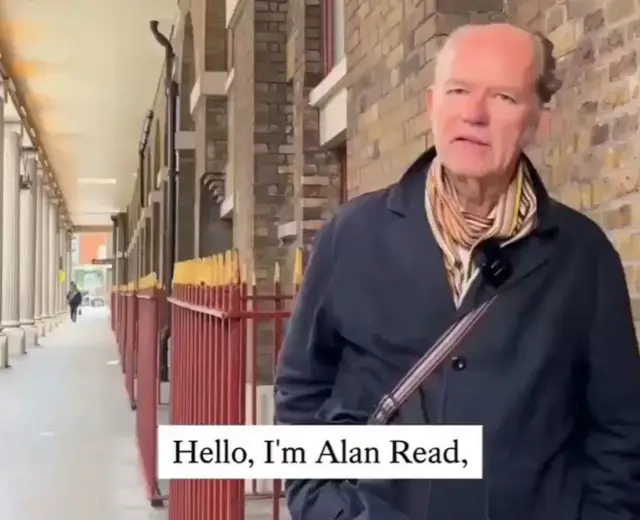

Jak wielu regularnych użytkowników mediów społecznościowych, profesor Alan Read z King's College London nie przywiązywał większej wagi do sporadycznych deepfake'ów pojawiających się na jego tablicy.

Czasem je zgłaszał, innym razem po prostu przewijał dalej. Aż pewnego dnia nieznane konto oznaczyło go w filmie przedstawiającym jego własną twarz.

W nagraniu syntetyczny głos — niemal nieodróżnialny od głosu prof. Reada — wygłaszał upolitycznioną tyradę przeciwko prezydentowi Francji Emmanuelowi Macronowi, krytykując jego oraz innych zachodnich przywódców jako „znajdujących się na pokładzie Titanica z napisem 'Unia Europejska' na kadłubie".

„Niemal wszystko w tym nagraniu jest oburzające i trudne do wysłuchania" — powiedział BBC Read, doświadczony teatrolog, który nie ma żadnych powiązań z polityką.

„To brzmi jak coś… całkowicie mi obcego."

Awatar niczego nieświadomego prof. Reada pojawił się w nowej fali powiązanych z Rosją syntetycznych nagrań, które w ostatnich miesiącach zalały media społecznościowe, wzbudzając obawy ekspertów ds. bezpieczeństwa, że Zachód musi przygotować się na walkę z wpływami Kremla na froncie sztucznej inteligencji.

„To, co obserwujemy, to nie tylko wzrost liczby deepfake'ów, ale zmiana w sposobie wytwarzania wpływu," powiedział Chris Kremidas-Courtney, analityk ds. obrony i bezpieczeństwa z think tanku European Policy Centre.

„Mamy do czynienia z systemami zdolnymi generować… perswazję na masową skalę, za grosze. To rewolucja w wywieraniu wpływu politycznego, a nasze obecne mechanizmy zarządzania nie są na nią gotowe."

Nagrania, z których część osiąga setki tysięcy wyświetleń, podważają wiarygodność instytucji UE i oskarżają rząd w Kijowie o korupcję — w czasie, gdy zabiega on o wsparcie finansowe zachodnich sojuszników, by kontynuować walkę w piątym roku pełnoskalowej inwazji Rosji.

Nasilenie tego zjawiska nastąpiło kilka miesięcy po tym, jak OpenAI udostępniło Sora2, najnowszą wersję oprogramowania do generowania wideo, która znacząco zwiększyła realizm tworzonych materiałów.

Źródło zdjęcia, AFP via Getty Images

Konkurując o udział w rynku w cieniu technologicznego giganta, liczne aplikacje drugiego rzędu zaczęły przyciągać klientów poprzez obniżanie cen lub rezygnację z zabezpieczeń, takich jak znaki wodne, którymi Sora2 oznacza swoje filmy, aby odróżnić je od prawdziwych nagrań.

„Muszą przyciągnąć użytkowników," powiedział rosyjski ekspert ds. AI Arman Tuganbaev, dodając, że podczas gdy OpenAI stara się blokować próby tworzenia filmów z udziałem konkretnych osób, „aplikacje drugiej kategorii dają taką możliwość".

OpenAI poinformowało BBC, że podejmuje działania wobec kont angażujących się w zwodniczą aktywność mającą na celu wyrządzenie szkody, w tym fałszywe przypisywanie pochodzenia treści.

Technologiczny wyścig napędził stały wzrost zarówno liczby, jak i zaawansowania zagranicznych kampanii wpływu, wzmacniając pozycję Rosji w jej hybrydowym konflikcie z Zachodem.

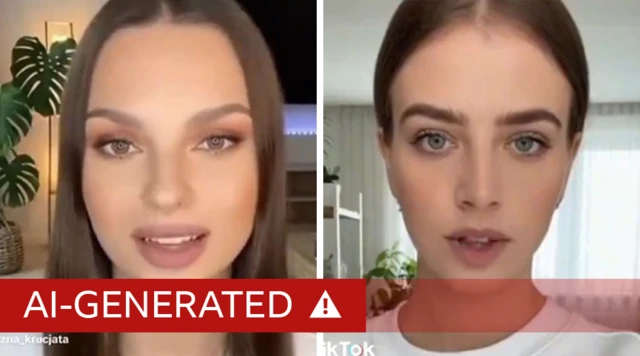

Pod koniec grudnia fala wygenerowanych przez AI nagrań stała się viralem na TikToku. Przedstawiały młode Polki wzywające do „Polexitu", czyli wyjścia Polski z UE.

„Nie ma wątpliwości, że to rosyjska dezinformacja," powiedział Adam Szłapka, rzecznik polskiego rządu. „Jeśli ktoś przyjrzy się uważnie, dostrzeże w tych nagraniach rosyjską składnię."

Polska wezwała Komisję Europejską do zbadania sprawy TikToka.

TikTok, który usunął nagrania i konta, które je opublikowały, poinformował, że w 2025 r. zlikwidował ponad 75 zamaskowanych operacji wpływu na całym świecie.

Źródło zdjęcia, Social media

W Wielkiej Brytanii parlamentarzyści dyskutowali o obawach, że rosyjskie deepfake'i mogą wpłynąć na lokalne wybory w maju.

„Widzieliśmy ich szerokie zastosowanie w wyborach na całym świecie, więc nie ma powodu zakładać, że Wielka Brytania byłaby wyjątkiem," powiedział Vijay Rangarajan, dyrektor generalny brytyjskiej Komisji Wyborczej.

Brytyjska ustawa o bezpieczeństwie w internecie nie klasyfikuje wprost dezinformacji jako zagrożenia.

Nakłada jednak na platformy obowiązek usuwania treści, co do których można udowodnić, że stanowią zagraniczną operację wpływu — proces ten często trwa zbyt długo w środowisku online, gdzie nagrania mogą stać się popularne w ciągu kilku godzin.

Ustalenie źródła tych materiałów jest trudne, ale zachodni badacze wskazują na wspólne cechy, od stylu po schematy dystrybucji, które łączą je ze zorganizowanymi jednostkami dezinformacyjnymi powiązanymi z Kremlem.

Jedna z kampanii, nazwana Matrioszka lub Operation Overload, miała stać za falą syntetycznych nagrań podważających wiarygodność prezydent Mołdawii Mai Sandu podczas jej kampanii wyborczej w 2025 r.

NewsGuard, organizacja monitorująca dezinformację w internecie, poinformowała, że dostrzegła wspólne wzorce sugerujące, iż ta sama sieć prawdopodobnie odpowiadała za nagranie z udziałem profesora Reada.

Nazwa operacji „matrioszka" pochodzi od rosyjskich lalek i odzwierciedla jej metodę działania: pierwotne fałszywe twierdzenie jest otaczane kolejnymi warstwami udostępnień z nieprawdziwych, dawnych lub zhakowanych kont w mediach społecznościowych.

W przeciwieństwie do tradycyjnych rosyjskich mediów propagandowych, takich jak RT czy Sputnik — które Zachód szybko objął sankcjami na początku inwazji na Ukrainę — takie kampanie „zapewniają poziom… wiarygodnego zaprzeczenia, który utrudnia przeciwdziałanie ich wpływowi", powiedziała Sophie Williams-Dunning, badaczka cyberbezpieczeństwa i technologii z think tanku Royal United Services Institute.

Badacze z Clemson University powiązali odrębną sieć, nazwaną Storm-1516 przez Microsoft Threat Analysis Centre, z weteranami kremlowskiej „fabryki trolli". Była ona prowadzona przez Jewgienija Prigożyna, przywódcę paramilitarnej Grupy Wagnera, przed jego śmiercią w katastrofie lotniczej w 2023 roku.

W nadchodzącym badaniu, do którego dotarło BBC, naukowcy pokazali przykład szybkości, z jaką fałszywe informacje rozprzestrzeniają się w mediach społecznościowych.

Za każdym razem, gdy sieć Storm‑1516 promowała fałszywą narrację o rzekomej „korupcji" Wołodymyra Zełenskiego, przejmowała ona około 7,5% wszystkich dyskusji na temat ukraińskiego prezydenta na platformie X w ciągu kolejnego tygodnia.

„To coś, z czego każda firma marketingowa byłaby dumna," powiedział Darren L. Linvill, jeden z autorów badania.

Ten tekst został napisany i sprawdzony przez dziennikarzy BBC. Przy tłumaczeniu zostały użyte narzędzia AI, jako część projektu pilotażowego.

Edycja: Kamila Koronska