Deepfake: กลลวงใหม่มิจฉาชีพ ใช้ AI สร้างคนดังเหมือนจริง หลอกเงินประชาชนออนไลน์

ที่มาของภาพ, TIKTOK and FACEBOOK

ภาพใบหน้าและเสียงของผู้เชี่ยวชาญด้านการลงทุน ปรากฏบนโฆษณาบนเฟซบุ๊ก ชวนผู้คนแอดเข้ากรุ๊ปไลน์ เพื่อให้คำแนะนำด้านการลงทุน แต่ภาพและเสียงที่ดูน่าเชื่อถือนี้ กลับเป็น AI Deepfake ที่มิจฉาชีพสร้างขึ้น เพื่อหลอกเงินจากผู้หลงเชื่อ

Deepfake คือการใช้ปัญญาประดิษฐ์ หรือเอไอ เพื่อสร้างวิดีโอของบุคคลใดบุคคลหนึ่ง ด้วยการดัดแปลงการเคลื่อนไหวบนใบหน้าและร่างกายของบุคคลนั้น ๆ ให้สอดคล้องกับพฤติกรรมหรือคำพูด ตามคำสั่ง (prompt)

ใบหน้าและเสียงของ กวี ชูกิจเกษม ผู้บริหารสูงสุด ฝ่ายวิเคราะห์หลักทรัพย์ บล.พาย โพสต์ในเฟซบุ๊กแฟนเพจจริงของเขาที่มีผู้ติดตามเกือบ 180,000 คน เตือนภัยว่า มีมิจฉาชีพใช้ชื่อของกวี สร้างเพจปลอม และยิงโฆษณาตามหน้าฟีด แอบอ้างให้นักลงทุนทำธุรกรรม รวมถึงการให้ข้อมูลเพื่อเชิญชวนลงทุน

“เราจะกลัวกรณี กลุ่มมิจฉาชีพนำ AI มาหลอกลวงนักลงทุนเช่นนี้มากกว่า ส่วนตัวรู้สึกห่วงใยถึงนักลงทุนทุกท่านหากจะลงทุนหรือทำธุรกรรมใดๆ โปรดตรวจสอบข้อมูลเช็กความถูกต้องให้ดีเสียก่อน” กวี ให้สัมภาษณ์กรุงเทพธุรกิจ เมื่อ 4 มี.ค.

ตอนนี้ กวี ได้เข้าแจ้งความแล้ว พร้อมติดต่อเฟซบุ๊กเพื่อดำเนินการ แต่ทางเฟซบุ๊กแจ้งกลับมาว่า “ไม่สามารถดำเนินการได้ เพราะทางเพจดังกล่าวทำถูกกติกาในการโฆษณา”

ด้านสำนักงานคณะกรรมการกำกับหลักทรัพย์และตลาดหลักทรัพย์ (ก.ล.ต.) รวมถึงตลาดหลักทรัพย์แห่งประเทศไทย (ตลท.) บอกกับ กรุงเทพธุรกิจว่า “เคสหลอกลวงนักลงทุนในรูปแบบนี้เคยมีมาก่อนแล้ว เท่าที่ทราบก่อนนี้ มิจฉาชีพที่ดำเนินการหลอกลวงนักลงทุนในรูปแบบนี้ เซิร์ฟเวอร์จะอยู่ในต่างประเทศ ที่ผ่านมาตำรวจมักจับได้เฉพาะกลุ่มบัญชีม้า”

ที่มาของภาพ, กวี ชูกิจเกษม

“เคสแบบนี้เหมือนแมวไล่จับหนูไปเรื่อย ๆ หากจะแก้ปัญหาเหล่านี้ได้ อาจต้องกำหนดให้เรื่องนี้เป็นวาระแห่งชาติหรือไม่” ก.ล.ต. ระบุ

ทั้งนี้ กรณีการใช้ AI Deepfake เพื่อตัดต่อและสวมรอยใบหน้าคนดัง ถูกมิจฉาชีพใช้เพื่อหลอกเงินเหยื่อมาพักใหญ่แล้ว และไม่เพียงแค่บนเฟซบุ๊ก แต่ปรากฏทั่วแพลตฟอร์มสังคมออนไลน์ยอดนิยม ทั้งติ๊กตอกและยูทิวบ์ด้วย

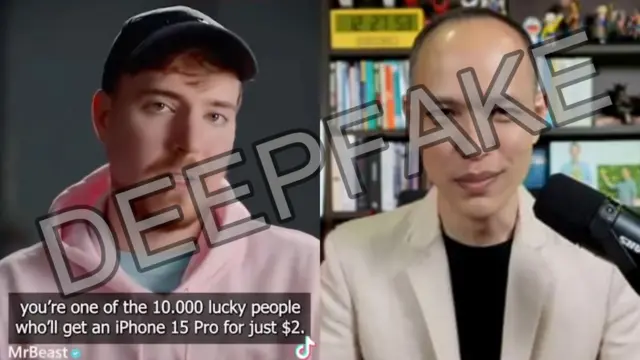

มิสเตอร์บีสต์ และผู้ประกาศข่าวบีบีซี ล้วนเคยตกเป็นเป้าหมาย

ที่มาของภาพ, TikTok

ช่วงสัปดาห์ที่ผ่านมา “มิสเตอร์บีสต์” (Mr.Beast) ซึ่งเป็นช่องยูทิวบ์ที่มีผู้ติดตามมากที่สุดในโลก เพิ่งฉลองการมีผู้กดติดตามเกิน 200 ล้านราย แต่ใบหน้าและน้ำเสียงของเขา ก็กลายเป็นวัตถุดิบชั้นดีของมิจฉาชีพเพื่อสร้าง Deepfake หลอกลวงเงิน

ยกตัวอย่างเช่น คอนเทนต์ที่ปรากฏบนติ๊กตอกเมื่อไม่นานมานี้ มิจฉาชีพเผยแพร่วิดีโอที่ปรากฏตัว “มิสเตอร์บีสต์” มาเสนอมอบโทรศัพท์ไอโฟนรุ่นใหม่ให้ ในราคา 2 ดอลลาร์สหรัฐ หรือเพียง 70 บาท

มิสเตอร์บีสต์ตัวจริง ได้แชร์วิดีโอนี้บนแพลตฟอร๋มเอ็กซ์ (ทวิตเตอร์ในอดีต) พร้อมตั้งคำถามว่า แพลตฟอร์มสังคมออนไลน์พร้อมแล้วหรือยังที่จะรับมือกับคอนเทนต์ Deepfake ที่จะเพิ่มมากขึ้นเรื่อย ๆ โดยโพสต์ที่เขาแชร์บนเอ็กซ์ มีผู้เข้าชมกว่า 28 ล้านครั้ง

ผู้ประกาศข่าวของบีบีซี อย่าง แมทธิว อัมโรลิวาลา และ ซัลลี บุนด็อก ก็ถูกมิจฉาชีพสร้าง Deepfake เพื่อไปล่อลวงประชาชนด้วยเช่นกัน

ยกตัวอย่าง วิดีโอบนเฟซบุ๊กที่ปรากฏภาพผู้ประกาศทั้งสอง แนะนำอีลอน มัสก์ อภิมหาเศรษฐีเจ้าของ “เอ็กซ์” แต่เนื้อหาคือการชวนไปลงทุน ขณะที่วิดีโอที่คล้ายกันก่อนหน้านี้ มีทั้งการใช้ใบหน้าอีลอน มัสก์ หลอกว่าจะแจกเงิน หรือสกุลเงินดิจิทัล เป็นต้น

บีบีซีได้สอบถามเรื่องนี้ไปยังบริษัท เมตา ที่เป็นเจ้าของเฟซบุ๊ก ซึ่งตอบกลับมาว่า “เราไม่อนุญาตให้เผยแพร่คอนเทนต์ลักษณะนี้ และแพลตฟอร์มของเราได้ถอดพวกมันออกไปแล้ว” โฆษกเมตา ระบุ

“เรากำลังปรับปรุงระบบให้ดีขึ้น และร้องขอให้ใครก็ตามที่เห็นคอนเทนต์ที่เชื่อว่าละเมิดกฎของเรา ให้รายงานโดยใช้อุปกรณ์ในแอปฯ ของเรา เพื่อที่เราจะตรวจสอบและดำเนินการได้” เมตา กล่าวต่อ

ด้านโฆษกติ๊กตอกก็ระบุว่า ทางบริษัทได้ถอดคอนเทนต์ปลอมของมิสเตอร์บีสต์ลงแล้ว หลังมีการอัพโหลดไปได้ไม่กี่ชั่วโมง พร้อมลบบัญชีผู้โพสต์ฐานละเมิดนโยบายการใช้งาน

ติ๊กตอกมีนโยบายที่ชัดเจนในการสั่งห้าม “สื่อสังเคราะห์” ซึ่ง “ปรากฎใบหน้าและเสียงที่คล้ายกับบุคคลจริง”

“ฉันโดนแล้ว”

ซัลลี บุนด็อก ผู้ประกาศข่าวบีบีซีที่ถูกมิจฉาชีพนำหน้าและเสียงไปทำ Deepfake เล่าว่า วันหนึ่งเธอกำลังจะเข้านอน แล้วก็มีคนโทรมาหาสามี ที่หันมาถามเธอว่า “ซัลลี เธอไปสัมภาษณ์อีลอน มัสก์ เมื่อไม่นานมานี้หรือ” แล้วเธอก็ตอบว่า “ไม่นะ แต่ก็อยากสัมภาษณ์อยู่”

ต่อมา เธอก็รู้ตัวว่า ถูกนำใบหน้าและเสียงไปปลอมแปลงเพื่อหลอกเงิน โดยเป็นภาพตัวเธอนั่งอยู่ในสตูดิโอจัดรายการของบีบีซีนิวส์ แล้วพูดเปิดช่วงรายการว่า “ข่าวด่วนภาคธุรกิจ”

เมื่อ ซัลลี ได้เห็นวิดีโอตัวเธอเองเช่นนี้แล้ว เธอระบุว่ามันดูน่าเชื่อถือมากจนทำให้เธอตื่นกลัว เพราะเป็นใบหน้าของเธอที่เชื้อเชิญให้ผู้ชมไปตกหลุมพลางของการหลอกลวงทางการเงิน ด้วยการโฆษณาว่า อีลอน มัสก์ ได้สร้างโครงการลงทุนใหม่ ที่รับประกันผลตอบแทนอย่างงามมากพอที่จะทำให้คุณไม่ต้องทำงานอีกเลย

จับผิด Deepfake อย่างไร ?

ในช่วงไม่กี่เดือนที่ผ่านมา เกิดกรณีมิจฉาชีพใช้วิดีโอ Deepfake เพิ่มมากขึ้นเรื่อย ๆ รวมถึงเริ่มมีการพบเห็นในไทย ซึ่งต้องยอมรับว่าเทคโนโลยีเอไอทรงพลังและมีความละเอียดอ่อนมากขึ้น จนหลายภาคส่วนเกิดความกังวลว่า มันสามารถสร้างวิดีโอในโลกเสมือนได้เหมือนคนจริง ๆ

ทอม เกอร์เคน ผู้สื่อข่าวเทคโนโลยีของบีบีซี แนะนำถึงวิธีการจับผิดวิดีโอ Deepfake ว่า อาจเป็นการง่ายกว่าที่จะจับสังเกตสิ่งที่คอนเทนต์นั้น ๆ เสนอมา มากกว่าจับผิดตัวเทคโนโลยีว่าเหมือนจริงแค่ไหน ยกตัวอย่างเช่น การเสนอสิ่งของมีค่าให้โดยไม่ขออะไรตอบแทน

แต่การทำคอนเทนต์แบบมิสเตอร์บีสต์เอง ก็ทำให้เรื่องนี้ซับซ้อนมากขึ้น เพราะเขามีชื่อเสียงในเรื่องการมอบรถยนต์ บ้าน และเงินสด ให้กับผู้ติดตาม แม้กระทั่งการมอบโทรศัพท์ไอโฟนให้ในช่วงฮาโลวีนเมื่อปีที่แล้ว ทำให้ผู้คนจำนวนไม่น้อยอาจหลงเชื่อวิดีโอ Deepfake ที่ปลอมเป็นตัวเขาว่า นั่นคือมิสเตอร์บีสต์ที่มาแจกของจริง ๆ

แต่หากดูอย่างละเอียดมากพอ เราจะจับผิดวิดีโอ Deepfake ได้หลายจุด ยกตัวอย่างเช่น ชื่อบัญชีที่วางไม่เป็นที่เป็นทาง (บ่งชี้ว่า มิจฉาชีพใส่ชื่อบัญชีลงไปในวิดีโอเอง เพื่อให้ผู้คนหลงเชื่อ) รวมถึงการตรวจสอบเครื่องหมายตรวจสอบสีน้ำเงิน ที่สังคมออนไลน์หลายแห่งใช้เพื่อยืนยันตัวตนของบัญชีนั้น ๆ

ในกรณีของวิดีโอ Deepfake ที่เป็นผู้ประกาศบีบีซี จุดที่น่าผิดสังเกตยิ่งมีมากกว่า เพราะผู้ประกาศออกเสียง “ฟิฟทีน” (15) ผิดเป็น “ไฟฟ์ทีน” รวมถึงการใช้แกรมมาผิดอีกด้วย

แม้นี่จะเป็นความผิดพลาดเล็กน้อย ๆ แต่ด้วยการพัฒนาของเทคโนโลยีที่ทำให้การจับผิดรูปภาพหรือวิดีโอทำได้ยากขึ้น สิ่งที่จะช่วยให้เรารู้ว่าวิดีโอนั้น ๆ เป็น Deepfake หรือไม่ ก็คือการใช้คำที่ผิด หรือการออกเสียงผิดนั่นเอง

กฎหมายว่าอย่างไร

ลิเลียน เอ็ดเวิร์ดส์ ศาสตราจารย์ด้านกฎหมายชี้ว่า ประเด็นนี้ยิ่งซับซ้อนมากขึ้น เพราะแต่ละประเทศมีการใช้กฎหมายที่แตกต่างกัน

“แล้วเราจะใช้กฎหมายอะไรกับกรณีละเมิดลิขสิทธิ์เช่นนี้ ยกตัวอย่างเช่น หากบริษัทสัญชาติอเมริกันถูกมิจฉาชีพปลอมแปลงเนื้อหาเพื่อหลอกเงินจากชาวอังกฤษ แต่โพสต์คอนเทนต์ในแพลตฟอร์มของจีน” เธอตั้งคำถาม

“คุณอาจใช้กฎหมายหมิ่นประมาทได้ หรือกฎหมายคุ้มครองข้อมูล หากเสียงหรือภาพของคุณถูกนำไปใช้โดยไม่ได้รับอนุญาต และไม่มีเหตุผลรองรับดีพอ”

แต่เธอเตือนว่า การกำหนดให้วิดีโอ Deepfake ทั้งหมดเป็นสิ่งผิดกฎหมาย อาจไม่เหมาะสมนัก นั่นเพราะ “หากรัฐบาลกำหนดให้วิดีโอ Deepfake ทั้งหมดผิดกฎหมาย นั่นหมายความว่า สเปเชียลเอฟเฟกต์ต่าง ๆ ในอุตสาหกรรมภาพยนตร์ก็จะผิดกฎหมายด้วย”

“มันจะกลายเป็นการทำให้ศิลปะที่ผู้คนสร้างขึ้น กลายเป็นสิ่งผิดกฎหมาย” เธอระบุ