ਆਰਟੀਫੀਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਬਾਰੇ ਮਾਹਿਰਾਂ ਦਾ ਡਰ, ‘ਇਹ ਤਕਨੀਕ ਸਾਨੂੰ ਅਲੋਪ ਕਰ ਸਕਦੀ’ – ਜਾਣੋ ਕਾਰਨ

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

- ਲੇਖਕ, ਵੇਰੋਨਿਕਾ ਸਮਿੰਕ

- ਰੋਲ, ਬੀਬੀਸੀ ਮੁੰਡੋ

ਆਰਟੀਫਿਸ਼ੀਅਲ ਇੰਟੈਲੀਜੈਂਸ ਮਨੁੱਖਤਾ ਨੂੰ ਅਲੋਪ ਹੋਣ ਵੱਲ ਲਿਜਾ ਸਕਦੀ ਹੈ, ਓਪਨ ਏਆਈ ਅਤੇ ਗੂਗਲ ਡੀਪ-ਮਾਈਂਡ ਦੇ ਮੁਖੀਆਂ ਸਮੇਤ ਕਈ ਮਾਹਿਰਾਂ ਨੇ ਚੇਤਾਵਨੀ ਦਿੱਤੀ ਹੈ।

ਪਰ ਅਸੀਂ ਮਸ਼ੀਨਾਂ ਵੱਲੋਂ ਮਨੁੱਖਾਂ ਨੂੰ ਟੇਕ ਓਵਰ ਕਰਨ ਤੋਂ ਕਿੰਨਾ ਦੂਰ ਹਾਂ?

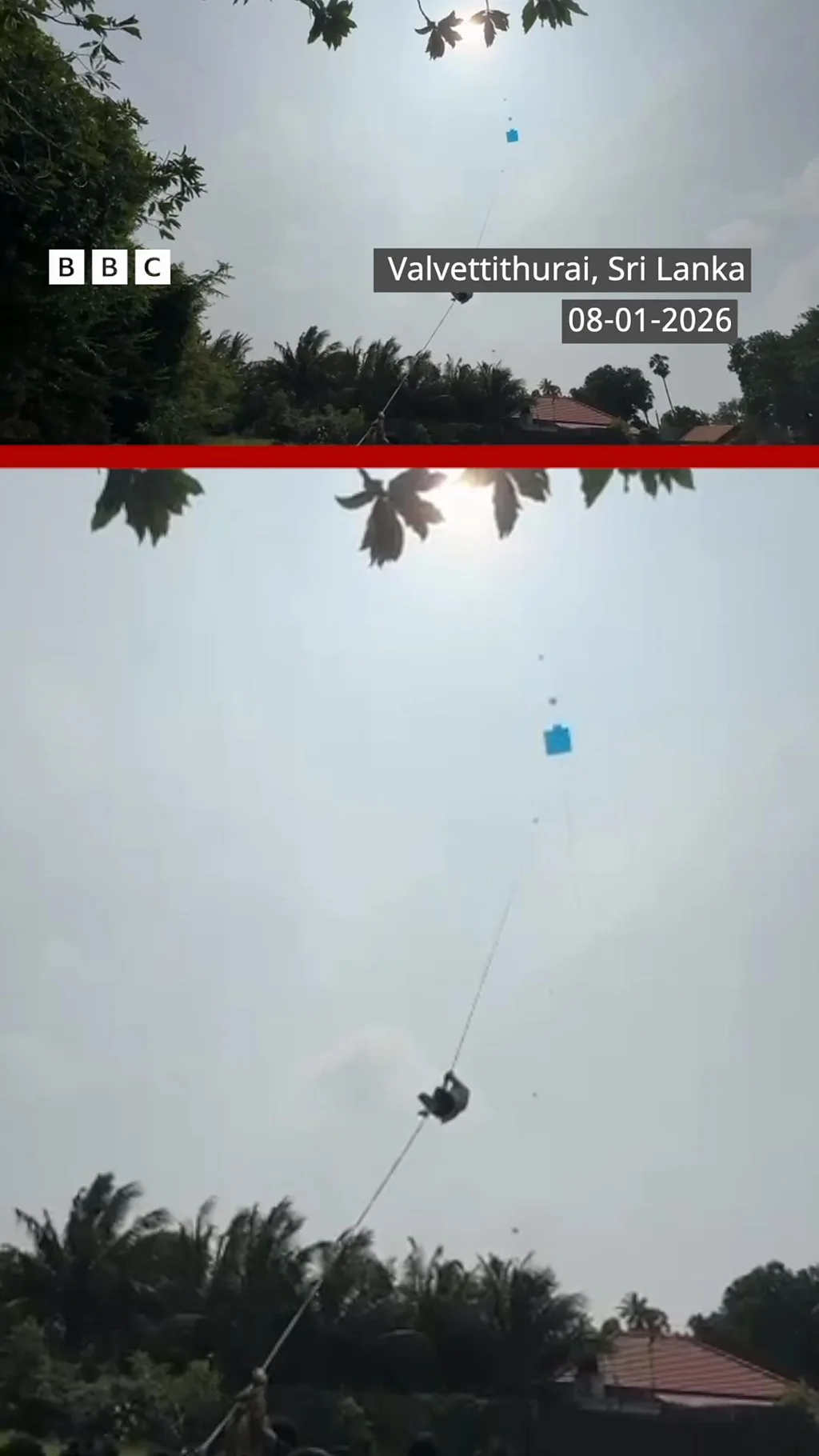

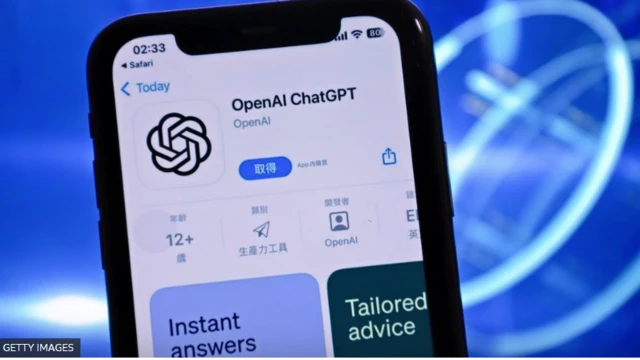

ਨਵੰਬਰ 2022 ਵਿੱਚ ਲਾਂਚ ਹੋਇਆ ਚੈਟ ਜੀਪੀਟੀ, ਇਤਿਹਾਸ ਵਿੱਚ ਸਭ ਤੋਂ ਤੇਜ਼ੀ ਨਾਲ ਵਧ ਰਹੀ ਇੰਟਰਨੈਟ ਐਪਲੀਕੇਸ਼ਨ ਬਣ ਗਿਆ ਹੈ।

ਚੈਟਜੀਪੀਟੀ, ਇੱਕ ਚੈਟਬੋਟ ਹੈ ਜੋ ਕਿ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੀ ਵਰਤੋਂ ਨਾਲ ਸਵਾਲਾਂ ਦੇ ਜਵਾਬ ਦਿੰਦੀ ਹੈ, ਟੈਕਸਟ ਅਤੇ ਇੱਥੋਂ ਤੱਕ ਕਿ ਯੂਜ਼ਰ ਦੀ ਮੰਗ ‘ਤੇ ਕੋਡ ਜੈਨਰੇਟ ਕਰਦਾ ਹੈ।

ਤਸਵੀਰ ਸਰੋਤ, Reuters

ਮਹਿਜ਼ ਦੋ ਮਹੀਨਿਆਂ ਅੰਦਰ ਇਸ ਦੇ 10 ਮਿਲੀਅਨ ਐਕਟਿਵ ਯੂਜ਼ਰ ਹੋ ਗਏ। ਟੈਕਨਾਲਜੀ ਮਾਨਿਟਰਿੰਗ ਕੰਪਨੀ ‘ਸੈਂਸਰ ਟਾਊਨ’ ਮੁਤਾਬਕ ਇੰਸਟਾਗ੍ਰਾਮ ਨੂੰ ਇਸ ਮੀਲ-ਪੱਥਰ ਤੱਕ ਪਹੁੰਚਦਿਆਂ ਢਾਈ ਸਾਲ ਲੱਗ ਗਏ।

ਮਾਈਕਰੋਸਾਫਟ ਦੇ ਵਿੱਤੀ ਸਹਿਯੋਗ ਅਤੇ ਓਪਨ ਏਆਈ ਕੰਪਨੀ ਵੱਲੋਂ ਵਿਕਸਿਤ ਕੀਤੀ ਗਈ ਚੈਟ ਜੀਪੀਟੀ ਦੀ ਇੰਨੀ ਲੋਕਪ੍ਰਿਅਤਾ ਨੇ ਮਨੁੱਖਤਾ ਦੇ ਭਵਿੱਖ ‘ਤੇ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਅਸਰ ਬਾਰੇ ਅਟਕਲਾਂ ਤੇਜ਼ ਕਰ ਦਿੱਤੀਆਂ ਹਨ।

ਦਰਜਨਾਂ ਮਾਹਿਰਾਂ ਨੇ ‘ਸੈਂਟਰ ਫਾਰ ਏਆਈ ਸੇਫਟੀ’, ਦੇ ਬਿਆਨ ਨਾਲ ਸਹਿਮਤੀ ਜਤਾਈ ਹੈ, ਜਿਸ ਮੁਤਾਬਕ ਮਹਾਂਮਾਰੀਆਂ ਅਤੇ ਪਰਮਾਣੂ ਜੰਗ ਜਿਹੇ ਖ਼ਤਰਿਆਂ ਦੇ ਨਾਲ-ਨਾਲ, ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਤੋਂ ਮਨੁੱਖਤਾ ਦੇ ਅਲੋਪ ਹੋਣ ਦੇ ਖ਼ਤਰੇ ਨੂੰ ਘਟਾਉਣਾ ਵੀ ਦੁਨੀਆਂ ਦੀ ਤਰਜੀਹ ਹੋਣਾ ਚਾਹੀਦਾ ਹੈ।

ਪਰ ਕਈਆਂ ਮੁਤਾਬਕ, ਡਰ ਨੂੰ ਵਧਾ ਚੜ੍ਹਾ ਕੇ ਪੇਸ਼ ਕੀਤਾ ਜਾ ਰਿਹਾ ਹੈ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਇਨਸਾਨਾਂ ਦੀ ਨਕਲ ਕਰਨਾ

ਕੋਈ ਲਿਖਤ (ਲੇਖ, ਕਵਿਤਾਵਾਂ ਅਤੇ ਚੁਟਕਲਿਆਂ ਤੋਂ ਕੰਪਿਊਟਰ ਕੋਡ), ਅਤੇ ਚੈਟ ਜੀਪੀਟੀ, ਡਲ-ਈ, ਬਾਰਡ ਅਤੇ ਅਲਫ਼ਾ ਕੋਡ ਜਿਹੇ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਤੋਂ ਤਿਆਰ ਤਸਵੀਰਾਂ (ਜਿਵੇਂ ਕਿ ਡਾਇਆਗ੍ਰਾਮ, ਫੋਟੋ ਅਤੇ ਆਰਟਵਰਕ) ਨੂੰ ਮਨੁੱਖੀ ਕੰਮ ਤੋਂ ਨਹੀਂ ਨਿਖੇੜਿਆ ਜਾ ਸਕਦਾ।

ਵਿਦਿਆਰਥੀ ਇਸ ਦੀ ਵਰਤੋਂ ਹੋਮਵਰਕ ਕਰਨ ਅਤੇ ਸਿਆਸਤਦਾਨ ਆਪਣੇ ਭਾਸ਼ਣ ਲਿਖਣ ਲਈ ਕਰ ਰਹੇ ਹਨ।

ਵੱਡੀ ਟੈਕ ਕੰਪਨੀ ਆਈਬੀਐਮ ਦਾ ਕਹਿਣਾ ਹੈ ਕਿ ਜਿਹੜੇ ਕੰਮ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੁਆਰਾ ਹੋ ਸਕਦੇ ਹਨ, ਉਨ੍ਹਾਂ 7,800 ਨੌਕਰੀਆਂ ਲਈ ਉਹ ਭਰਤੀ ਬੰਦ ਕਰ ਦੇਣਗੇ।

ਜੇ ਇਹ ਸਾਰੇ ਬਦਲਾਅ ਤੁਹਾਨੂੰ ਬਹੁਤ ਵੱਡੇ ਲੱਗ ਰਹੇ ਹਨ, ਤਾਂ ਇਨ੍ਹਾਂ ਲਈ ਖੁਦ ਨੂੰ ਤਿਆਰ ਕਰ ਲਓ।

ਅਸੀਂ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਪਹਿਲੇ ਪੜਾਅ ’ਤੇ ਹਾਂ। ਅਗਲੇ ਦੋ ਹੋਰ ਪੜਾਅ ਹਨ ਜੋ ਕਿ ਕੁਝ ਵਿਗਿਆਨੀਆਂ ਮੁਤਾਬਕ ਮਨੁੱਖਤਾ ਲਈ ਖ਼ਤਰਾ ਬਣ ਸਕਦੇ ਹਨ।

ਇਹ ਤਿੰਨ ਪੜਾਅ ਹਨ-

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

1.ਨੈਰੋ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ

ਨੈਰੋ(Narrow) ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਇਕਹਿਰੇ ਕੰਮ ‘ਤੇ ਫੋਕਸ ਕਰਦੀ ਹੈ, ਤੈਅ ਫੰਕਸ਼ਨਜ਼ ਵਿੱਚ ਦੁਹਰਾਏ ਜਾਣ ਵਾਲੇ ਕੰਮ ਕਰਨਾ। ਇਹ ਆਮ ਤੌਰ ‘ਤੇ ਕਾਫ਼ੀ ਸਾਰੇ ਡਾਟਾ ਨਾਲ ਚਲਦਾ ਹੈ, ਪਰ ਸਿਰਫ਼ ਉਨ੍ਹਾਂ ਖੇਤਰਾਂ ਵਿੱਚ ਹੀ ਜਿਸ ਲਈ ਇਸ ਨੂੰ ਡਿਜ਼ਾਇਨ ਕੀਤਾ ਗਿਆ ਹੁੰਦਾ ਹੈ।

ਉਦਾਹਰਨ ਵਜੋਂ ਇੱਕ ਸ਼ਤਰੰਜ ਪ੍ਰੋਗਰਾਮ, ਜੋ ਕਿ ਵਿਸ਼ਵ ਚੈਂਪੀਅਨ ਨੂੰ ਵੀ ਹਰਾਉਣ ਦੀ ਸਮਰਥਾ ਰੱਖਦਾ ਹੈ ਪਰ ਹੋਰ ਕੰਮ ਕਰਨ ਦੇ ਯੋਗ ਨਹੀਂ ਹੁੰਦਾ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਸਮਾਰਟਫੋਨ ਇਸ ਤਕਨੀਕ ਦੀ ਵਰਤੋਂ ਕਰਨ ਵਾਲੀਆਂ ਐਪਲੀਕੇਸ਼ਨਜ਼ ਨਾਲ ਭਰੇ ਹੋਏ ਹਨ ਜਿਵੇਂ ਕਿ ਜੀਪੀਐਸ ਮੈਪ ਤੋਂ ਲੈ ਕੇ ਸੰਗੀਤ ਅਤੇ ਵੀਡੀਓ ਪ੍ਰੋਗਰਾਮ ਜੋ ਤੁਹਾਡੀ ਪਸੰਦ ਜਾਣਦੀਆਂ ਹਨ ਅਤੇ ਉਸੇ ਮੁਤਾਬਕ ਸੁਝਾਅ ਦਿੰਦੀਆਂ ਹਨ।

ਇੱਥੋਂ ਤੱਕ ਕਿ ਹੋਰ ਸੂਖਮ ਸਿਸਟਮ ਜਿਵੇਂ ਕਿ ਡਰਾਈਵਰ ਰਹਿਤ ਕਾਰਾਂ ਅਤੇ ਚੈਟ ਜੀਪੀਟੀ ਵੀ ਨੈਰੋ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਰੂਪ ਹਨ। ਇਹ ਤੈਅ ਭੂਮਿਕਾਵਾਂ ਤੋਂ ਬਾਹਰ ਕੰਮ ਕਰਨ ਦੇ ਯੋਗ ਨਹੀਂ ਹੁੰਦੇ, ਇਸ ਲਈ ਆਪਣੇ ਆਪ ਫ਼ੈਸਲਾ ਨਹੀਂ ਲੈ ਸਕਦੇ।

ਹਾਲਾਂਕਿ, ਕੁਝ ਮਾਹਿਰ ਮੰਨਦੇ ਹਨ ਕਿ ਖੁਦ ਬ ਖੁਦ ਸਿੱਖਣ ਲਈ ਪ੍ਰੋਗਰਾਮ ਕੀਤੇ ਗਏ ਸਿਸਟਮ ਜਿਵੇਂ ਕਿ ਚੈਟ ਜੀਪੀਟੀ ਜਾਂ ਆਟੋ ਜੀਪੀਟੀ ਵਿਕਾਸ ਦੇ ਅਗਲੇ ਪੜਾਅ ਵਿੱਚ ਜਾ ਸਕਦੇ ਹਨ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

2.ਆਰਟੀਫਿਸ਼ਲ ਜਨਰਲ ਇੰਟੈਲੀਜੈਂਸ

ਆਰਟੀਫਿਸ਼ਲ ਜਨਰਲ ਇੰਟੈਲੀਜੈਂਸ ਉਸ ਨੂੰ ਕਿਹਾ ਜਾਏਗਾ ਜਦੋਂ ਇੱਕ ਮਸ਼ੀਨ ਹਰ ਉਹ ਬੌਧਿਕ ਕੰਮ ਕਰ ਸਕੇਗੀ ਜੋ ਇੱਕ ਮਨੁੱਖ ਕਰ ਸਕਦਾ ਹੈ। ਇਸ ਨੂੰ ਸਟ੍ਰੌਂਗ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਵਜੋਂ ਵੀ ਜਾਣਿਆ ਜਾਂਦਾ ਹੈ।

ਮਾਰਚ 2022, ਵਿੱਚ ਇੱਕ ਹਜ਼ਾਰ ਤੋਂ ਵੱਧ ਤਕਨੀਕੀ ਮਾਹਿਰਾਂ ਨੇ ਸਾਰੀਆਂ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਪ੍ਰਯੋਗਸ਼ਾਲਾਵਾਂ ਨੂੰ ਘੱਟੋ ਘੱਟ ਛੇ ਮਹੀਨਿਆਂ ਲਈ ਜੀਪੀਟੀ-4(ਚੈਟ ਜੀਪੀਟੀ ਦਾ ਸਭ ਤੋਂ ਨਵਾਂ ਰੂਪ) ਤੋਂ ਵਧੇਰੇ ਤਾਕਤਵਰ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਸਿਸਟਮ ਦੀ ਟਰੇਨਿੰਗ ਤੁਰੰਤ ਪ੍ਰਭਾਵ ਨਾਲ ਰੋਕਣ ਦਾ ਸੱਦਾ ਦਿੱਤਾ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

“ਮਨੁੱਖ ਦੀ ਇੰਟੈਲੀਜੈਂਸ ਨਾਲ ਮੁਕਾਬਲਾ ਕਰਨ ਵਾਲੇ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਸਿਸਟਮ ਸਮਾਜ ਅਤੇ ਮਨੁੱਖਤਾ ਲਈ ਵੱਡਾ ਖ਼ਤਰਾ ਬਣ ਸਕਦੇ ਹਨ।”, ਟੈਕ ਕੰਪਨੀਆਂ ਟੈਸਲਾ ਅਤੇ ਸਪੇਸ ਐਕਸ ਦੇ ਮਾਲਿਕ ਐਲਨ ਮਸਕ ਦੇ ਨਾਲ ਐਪਲ ਦੇ ਕੋ-ਫਾਊਂਡਰ ਸਟੀਵ ਵੋਜ਼ਨਾਇਕ ਨੇ ਕਿਹਾ।

ਮਸਕ, ਓਪਨ ਏਆਈ ਦੇ ਕੋ-ਫਾਊਂਡਰਾਂ ਵਿੱਚੋਂ ਹਨ, ਜਿਨ੍ਹਾਂ ਨੇ ਬਾਅਦ ਵਿੱਚ ਫ਼ਰਮ ਦੀ ਲੀਡਰਸ਼ਿਪ ਨਾਲ ਅਸਹਿਮਤੀਆਂ ਪੈਦਾ ਹੋਣ ਕਾਰਨ ਅਸਤੀਫ਼ਾ ਦੇ ਦਿੱਤਾ ਸੀ।

‘ਫਿਊਚਰ ਆਫ ਲਾਈਫ’ ਵੱਲੋਂ ਪਬਲਿਸ਼ ਇੱਕ ਚਿੱਠੀ ਵਿੱਚ ਮਾਹਿਰਾਂ ਨੇ ਕਿਹਾ ਕਿ ਜੇ ਕੰਪਨੀਆਂ ਜਲਦੀ ਤੋਂ ਜਲਦੀ ਕੰਮ ਰੋਕਣ ਤੋਂ ਇਨਕਾਰ ਕਰਦੀਆਂ ਹਨ, ਤਾਂ ਸਰਕਾਰਾਂ ਨੂੰ ਦਖਲ ਦੇਣਾ ਚਾਹੀਦਾ ਹੈ ਅਤੇ ਇਸ ‘ਤੇ ਪ੍ਰਤੀਬੰਧ ਲਾਉਣਾ ਚਾਹੀਦਾ ਹੈ ਤਾਂ ਕਿ ਸੁਰੱਖਿਆ ਮਾਪਦੰਡ ਡਿਜ਼ਾਈਨ ਅਤੇ ਲਾਗੂ ਕੀਤੇ ਜਾ ਸਕਣ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਜਿਨ੍ਹਾਂ ਸਿਆਣਾ, ਓਨਾ ਹੀ ਬੇਵਕੂਫ਼

ਔਕਸਫੋਰਡ ਯੁਨੀਵਰਸਿਟੀ ਦੇ ਇੰਸਟਿਚਿਊਟ ਫਾਰ ਐਥਿਕਸ ਇਨ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਤੋਂ ਕੈਰੀਸਾ ਵੀਲਜ਼ ਨੇ ਚਿੱਠੀ ’ਤੇ ਦਸਤਖਤ ਕੀਤੇ ਸੀ। ਪਰ ਉਹ ਮੰਨਦੀ ਹੈ ਕਿ ਸੈਂਟਰ ਫਾਰ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦਾ ਅਗਲਾ ਬਿਆਨ, ਜ਼ਿਆਦਾ ਹੀ ਦੂਰ ਚਲਾ ਗਿਆ ਸੀ ਜਿਸ ਵਿੱਚ ਮਨੁੱਖਤਾ ਦੇ ਅਲੋਪ ਹੋਣ ਦੀ ਚੇਤਾਵਨੀ ਸੀ,ਇਸ ਲਈ ਉਸ ‘ਤੇ ਦਸਤਖਤ ਨਹੀਂ ਕੀਤੇ।

ਉਨ੍ਹਾਂ ਨੇ ਬੀਬੀਸੀ ਦੇ ਐਂਡਰਿਊ ਵੈਬ ਨੂੰ ਦੱਸਿਆ ਕਿ, “ਜਿਸ ਤਰ੍ਹਾਂ ਦੀ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਅਸੀਂ ਇਸ ਵੇਲੇ ਬਣਾ ਰਹੇ ਹਾਂ, ਉਹ ਜਿਨ੍ਹੀਂ ਸਮਾਰਟ ਹੈ, ਓਨੀ ਹੀ ਬੇਵਕੂਫ਼ ਹੈ। ਜੇ ਕਿਸੇ ਨੇ ਚੈਟ ਜੀਪੀਟੀ ਜਾਂ ਹੋਰ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਵਰਤੀ ਹਾਂ ਤਾਂ ਨੋਟਿਸ ਕੀਤਾ ਹੋਏਗਾ ਇਨ੍ਹਾਂ ਵਿੱਚ ਬਹੁਤ ਅਹਿਮ ਸੀਮਿਤਾਵਾਂ ਹਨ।”

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਵੀਲਜ਼ ਕਹਿੰਦੀ ਹੈ ਕਿ ਉਨ੍ਹਾਂ ਨੂੰ ਚਿੰਤਾ ਹੈ ਕਿ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਵੱਡੇ ਪੱਧਰ ‘ਤੇ ਗਲਤ ਜਾਣਕਾਰੀਆਂ ਬਣਾਉਣ ਲਈ ਜ਼ਿੰਮੇਵਾਰ ਹੋ ਸਕਦੀ ਹੈ।

“ਸਾਲ 2024 ਵਿੱਚ ਯੂਐਸ ਚੋਣਾਂ ਦੇ ਮੱਦੇਨਜ਼ਰ, ਅਤੇ ਟਵਿੱਟਰ ਜਿਹੇ ਪਲੇਟਫ਼ਾਰਮਾਂ ਵੱਲੋਂ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਐਥਿਕਸ ਅਤੇ ਸੁਰੱਖਿਆ ਟੀਮਾਂ ਕੱਢੇ ਜਾਣ ਨੂੰ ਦੇਖਦਿਆਂ, ਮੇਰੀ ਚਿੰਤਾ ਹੋਰ ਵਧ ਜਾਂਦੀ ਹੈ।”

ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਬਾਰੇ ਖਾਸ ਗੱਲਾਂ:

- ਵੱਡੀ ਬਹਿਸ ਚੱਲ ਰਹੀ ਹੈ ਕਿ ਕੀ ਇੱਕ ਮਸ਼ੀਨ ਇਨਸਾਨ ਜਿਹੀ ਇੰਟੈਲੀਜੈਂਸ ਹਾਸਿਲ ਕਰ ਸਕਦੀ ਹੈ ਜਾਂ ਨਹੀਂ

- ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੀ ਸਭ ਤੋਂ ਵੱਡੀ ਚੁਣੌਤੀ ਹੈ ਕਿ ਰੈਗੁਲੇਟ ਕਰਨ ਲਈ ਮਾਹਿਰਾਂ ਦੀ ਕੋਈ ਟੀਮ ਨਹੀਂ ਹੈ

- ਕਈ ਮਾਹਿਰਾਂ ਮੁਤਾਬਕ ਫ਼ਿਲਹਾਲ ਏਆਈ ਖਤਰਿਆਂ ਨੂੰ ਅਮਲ ਦੇਣ ਦੀ ਸਮਰਥਾ ਤੋਂ ਕੋਹਾਂ ਦੂਰ ਹੈ

- ਇਹ ਡਰ ਹੈ ਕਿ ‘ਬੁਰੇ ਲੋਕ’, ਬੁਰੇ ਕੰਮਾਂ ਲਈ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦਾ ਇਸਤੇਮਾਲ ਕਰ ਸਕਦੇ ਹਨ

ਚਾਰ ਮਈ ਨੂੰ ਵਾਈਟ ਹਾਊਸ ਨੇ ਆਪਣੇ ਬਿਆਨ ਵਿੱਚ ਕਿਹਾ ਸੀ, “ਯੂਐਸ ਸਰਕਾਰ ਸੰਭਾਵਿਤ ਖ਼ਤਰਿਆਂ ਨੂੰ ਮੰਨ ਰਹੀ ਹੈ। ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਸਾਡੇ ਸਮੇਂ ਦੀਆਂ ਸਭ ਤੋ ਤਾਕਤਵਰ ਤਕਨੀਕਾਂ ਵਿੱਚੋਂ ਇੱਕ ਹੈ ਪਰ ਇਸ ਦੇ ਮੌਕਿਆਂ ਤੋਂ ਲਾਹਾ ਲੈਣ ਤੋਂ ਪਹਿਲਾਂ ਸਾਨੂੰ ਇਸ ਦੇ ਖ਼ਤਰਿਆਂ ਨੂੰ ਮਿਟਾਉਣਾ ਚਾਹੀਦਾ ਹੈ।”

ਅਮਰੀਕੀ ਕਾਂਗਰਸ ਨੇ ਓਪਨ ਏਆਈ ਦੇ ਸੀਈਓ ਸੈਮ ਆਲਟਮੈਨ ਨੂੰ ਚੈਟ ਜੀਪੀਟੀ ਬਾਰੇ ਸਵਾਲਾਂ ਦੇ ਜਵਾਬ ਲੈਣ ਲਈ ਸੰਮਨ ਕੀਤਾ ਸੀ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਸੈਨੇਟ ਦੀ ਸੁਣਵਾਈ ਦੌਰਾਨ, ਆਲਟਮੈਨ ਨੇ ਕਿਹਾ ਕਿ ਇਹ ਬੇਹਦ ਜ਼ਰੂਰੀ ਹੈ ਕਿ ਇਹ ਇੰਡਸਟਰੀ ਸਰਕਾਰ ਵੱਲੋਂ ਰੈਗੁਲੇਟ ਹੋਵੇ ਕਿਉਂਕਿ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਲਗਾਤਾਰ ਤਾਕਤਵਰ ਹੋ ਰਹੀ ਹੈ।

‘ਫਿਊਚਰ ਆਫ ਲਾਈਫ ਇੰਸਟੀਚਿਊਟ’ ਦੇ ਪਬਲਿਕ ਪਾਲਿਸੀ ਰਿਸਰਚਰ ਕਾਰਲੋਸ ਇਗਨਾਸੀਓ ਗੁਟੀਅਰੇਜ਼ ਨੇ ਬੀਬੀਸੀ ਨੂੰ ਸਮਝਾਇਆ ਕਿ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੀ ਸਭ ਤੋਂ ਵੱਡੀ ਚੁਣੌਤੀ ਇਹ ਹੈ ਕਿ ਇਸ ਨੂੰ ਰੈਗੁਲੇਟ ਕਰਨ ਲਈ ਮਾਹਿਰਾਂ ਦੀ ਕੋਈ ਟੀਮ ਨਹੀਂ ਹੈ।

ਫਿਰ ਅਸੀਂ ਪਹੁੰਚਦੇ ਹਾਂ ਇਸ ਦੇ ਤੀਜੇ ਅਤੇ ਆਖ਼ਰੀ ਪੜਾਅ ਵਿੱਚ

3.ਆਰਟੀਫਿਸ਼ਲ ਸੁਪਰ ਇੰਟੈਲੀਜੈਂਸ

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਇਹ ਥਿਊਰੀ ਹੈ ਕਿ ਜਦੋਂ ਅਸੀਂ ਦੂਜੇ ਪੜਾਅ ਯਾਨੀ ਆਰਟੀਫਿਸ਼ਲ ਜਨਰਲ ਇੰਟੈਲੀਜੈਂਸ ਵਿਚ ਪਹੁੰਚਦੇ ਹਾਂ, ਤਾਂ ਆਖ਼ਰੀ ਪੜਾਅ ਵੱਲ ਵਧਦੇ ਹਾਂ। ਆਰਟੀਫਿਸ਼ਲ ਸੁਪਰ ਇੰਟੈਲੀਜੈਂਸ ਉਹ ਹੋਏਗੀ ਜਦੋਂ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਮਨੁੱਖੀ ਇੰਟੈਲੀਜੈਂਸ ਤੋਂ ਜ਼ਿਆਦਾ ਹੋਏਗੀ।

ਔਕਸਫੋਰਡ ਯੁਨੀਵਰਸਿਟੀ ਦੇ ਦਾਰਸ਼ਨਿਕ ਅਤੇ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਮਾਹਿਰ ਨਿਕ ਬੋਸਟ੍ਰੋਮ ਸੁਪਰ ਇੰਟੈਲੀਜੈਂਸ ਨੂੰ ਇੱਕ ਅਜਿਹੀ ਬੁੱਧੀ ਜਾਂ ਸਮਝ ਵਜੋਂ ਪਰਿਭਾਸ਼ਤ ਕਰਦੇ ਹਨ ਜੋ ਵਿਗਿਆਨਕ ਰਚਨਤਾਮਕਤਾ, ਆਮ ਸਿਆਣਪ ਅਤੇ ਸਮਾਜਿਕ ਹੁਨਰ ਸਮੇਤ ਅਮਲੀ ਤੌਰ ‘ਤੇ ਹਰ ਖੇਤਰ ਵਿੱਚ ਮਨੁੱਖੀ ਦਿਮਾਗ਼ ਤੋਂ ਬਿਹਤਰ ਕੰਮ ਕਰੇ।

ਗਟੀਅਰੇਜ਼ ਕਹਿੰਦੇ ਹਨ ਕਿ ਮਨੁੱਖਾਂ ਨੂੰ ਇੰਜੀਨੀਅਰ, ਨਰਸ ਜਾਂ ਵਕੀਲ ਬਣਨ ਲਈ ਲੰਬਾ ਸਮਾਂ ਪੜ੍ਹਾਈ ਕਰਨੀ ਪੈਂਦੀ ਹੈ। ਆਰਟੀਫਿਸ਼ਲ ਜਨਰਲ ਇੰਟੈਲੀਜੈਂਸ ਸਾਡੇ ਤੋਂ ਬਹੁਤ ਥੋੜ੍ਹੇ ਸਮੇਂ ਵਿੱਚ ਲਗਾਤਾਰ ਖੁਦ ਵਿੱਚ ਬਿਹਤਰੀਆਂ ਲਿਆ ਸਕਦੀ ਹੈ।

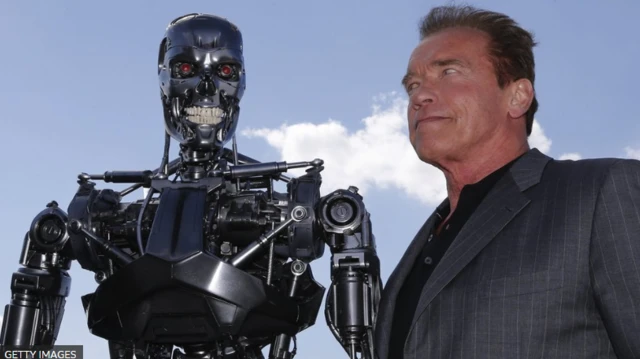

ਵਿਗਿਆਨ ਕਲਪਨਾ

ਕੰਸੈਪਟ ਫ਼ਿਲਮ ‘ਦ ਟਰਮੀਨੇਟਰ’ ਦੇ ਪਲਾਟ ਨਾਲ ਜੁੜਦਾ ਹੈ, ਜਿਸ ਵਿੱਚ ਮਸ਼ੀਨਾਂ ਮਨੁੱਖਤਾ ਨੂੰ ਖਤਮ ਕਰਨ ਲਈ ਪਰਮਾਣੂ ਜੰਗ ਸ਼ੁਰੂ ਕਰਦੀਆਂ ਹਨ।

ਪ੍ਰਿੰਸਟਨ ਯੁਨੀਵਰਸਿਟੀ ਵਿੱਚ ਕੰਪਿਊਟਰ ਵਿਗਿਆਨੀ ਅਰਵਿੰਦਰ ਨਾਰਾਇਣ ਨੇ ਬੀਬੀਸੀ ਨੂੰ ਦੱਸਿਆ ਸੀ ਕਿ ਸਾਇੰਸ ਫਿਕਸ਼ਨ ਜਿਹੀ ਤਬਾਹੀ ਸਚਾਈ ਤੋਂ ਪਰ੍ਹੇ ਹੈ।

ਫ਼ਿਲਹਾਲ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਇਨ੍ਹਾਂ ਖਤਰਿਆਂ ਨੂੰ ਅਮਲ ਦੇਣ ਦੀ ਸਮਰਥਾ ਤੋਂ ਕੋਹਾਂ ਦੂਰ ਹੈ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਵੱਡੀ ਬਹਿਸ ਚੱਲ ਰਹੀ ਹੈ ਕਿ ਕੀ ਇੱਕ ਮਸ਼ੀਨ ਇਨਸਾਨ ਜਿਹੀ ਇੰਟੈਲੀਜੈਂਸ ਹਾਸਿਲ ਕਰ ਸਕਦੀ ਹੈ ਜਾਂ ਨਹੀਂ, ਖਾਸ ਕਰਕੇ ਜਦੋਂ ਗੱਲ ਇਮੋਸ਼ਨਲ ਇੰਟੈਲੀਜੈਂਸ ਦੀ ਹੁੰਦੀ ਹੈ। ਜੋ ਮੰਨਦੇ ਹਨ ਕਿ ਅਸੀਂ ਆਰਟੀਫਿਸ਼ਲ ਜਨਰਲ ਇੰਟੈਲੀਜੈਂਸ ਹਾਸਿਲ ਕਰਨ ਦੇ ਨੇੜੇ ਹਾਂ, ਉਹ ਇਸ ਬਾਰੇ ਵੀ ਚਿੰਤਾ ਕਰਦੇ ਹਨ।

ਹਾਲ ਹੀ ਵਿੱਚ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਪਿਤਾਮਾ ਕਹੇ ਜਾਣ ਵਾਲੇ ਜੈਫਰੀ ਹਿੰਟਨ ਜੋ ਕਿ ਮਸ਼ੀਨਾਂ ਨੂੰ ਤਜਰਬਿਆਂ ਤੋਂ ਸਿਖਾਉਣ ਦੀ ਸਿੱਖਿਆ ਦੇਣ ਵਿੱਚ ਮੋਹਰੀ ਹਨ, ਨੇ ਬੀਬੀਸੀ ਇੰਟਰਵਿਊ ਵਿੱਚ ਚੇਤਾਵਨੀ ਦਿੱਤੀ ਹੈ ਕਿ ਅਸੀਂ ਉਸ ਮੀਲ ਪੱਥਰ ਦੇ ਕਰੀਬ ਹੋ ਸਕਦੇ ਹਾਂ।

ਗੂਗਲ ਤੋਂ ਸੇਵਾ ਮੁਕਤ ਹੋਏ 75 ਸਾਲਾ ਜੈਫਰੀ ਨੇ ਕਿਹਾ, “ਇਸ ਵੇਲੇ ਮਸ਼ੀਨਾਂ ਸਾਡੇ ਤੋਂ ਵੱਧ ਸਮਝ ਵਾਲੀਆਂ ਨਹੀਂ ਹਨ, ਜਿਨ੍ਹਾਂ ਮੈਂ ਦੇਖ ਸਕਦਾ ਹਾਂ। ਪਰ ਮੈਂ ਮਹਿਸੂਸ ਕਰਦਾ ਹਾਂ ਕਿ ਜਲਦੀ ਹੀ ਉਹ ਹੋ ਸਕਦੀਆਂ ਹਨ।”

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਨਿਊਯਾਰਕ ਟਾਈਮਜ਼ ਵਿੱਚ ਗੂਗਲ ਤੋਂ ਆਪਣੀ ਸੇਵਾ ਮੁਕਤੀ ਦਾ ਐਲਾਨ ਕਰਨ ਲਈ ਭੇਜੇ ਇੱਕ ਬਿਆਨ ਵਿੱਚ ਹਿੰਟਨ ਨੇ ਕਿਹਾ ਕਿ ਉਨ੍ਹਾਂ ਨੂੰ ਆਪਣੇ ਕੀਤੇ ਹੋਏ ਕੰਮ ‘ਤੇ ਪਛਤਾਵਾ ਹੋ ਰਿਹਾ ਹੈ ਕਿਉਂਕਿ ਉਨ੍ਹਾਂ ਨੂੰ ਡਰ ਹੈ ਕਿ ‘ਬੁਰੇ ਲੋਕ’, ਬੁਰੇ ਕੰਮਾਂ ਲਈ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦਾ ਇਸਤੇਮਾਲ ਕਰ ਸਕਦੇ ਹਨ।

ਉਨ੍ਹਾਂ ਨੇ ਬੀਬੀਸੀ ਨੂੰ ਇੱਕ ਭਿਆਨਕ ਸੁਫ਼ਨੇ ਦੇ ਦ੍ਰਿਸ਼ ਦੀ ਉਦਾਹਰਨ ਦਿੱਤੀ- ਜ਼ਰਾ ਸੋਚੋ, ਕਿ ਕੁਝ ‘ਬੁਰੇ ਲੋਕ’ ਜਿਵੇਂ ਰੂਸੀ ਰਾਸ਼ਟਰਪਤੀ ਪੁਤਿਨ ਰੋਬੋਟਾਂ ਨੂੰ ਉਨ੍ਹਾਂ ਦੇ ਉਪ-ਟੀਚੇ ਬਣਾਉਣ ਦੀ ਯੋਗਤਾ ਦੇਣ ਦਾ ਫ਼ੈਸਲਾ ਲੈ ਲੈਣ।

“ਮਸ਼ੀਨਾਂ ਫਿਰ ਆਪਣੇ ਉਪ-ਟੀਚੇ ਤਿਆਰ ਕਰ ਸਕਣਗੀਆਂ ਜਿਵੇਂ ਕਿ- ‘ਮੈਨੂੰ ਹੋਰ ਸ਼ਕਤੀ ਚਾਹੀਦੀ ਹੈ।’ ਜਿਸ ਨਾਲ ਹੋਂਦ ਦਾ ਖ਼ਤਰਾ ਪੈਦਾ ਹੋ ਸਕਦਾ ਹੈ।”, ਉਨ੍ਹਾਂ ਨੇ ਚੇਤਾਵਨੀ ਦਿੱਤੀ।

ਪਰ ਹਿੰਟਨ ਨੇ ਕਿਹਾ ਕਿ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਘੱਟ ਸਮੇਂ ਵਿੱਚ ਖਤਰਿਆਂ ਤੋਂ ਵੱਧ ਲਾਹਾ ਦੇਵੇਗੀ “ਇਸ ਲਈ ਮੈਨੂੰ ਨਹੀਂ ਲਗਦਾ ਕਿ ਸਾਨੂੰ ਇਹ ਵਿਕਸਿਤ ਕਰਨਾ ਰੋਕ ਦੇਣਾ ਚਾਹੀਦਾ ਹੈ।”

ਤਸਵੀਰ ਸਰੋਤ, Reuters

ਅਲੋਪਤਾ ਜਾਂ ਅਮਰਤਾ

ਬ੍ਰਿਟਿਸ਼ ਭੌਤਿਕ ਵਿਗਿਆਨੀ ਸਟੀਫਨ ਹਾਕਿੰਗ ਨੇ ਸਖ਼ਤ ਚੇਤਾਵਨੀ ਦਿੱਤੀ ਸੀ।

“ਪੂਰੀ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਵਿਕਾਸ ਦਾ ਮਤਲਬ ਮਨੁੱਖਤਾ ਦਾ ਅੰਤ ਹੋ ਸਕਦਾ ਹੈ।”, ਆਪਣੀ ਮੌਤ ਤੋਂ ਚਾਰ ਸਾਲ ਪਹਿਲਾਂ ਸਾਲ 2014 ਵਿੱਚ ਉਨ੍ਹਾਂ ਨੇ ਬੀਬੀਸੀ ਨੂੰ ਦੱਸਿਆ ਸੀ।

ਉਨ੍ਹਾਂ ਨੇ ਕਿਹਾ ਸੀ, “ਇਸ ਪੱਧਰ ਦੀ ਇੰਟੈਲੀਜੈਂਸ ਵਾਲੀ ਮਸ਼ੀਨ ਖੁਦ ਕੰਮ ਕਰ ਸਕੇਗੀ ਅਤੇ ਖੁਦ ਬਨੂੰ ਬਹੁਤ ਤੇਜ਼ੀ ਨਾਲ ਰੀ-ਡਿਜ਼ਾਇਨ ਕਰ ਸਕੇਗੀ।”

ਪਰ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਸਭ ਤੋਂ ਵੱਧ ਉਤਸ਼ਾਹਿਤ ਲੋਕਾਂ ਵਿੱਚ ਇੱਕ ਭਵਿੱਖਵਾਦੀ ਖੋਜੀ ਅਤੇ ਲੇਖਕ ਰੇ ਕੁਜ਼ਵੀਅਲ ਹਨ ਜੋ ਕਿ ਗੂਗਲ ਵਿੱਚ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੇ ਰਿਸਰਚਰ ਹਨ ਅਤੇ ਸਿਲੀਕਾਨ ਵੈਲੀ ਦੀ ਸਿਗੁਲੈਰਟੀ ਯੁਨੀਵਰਸਿਟੀ ਦੇ ਕੋ-ਫਾਊਂਡਰ ਹਨ।

ਤਸਵੀਰ ਸਰੋਤ, Getty Images

ਨੈਨੋਬੋਟਸ ਅਤੇ ਅਮਰਤਾ

ਕੁਰਜ਼ਵੀਅਲ ਮੰਨਦੇ ਹਨ ਕਿ ਸੁਪਰ ਇੰਟੈਲੀਜੈਂਟ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਦੀ ਵਰਤੋਂ ਨਾਲ ਮਨੁੱਖ ਬਿਓਲੋਜੀਕਲ ਰੁਕਾਵਟਾਂ ਨੂੰ ਦੂਰ ਕਰ ਸਕਦੇ ਹਨ।

ਸਾਲ 2015 ਵਿੱਚ ਉਨ੍ਹਾਂ ਨੇ ਅਨੁਮਾਨ ਲਾਇਆ ਸੀ ਕਿ 2030 ਤੱਕ ਮਨੁੱਖ ਅਮਰ ਹੋਣ ਦੀ ਸਮਰੱਥਾ ਹਾਸਿਲ ਕਰ ਸਕਣਗੇ। ਇਹ ਸਾਡੇ ਸਰੀਰਾਂ ਅੰਦਰ ਕੰਮ ਕਰਦੇ ਨੈਨੋਬੋਟਸ(ਬਹੁਤ ਸੂਖਮ ਰੋਬੋਟ) ਨਾਲ ਹੋ ਸਕੇਗਾ ਜੋ ਸਰੀਰ ਅੰਦਰ ਬਿਮਾਰੀ ਜਾਂ ਕਿਸੇ ਨੁਕਸਾਨ ਨੂੰ ਠੀਕ ਕਰਨਗੇ।

ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਗਵਰਨੈਂਸ

ਗੁਟੀਅੇਰਜ਼ ਆਰਟੀਫਿਸ਼ਲ ਇੰਟੈਲੀਜੈਂਸ ਗਵਰਨੈਂਸ ਸਿਸਟਮ ਬਣਾਉਣ ਬਾਰੇ ਸਹਿਮਤੀ ਜਤਾਉਂਦੇ ਹਨ।

ਉਨ੍ਹਾਂ ਕਿਹਾ, “ਅਜਿਹੇ ਭਵਿੱਖ ਦੀ ਕਲਪਨਾ ਕਰੋ ਜਿਸ ਵਿੱਚ ਇੱਕ ਚੀਜ਼ ਕੋਲ ਧਰਤੀ ਦੇ ਹਰ ਇਨਸਾਨ ਅਤੇ ਉਨ੍ਹਾਂ ਦੀਆਂ ਆਦਤਾਂ ਬਾਰੇ ਹਰ ਜਾਣਕਾਰੀ (ਸਰਚ ਇੰਜਨਾਂ ਕਰਕੇ)ਹੋਏਗੀ ਕਿ ਉਹ ਇਸ ਤਰੀਕੇ ਨਾਲ ਸਾਨੂੰ ਕਾਬੂ ਕਰੇਗੀ ਜਿਸ ਦਾ ਸਾਨੂੰ ਅਹਿਸਾਸ ਵੀ ਨਹੀਂ ਹੈ।”

ਸਭ ਤੋਂ ਬੁਰਾ ਦ੍ਰਿਸ਼ ਹੋਏਗਾ ਮਨੁੱਖ ਬਨਾਮ ਰੋਬੋਟ ਜੰਗ। ਬੁਰਾ ਇਹ ਵੀ ਹੈ ਕਿ ਸਾਨੂੰ ਅਹਿਸਾਸ ਨਹੀਂ ਹੋ ਰਿਹਾ ਕਿ ਸਾਨੂੰ ਮੈਨੁਪੁਲੇਟ ਕੀਤਾ ਜਾ ਰਿਹਾ ਹੈ, ਕਿਉਂਕਿ ਉਸ ਚੀਜ਼ ਨਾਲ ਸਾਡਾ ਗ੍ਰਹਿ ਸਾਂਝਾ ਹੈ ਜੋ ਸਾਡੇ ਤੋਂ ਕਿਤੇ ਜ਼ਿਆਦਾ ਇੰਟੈਲੀਜੈਂਟ ਹੈ।

ਐਂਡਰਿਊ ਵੈਬ ਅਤੇ ਕ੍ਰਿਸ ਵੈਲੇਂਸ ਦੀ ਜਾਣਕਾਰੀ ਸਮੇਤ