د رازونو سپړونکي: ټېک ټاک او مېټا د الګوریتم سیالۍ ګټلو لپاره خوندیتوب ګواښي

د عکس سرچینه، BBC/Getty images

- Author, ماریانا سپیرینګ

- دنده, د خواله رسنیوڅېړونکې

- Author, مایک راډفورډ

- د لوستلو وخت: ۱۴ دقیقې

د رازونو یو شمېر سپړونکو بي بي سي ته ویلي، وروسته له هغې چې د دوی د الګوریتمونو په اړه داخلي څېړنو وښوده چې قهر او غوسه د کاروونکو ګډون زیاتوي، د ټولنیزو رسنیو لویو شرکتونو داسې پرېکړې کړې چې د خلکو پر فیډونو یا حسابپاڼو یې ډېر زیانمنونکي مواد راڅرګند کړل.

له لسګونو زیاتو افشا کوونکو او د شرکتونو کارکوونکو دا ډاګیزه کړې چې څنګه خواله رسنیو د کاروونکو پام وراړولو لپاره په ځانګړې توګه د تاوتریخوالي، جنسي باج اخیستنې او ترهګرۍ په څېر موضوعاتو کې د خوندیتوب په برخه کې احتمالي خطرونه منلي دي.

د فېسبوک او انسټاګرام څښتن شرکت مېټا یو انجنیر وايي، لوړپوړو مدیرانو ورته ویلي وو، چې د کاروونکو په فیډونو کې دې ډېر د زیانمنېدو تر حده مواد ښکاره کړي. په دې کې د ښځو پر ضد کرکه او د توطیې نظریې هم شاملې دي، چې له ټېک ټاک سره سیالي وشي.

انجنیر وویل:"هغوی موږ ته په یو ډول وویل چې دا کار ځکه کوي چې د شرکت د ونډو بیه ټیټه شوې ده."

د ټېک ټاک یو کارکوونکي بي بي سي ته د شرکت کاروونکو د شکایتونو داخلي ډشبورډونو ته کمساری لاسرسی ورکړ، دغه راز یې ځینې نور شواهد هم وړاندې کړي چې ښيي کارکوونکو ته لارښوونه شوې وه چې د ماشومانو په اړه د زیانمنونکو پوسټونو د ګڼو راپورونو پر ځای د سیاستوالو اړوند ځینو قضیو ته لومړیتوب ورکړي.

دغه کارکوونکي وویل، دا پرېکړې د کاروونکو د خوندیتوب له امله نه، بلکې له سیاستوالو سره د "پیاوړې اړیکې ساتلو" لپاره کېدې، چې د مقرراتو یا بندیزونو د ګواښونو مخه ونیوله شي.

هغه افشا کوونکي چې د بي بي سي مستند فلم (انسائډ راګا ماشین) کې غږیدلي دي، نږدې انځور وړاندې کوي چې صنعت څنګه د ټېک ټاک له چټکې ودې وروسته غبرګون وښود.

د ټېک ټاک هغه الګوریتم چې د لنډو ویډیوګانو سپارښتنه کوي، ډېر ښکېلونکی دی، د ټولنیزو رسنیو نړۍ یې بدله کړه، او سیال شرکتونه یې اړ کړل چې ژر تر ژره ځان ورسره برابر کړي.

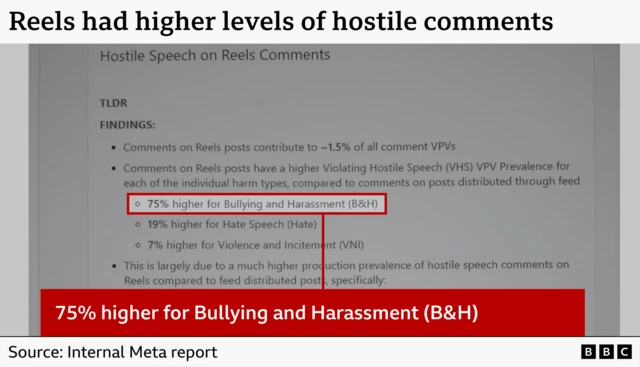

د مېټا یو لوړپوړی څېړونکی، ماټ موټیل وايي، د ټېک ټاک سیال تولید (انسټاګرام ریلز) په ۲۰۲۰ کال کې د خوندیتوب له کافي تدبیرونو پرته پیل شو. هغه داخلي څېړنې چې بي بي سي سره شریکې شوې ښيي چې په ریلز کې د نظرونو (کمنټس) برخه کې د ځورونې او ځورولو، د کرکجنو خبرو او تاوتریخوالي یا پارونې کچه د انسټاګرام د نورو برخو پرتله د پام وړ لوړه وه.

د مېټا یو بل پخوانی کارکوونکی وايي، شرکت د ریلز د پراختیا او ودې لپاره په ۷۰۰ کارکوونکو پانګونه وکړه، خو د خوندیتوب ټیمونو ته دوه متخصص کارکوونکي چې د ماشومانو د ساتنې لپاره ورته اړتیا وه، او لس نور کسان چې د ټاکنو د شفافیت لپاره غوښتل شوي وو، رد کړل شول.

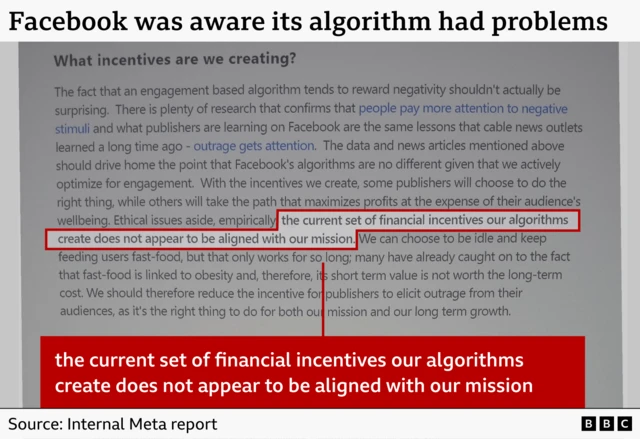

ماټ موټیل بي بي سي ته لسګونه داسې اسناد ورښودلي چې ده د "لوړې کچې څېړنیز اسناد" وبلل، او د دې پلاټفورمونو له امله کاروونکو ته د رسېدونکو زیانونو ډولونه ښيي. په دې اسنادو کې داسې شواهد هم وو، چې ښيي فېسبوک د خپل الګوریتم له امله رامنځته کېدونکو ستونزو څخه خبر و.

د یوې داخلي څېړنې له مخې، الګوریتم د محتوا جوړوونکو ته داسې "لار" وړاندیز کوي چې د کاروونکو د هوساینې په زیان سره ډېره ګټه ترلاسه کړي. دغه راز په راپور کې ویل شوي چې د الګوریتم لخوا رامنځته شوي اوسنۍ مالي انګېزې د شرکت له اصلي هدف سره برابرې نه ښکاري، هغه هدف چې وایي غواړي نړۍ یو بل ته نږدې کړي.

په راپور کې راغلي، فېسبوک کولای شي "بېپروا پاتې شي او کاروونکو ته همداسې د فاسټ فوډ په څېر محتوا ورکړي، خو دا چاره یوازې د لنډ وخت لپاره کار کوي."

د افشا کوونکو دې ادعاوو په ځواب کې، مېټا ویلي، "دا خبره ناسمه ده چې موږ د مالي ګټې لپاره په قصدي ډول زیانمنونکې محتوا زیاته خپروو."

ټېک ټاک هم ویلي دا "جعلي ادعاوې" دي او شرکت په داسې ټکنالوژۍ پانګونه کړې چې د زیانمنو محتواوو د لیدلو مخه ونیسي.

رووفان ډینګ، چې له ۲۰۲۰ څخه تر ۲۰۲۴ پورې یې د ټېک ټاک د سپارښتنې (recommendation) سیستم د جوړولو لپاره د ماشین زدکړې انجنیر په توګه کار کړی وايي، الګوریتمونه یو ډول "تور بکسونه"دي چې د دوی داخلي کار کول څارل او سم درک کول دي چې په ټوله کې له ستونزو نه دي خالي.

هغه وايي، داسې سیسټمونه جوړول چې په بشپړ ډول خوندي وي، ډېر سخت کار دی.

نوموړي زیاته کړه: "موږ خپله د ژورې زدکړې پر الګوریتم بشپړ کنټرول نه لرو."

دی زیاتوي، انجنیران معمولاً د پوسټونو محتوا ته ډېر پام نه کوي.

"زموږ لپاره ټوله محتوا یوازې پېژند نمبر(ای ډي) دی، یعنی بېلابېلې شمېرې دي."

دی وايي، دوی د محتوا د خوندیتوب پر ټیمونو تکیه کوي، چې زیانمنونکي پوسټونه لېرې کړي، چې الګوریتم یې بیا خپاره نه کړي. هغه دا اړیکه د بېلابېلو برخو له ټیمونو سره پرتله کړې.

نوموړی زیاتوي:"لکه د موټر بېلابېل ټیمونه وي، یو ټیم د سرعت او انجن مسؤلیت لري، نو موږ تمه لرو چې هغه ټیم چې د بریک پر سیسټم کار کوي، خپل مسوولیت به ښه ترسره کوي."

رووفان ډینګ وايي، کله چې ټېک ټاک هڅه کوله خپل الګوریتم نږدې هره اوونۍ ښه کړي، چې د بازار زیاته برخه ترلاسه کړي، هغه د وخت په تېرېدو سره ډېر داسې ''بارډر لائین'' یا ستونزمنه محتوا لیدل پیل کړل چې معمولاً هغه وخت څرګندېدله، چې کاروونکي یو څه وخت ویډیوګانې کتلې وای.

''بارډر لائین'' محتوا هغه اصطلاح ده چې د خواله رسنیو شرکتونه یې د داسې پوسټونو لپاره کاروي چې زیانمنونکي، خو قانوني وي. په دې کې د ښځو پر ضد کرکه، توکمپالنه، جنسي بڼه لرونکي پوسټونه، او د توطیې نظریې هم شاملې دي.

ځینو تنکیو ځوانانو بي بي سي ته ویلي، چې هغه سیسټمونه چې کاروونکي ترې کار اخلي، چې وښيي دوی ستونزمنه محتوا نه غواړي، سم کار نه کوي. د دوی په وینا، سره له دې چې دوی دا انتخاب کاروي، بیا هم ورته د تاوتریخوالي او د کرکې محتوا په لویو ټولنیزو شبکو کې یې ورته سپارښتنه کېږي.

په یوه خورا جدي بېلګه کې، یو بل ځوان ، کالیوم، چې اوس ۱۹ کلن دی ویلي چې له ۱۴ کلنۍ راهیسې د "الګوریتم له لارې سخت دریځی شوی" و. د هغه په وینا، الګوریتم هغه ته داسې محتوا ښودله چې دی یې غوسه کاوه او په پای کې یې د توکمپالنې او د ښځو پر ضد نظرونو منلو ته وهڅاوه.

هغه وویل:"ویډیوګانو ما ته انرژي راکوله، خو په رښتینې توګه مثبته نه."

په انګلنډ کې د ترهګرۍ ضد پولیسو کارپوهان، چې هر کال په خواله رسنیو کې زرګونه پوسټونه څېړي، وايي چې په دا وروستیو میاشتو کې یې د یهودو ضد، توکمپالو، تاوتریخوالي او سخت دریځو ښي اړخو پوسټونو "عادي کېدل" لیدلي دي.

یو افسر وویل "خلک د ریښتیني نړۍ تاوتریخوالي ته لږ حساس شوي دي او نور د خپلو نظرونو له څرګندولو نه وېرېږي."

"ټېک ټاک ړنګ کړئ!"

د ۲۰۲۵ کال په اوږدو کې بي بي سي په منظم ډول د ټېک ټاک د باور او خوندیتوب ټیم له یوه غړي سره خبرې وکړې، چې دلته یې نوم نیک یادېږي. بي بي سي وکولای شول د هغه پر لپټاپ د شرکت داخلي ډشبورډ وګوري، چې پکې معلومېدل چې د هغه د ټیم لخوا کومې قضیې څېړل کېږي او څنګه ورته ځواب ورکول کېږي.

نیک وویل "کله چې ته هره ورځ د هغو کارونو له امله د ګناه احساس کوې چې درته د ترسره کولو لارښوونه کېږي، نو یو وخت به دا پوښتنه کوې چې: ایا باید څه ووایم؟"

هغه وویل چې د ارزونې لپاره د قضیو شمېر دومره ډېر و چې د ټولو څارنه ستونزمنه وه، او دا حالت په ځانګړي ډول تنکیو ځوانانو او ماشومانو ته خطر پېښوي.

د هغه په وینا، د کارکوونکو کمول او د منځپانګې د څارنې د ځینو ټیمونو بیا تنظیمول، چیرې چې ځینې دندې د مصنوعي ځیرکتیا (اې ای) له لارې بدلېږي، د دې لامل شوي چې شرکت په اغېزمن ډول له دې ډول محتوا سره مقابله ونه شي کړای.

دغه افشا کوونکي وویل چې په ترهګرۍ، جنسي تاوتریخوالي، فزیکي تاوتریخوالي، ناوړه چلند او قاچاق پورې تړلي مواد زیاتېدونکي ښکاري.

هغه زیاته کړه چې د اپلېکېشن د سپارښتنو حقیقي حالت او د زیانمنو محتواوو پر وړاندې اخیستل کېدونکي اقدامات "په ډېرو برخو کې له هغه څه سره ډېر توپیر لري چې شرکتونه یې په عامه توګه وایي."

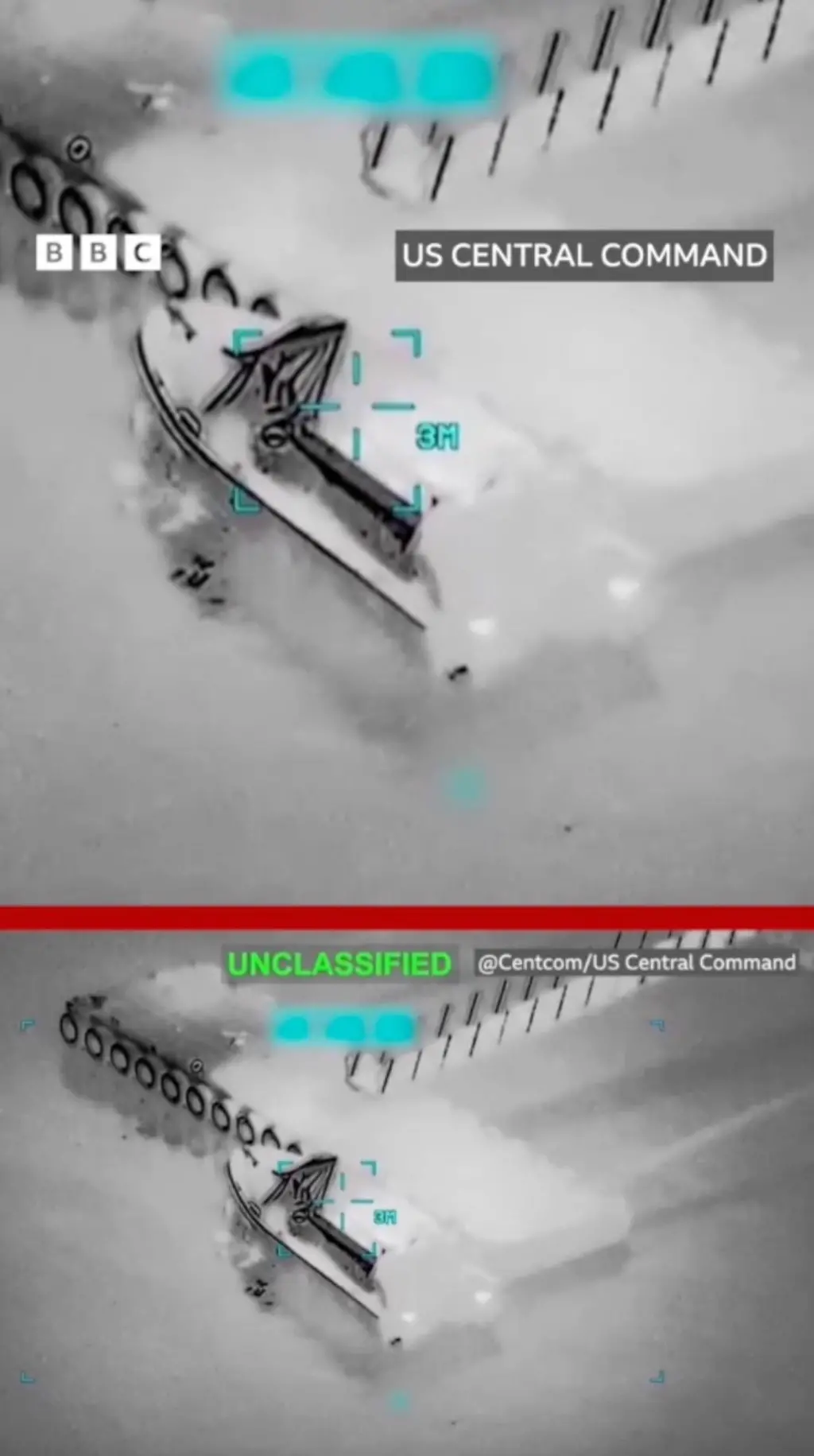

بي بي سي ته داسې شواهد هم وښودل شول چې ښيي ټېک ټاک ځینې نسبتاً کوچنۍ قضیې چې له سیاستوالو سره تړاو لري، د خوندیتوب ټیم د ارزونې لپاره د هغو قضیو پرتله مهمې ګڼلې چې د تنکیو ځوانانو ته د زیان اړولو له محتوا سره یې تړاو درلود.

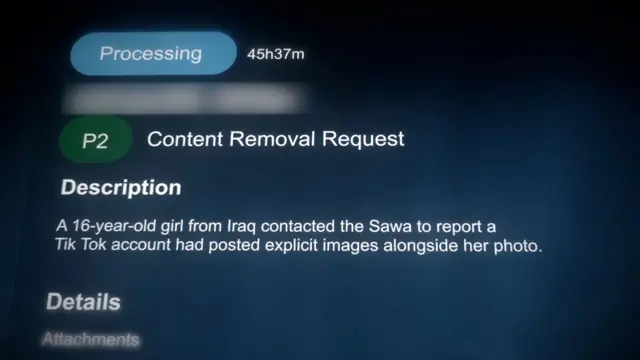

په یوه بېلګه کې، یو سیاستوال ته چې له چرګ سره د پرتله کولو له لارې پرې ملنډې وهل شوې وې، د ارزونې لپاره لوړ لومړیتوب ورکړل شوی و، په داسې حال کې چې په فرانسه کې یو ۱۷ کلن ځوان چې د سایبري ځورونې او د هغه د هویت د تقلید قرباني و، او په عراق کې یوه ۱۶ کلنه نجلۍ چې شکایت یې کړی و چې د هغې په نوم جنسي بڼه لرونکي جعلي انځورونه په اپ کې خپرېږي، له دې قضیو وروسته کتنې ته پاتې شوي وو.

د عراق د قضیې په اړه نیک وویل "که ته هغه هېواد ته وګورې چې دا راپور ترې راغلی، نو دا ډېر لوړ خطر لري، ځکه چې دا د یو نابالغ انسان په اړه دی او د جنسي باج اخیستنې موضوع هم پکې شامله ده، خو که د لومړیتوب درجه وګورې، نو بیړنیوالی یې لوړ نه دی."

نیک داسې بېلګې هم وښودلې چې پکې ځینې پوسټونه چې خلکو ته یې له ترهګرو ډلو سره د یو ځای کېدو یا د جرمونو د ترسره کولو هڅونه کوله، د لوړ لومړیتوب په توګه نه وو ټاکل شوي.

هغه وویل کله چې د باور او خوندیتوب ټیم غوښتنه وکړه چې د سیاستوالو د قضیو پر ځای دې د ځوانانو اړوند قضیو ته لومړیتوب ورکړل شي، ورته وویل شول چې داسې ونه کړي او هماغه درجهبندي تعقیب کړي چې ورته ورکړل شوې ده.

د نیک په اند د دې لومړیتوب اصلي لامل دا دی چې شرکت د ماشومانو د خوندیتوب پرتله ډېر پام د سیاستوالو او حکومتونو سره د "پياوړې اړیکې ساتلو" ته کوي، چې د قوانینو، مقرراتو یا بندیزونو مخه ونیسي، چې د شرکت کاروبار ته زیان رسولای شي.

نیک وايي، کله چې ده او نورو کارکوونکو دا اندېښنې له مدیرانو سره شریکې کړې، هغوی ورته ډېر پام ونه کړ، ځکه چې مدیران "هره ورځ له دې ډول محتوا سره نه مخ کېږي."

د خوندیتوب ټیم دغه کارکوونکي د هغو والدینو لپاره چې ماشومان یې ټېک ټاک کاروي، ډېره واضح مشوره ورکړه:

"دا اپلېکېشن ړنګ کړئ، خپل ماشومان تر هغه بریده چې امکان وي د اوږدې مودې لپاره له دې اپ څخه لرې وساتئ."

ټېک ټاک هغه ادعا رد کړه چې سیاسي محتوا د ځوانانو د خوندیتوب پرتله لومړیتوب لري، او په وینا یې دا ادعا "د دوی د منځپانګې د څارنې د سیستم د کار کولو طریقه په بنسټیز ډول ناسمه بیانوي."

شرکت وايي، د نیک ټیم د خوندیتوب د یوه پراخ سیسټم برخه ده چې پکې څو بېلابېل ټیمونه د محتوا په اړه شکایتونه څېړي. د شرکت په وینا "د ځینو ځانګړو موضوعاتو لپاره ځانګړي کاري بهیرونه دا معنا نه لري چې د ماشومانو د خوندیتوب قضیې کمې مهمې ګڼل کېږي. دا قضیې د ځانګړو ټیمونو له خوا په موازي ارزونې سیسټمونو کې څېړل کېږي."

د ټېک ټاک ویاند هم وايي، چې دا نیوکې "هغه حقیقت له پامه غورځوي چې ټېک ټاک میلیونونو خلکو ته اجازه ورکوي نوې لېوالتیا ومومي، ټولنې پیدا کړي او د منځپانګې جوړوونکو اقتصاد ملاتړ وکړي."

شرکت دغه راز وویل، د تنکیو ځوانانو حسابونه له ۵۰ څخه زیات مخکې فعال شوي د خوندیتوب تنظیمات لري، او زیاتوي، چې دوی په داسې ټکنالوژۍ پانګونه کوي چې د زیانمنې محتوا له لیدلو مخکې یې مخه ونیسي، د سپارښتنو سخت قوانین وساتي او کاروونکو ته دا امکان ورکړي چې خپله تجربه تنظیم کړي.

"هر څه وکړئ چې ځان ورسوو"

په ۲۰۲۰ کال کې د الګوریتم سیالي لا پسې سخته شوه، چې انسټاګرام ریلز د انسټاګرام د یوې برخې په توګه پیل شول. دا کار د دې لپاره وشو چې د ټېک ټاک له چټک شهرت سره سیالي وکړي، چې د کووېډ-۱۹ وبا پر مهال په ټوله نړۍ کې ډېر مشهور شوی و.

ماټ موټیل، چې له ۲۰۲۱ کال راهیسې یې په مېټا (د فیسبوک او انسټاګرام شرکت) کې د لوړپوړي څېړونکي په توګه کار کاوه وايي چې دا د شرکت هڅه وه چې د ټېک ټاک هغه "ځانګړی تولید" نقل یا میمیک کړي.

هغه وايي، د ۲۰۱۹ او ۲۰۲۳ ترمنځ د ده مسوولیت دا و چې په ډېره پراخه کچه تجربې ترسره کړي. کله ناکله دا تجربې پر سلګونو میلیونو کاروونکو ترسره کېدې، هغه کاروونکي چې ډېری وخت "هیڅ خبر نه وو" چې دوی د ازمایښت برخه دي. هدف دا و چې وګوري محتوا په فیډونو کې څنګه درجه بندي کېږي.

هغه وویل "د مېټا تولیدات له درې میلیاردو زیات خلک کاروي. هر څومره چې دوی وکولای شي تاسو ډېر وخت په پلاټفورم کې وساتي، هماغومره ډېر اعلانونه پلوري او هماغومره ډېرې پیسې ګټي، خو دا ډېره مهمه ده چې دوی دا سیسټمونه سم اداره کړي، ځکه کله چې داسې نه کېږي، نو ډېر بدې پایلې رامنځته کېږي."

د ریلز په اړه موټیل وايي، چې د شرکت تګلاره دا وه چې تر ټولو چټک پرمختګ وکړي، پرته له دې چې وکتل شي پر کاروونکو به یې اغېزې څه وي. د هغه په وینا، تل یو ډول سوداګري وه. هغه څېړنیز سند چې موټیل له بي بي سي سره شریک کړی و، ښيي چې مېټا د ریلز له پیل وروسته د زیانمنې محتوا په کنټرول کې ستونزې لرلې.

د څېړنې له مخې، په ریلز کې د ځورونې او ځورولو نظرونه ۷۵ سلنه ډېر وو، د کرکې خبرې ۱۹سلنه ډېرې وې او د تاوتریخوالي یا پارونې کچه له اووه سلنې زیاته وه.

د دې پرتله د انسټاګرام د اصلي فیډ له پوسټونو سره شوې وه.

هغه وايي، په شرکت کې یو ډول "د ځواک ناانډولي" موجوده وه. د خوندیتوب ټیمونو باید د هغو ټیمونو موافقه ترلاسه کړې وای چې د انسټاګرام ریلز مسوولیت یې درلود، چې داسې نوی فیچر یا تولید پیل کړي چې د کاروونکو خوندیتوب ښه کړي.

د ماټ موټیل په وینا، د ریلز ټیمونو ته داسې انګېزې وې چې د دې ډول خوندیتوب فیچرونو د پیل مخه ونیسي، ځکه:

"زهرجنه محتوا د عادي محتوا پرتله ډېر ګډون او تعامل رامنځته کوي."

په همدې وخت کې برانډون سیلورمن هم د شرکت د ځینو لوړو کچو بحثونو برخه و. د هغه د ټولنیزو رسنیو د څارنې وسیله (کراوډ ټېنګل) په ۲۰۱۶ کال کې د فېسبوک لخوا اخیستل شوې وه.

سیلورمن وايي، د شرکت اجرائیه رئیس مارک زوکیربیرګ د سیالۍ په اړه "ډېر اندېښمن او حساس" و.

هغه وايي:

"کله چې هغه احساس کړي چې جدي سیالي رامنځته کېدای شي، نو داسې پیسې نشته چې ډېرې وګڼل شي."

سیلورمن زیاته کړه چې په همدې موده کې یې ولیدل چې د خوندیتوب ټیمونو هڅه کوله یوازې یو څو نوي کارکوونکي وګوماري، خو د دې کار لپاره اجازه اخیستل ورته ستونزمنه وه، ځکه د شرکت اصلي تمرکز د ریلز پراخول وو.

د هغه په ټکو "یو بل ټیم و چې ویل یې: موږ یوازې د انسټاګرام ریلز لپاره ۷۰۰ نوي کارکوونکي وموندل. ما وویل: ښه، سمه ده."

د مېټا یو پخوانی انجینر، چې دلته یې نوم ټېم یاد شوی، وايي، کله شرکت هڅه کوله له ټېک ټاک سره سیالي وکړي، نو په پلاټفورم کې نورړ پولو او زیانمنونکې محتوا ته اجازه ورکړل شوه.

هغه وویل چې د دوی ټیم مخکې د همدې ډول محتوا د کمولو لپاره کار کاوه، خو وروسته د شرکت "سوداګریز دریځ" بدل شو.

ټېم وویل:

"کله چې ته له ټېک ټاکه ماتې خورې، نو د شرکت د ونډو بیه هم اغېزمنه کېږي. خلک اندېښمن او ډېر غبرګون ښودونکي شول، او ویل یې: راځئ هر څه وکړو چې ځان ورسوو. د راتلونکې ربع لپاره له کوم ځایه ۲سلنه یا ۳سلنه نور عاید پیدا کولی شو؟"

هغه وايي، دا پرېکړه، چې نور دې هغه محتوا محدوده نه شي چې ممکن زیانمنونکې وي، خو غیرقانوني نه وي او خلک ورسره تعامل کوي، د مېټا د یو لوړپوړي مرستیال رئیس لخوا وشوه. د ټېم په باور هغه کس مستقیم د شرکت اجرائیه رئیس مارک زوکېربېرګ ته راپور ورکاوه.

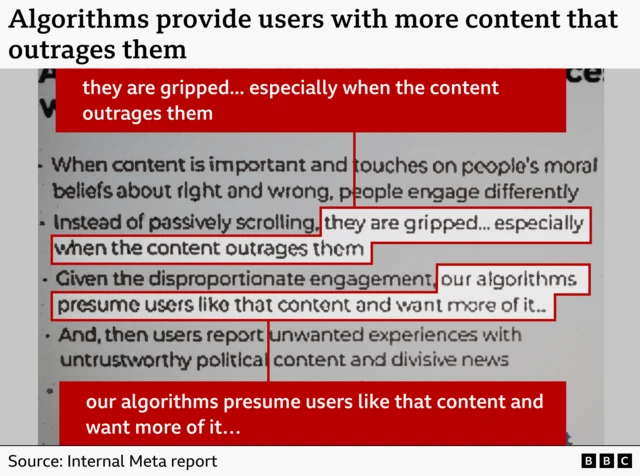

په هماغه وخت کې چې فېسبوک ادعا کوله چې دوی یوازې د ټولنې "یوه هنداره" دي، هغه داخلي اسناد چې د لوړپوړي څېړونکي ماټ موټیل لخوا بي بي سي ته ورکړل شوي، ښيي چې شرکت پوهېده، چې د خلکو د غوسې پارولو او ان د زیان هڅولو محتوا زیاته خپروي.

د اسنادو له مخې، حساسه محتوا لکه هغه پوسټونه چې د خلکو اخلاقي باورونو ته لاس وراچوي یا تاوتریخوالي ته پارونه کوي، ډېر احتمال لري چې په پلاټفورم کې پیاوړی غبرګون او تعامل رامنځته کړي، په ځانګړي ډول، کله چې خلک غوسه کړي.

په څېړنه کې ویل شوي "د ډېر زیات تعامل له امله، زموږ الګوریتمونه دا اټکل کوي چې کاروونکي دا ډول محتوا خوښوي او غواړي نور هم ورته وګوري."

برانډون سیلورمن وايي، د مېټا مشرتابه په پیل کې په دې اړه ډاډه نه و چې د پلاټفورم پر سر د زهرجنې محتوا سره څنګه چلند وکړي، او یو وخت داسې و، چې شرکت "په رښتیا ځان ته کتنه" کوله.

خو هغه وايي، وروسته د شرکت دریځ ورو ورو په دفاعي حالت بدل شو. د هغه په وینا، د شرکت چلند داسې شو:

"موږ د ټولنې د ټول قطبي کېدو (polarisation) مسؤل نه یو."

سیلورمن وايي "هیڅوک نه وايي چې تاسې د ټول قطبي کېدو مسؤل یاست. موږ یوازې دا وایو چې تاسې پکې ونډه لرئ او ښايي په داسې لارو چې اړتیا یې هم نه وي درومی . که تاسې یوازې څو بدلونونه راوړئ، ښايي دومره اغېز ونه کړی."

د دې افشا کوونکو د ادعاوو په ځواب کې، د مېټا ویاند دا تورونه رد کړل. هغه وايي "حقیقت دا دی چې موږ د خپلو پلاټفورمونو د کاروونکو د ساتنې لپاره سخت قوانین لرو او په تېرو لسو کلونو کې مو د خوندیتوب او امنیت په برخه کې سترې پانګونې کړې دي."

شرکت دا هم وايي، دوی د تنکیو ځوانانو د ساتنې لپاره حقیقي بدلونونه راوستي دي، لکه د "ټین اکاونټس " په نوم نوی فیچر، چې پکې د خوندیتوب جوړ شوي وسایل او داسې تنظیمات شته چې والدین پرې د خپلو ماشومانو تجربه اداره کولی شي.

په دې راپور کې اضافي څېړنه د دایسي باټا، ایز رابرټس او رابرټ پرقیوهار لخوا شوې.