தேர்தல்களில் உண்மையைத் திரிக்கும் செயற்கை நுண்ணறிவு, டீப் ஃபேக் தொழில்நுட்பங்கள்

பட மூலாதாரம், Screengrab

- எழுதியவர், மெரில் செபாஸ்டியன்

- பதவி, பிபிசி நியூஸ், கொச்சி

கடந்த ஆண்டு நவம்பரில், முரளிகிருஷ்ணன் சின்னதுரை பிரிட்டனில் நடந்த தமிழ் மொழி நிகழ்வின் நேரடி ஒளிபரப்பைப் பார்த்துக் கொண்டிருந்தார். அப்போது விசித்திரமான ஒன்றைக் கவனித்தார். தமிழீழ விடுதலைப் புலிகள் அமைப்பின் தலைவர் வேலுப்பிள்ளை பிரபாகரனின் மகள் துவாரகா என்ற அறிமுகத்துடன் பெண் ஒருவரின் உரை ஒளிப்பரப்பானது.

இதில் பிரச்னை என்னவென்றால், துவாரகா இறந்து 10 ஆண்டுகளுக்கு மேல் ஆகிவிட்டது. 2009 இல் இலங்கை உள்நாட்டுப் போரின் இறுதி நாட்களில் ஒரு வான்வழித் தாக்குதலில் துவாரகா உயிரிழந்ததாக கூறப்பட்டது. அந்த சமயத்தில் 23 வயதான துவாரகாவின் உடல் கண்டுபிடிக்கப் படவில்லை.

அப்படியிருக்க, தற்போது ஒரு நடுத்தர வயதுப் பெண்ணாக தோன்றும் துவாரகா அந்த காணொளியில் உலகம் முழுவதும் உள்ள தமிழர்கள் தங்கள் சுதந்திரத்திற்கான அரசியல் போராட்டத்தை முன்னெடுத்துச் செல்லுமாறு அறிவுறுத்துகிறார்.

தமிழ்நாட்டில் போலிச் செய்திகளைக் கண்டறிவதற்கான பணியில் ஈடுபட்டிருக்கும் சின்னதுரை, அந்த வீடியோவை உன்னிப்பாகப் பார்த்தார், வீடியோவில் உள்ள குறைபாடுகளைக் கவனித்தார், அதன் பின்னர் அவருக்கு உண்மை புரிந்தது. அது செயற்கை நுண்ணறிவு (AI) மூலம் உருவாக்கப்பட்ட உருவம் என்று முடிவுக்கு வந்தார்.

அந்தக் காணொளி ஏற்படுத்தும் சாத்தியமான சிக்கல்கள் சின்ன துரைக்கு தெளிவாகத் தெரிந்தன: "இது தமிழ்நாட்டில் ஒரு உணர்ச்சிப்பூர்வமான பிரச்னை சார்ந்த விஷயம், மேலும் தேர்தல் சமயம் என்பதால், தவறான தகவல் விரைவில் பரவக்கூடும்." என்றார்.

பட மூலாதாரம், Getty Images

இந்தியாவில் தேர்தல் சூழலில் இது போன்ற செயற்கை நுண்ணறிவு தொழில்நுட்பத்தில் உருவாக்கப்படும் பகிர்வுகளை தவிர்க்க முடியாது - பிரசார வீடியோக்கள், இந்திய மொழிகளில் தனிப்பயனாக்கப்பட்ட ஆடியோ செய்திகள் மற்றும் வேட்பாளர்களின் குரலில் வாக்காளர்களுக்கு செய்யப்படும் தானியங்கி அழைப்புகள் வரை கட்டுப்படுத்துவது சிரமம்.

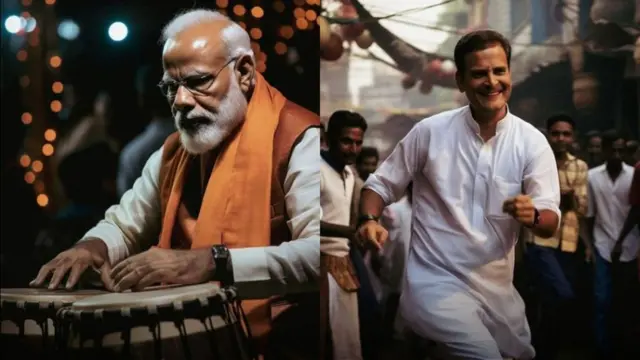

ஷாஹித் ஷேக் போன்ற டிஜிட்டல் படைப்பாளிகள் இந்திய அரசியல்வாதிகளை நாம் இதுவரை பார்த்திராத அவதாரங்களில் செயற்கை நுண்ணறிவு தொழில்நுட்பத்தை பயன்படுத்தி வேடிக்கையாக உருவகப்படுத்தி ரசிக்கின்றனர். பிரபலங்கள் விளையாட்டு வீரர்களின் உடைகள் அணிந்திருப்பது போன்றும், இசை மற்றும் நடனம் ஆடுவது போன்றும் காணொளிகள் உருவாக்கப்பட்டு அதிகம் பகிரப்பட்டது.

ஆனால் இந்த தொழில்நுட்பம் அதிநவீனமாகி எளிதில் கிடைப்பதால், இதை பயன்படுத்தி, பலர் போலி செய்திகளை உண்மையாக்கி பகிர்கின்றனர். போலி செய்திகளின் தாக்கங்கள் குறித்து வல்லுநர்கள் கவலை தெரிவித்துள்ளனர்.

"வதந்திகள் எப்போதுமே தேர்தல் பிரசாரத்தின் ஒரு பகுதியாக இருக்கும். ஆனால் சமூக ஊடகங்களின் யுகத்தில், வதந்திதள், போலி பகிர்வுகள் காட்டுத்தீ போல் பரவுகிறது. இது உண்மையில் நாட்டையே தீக்கிரையாக்கும்" என்கிறார் நாட்டின் முன்னாள் தலைமை தேர்தல் ஆணையர் எஸ்.ஒய்.குரேஷி.

பட மூலாதாரம், Sahixd

செயற்கை நுண்ணறிவின் சமீபத்திய முன்னேற்றங்களை இந்திய அரசியல் கட்சிகள் மட்டும் பயன்படுத்திக் கொள்ளவில்லை. நமது எல்லைக்கு அப்பால் இருக்கும் பாகிஸ்தானில், சிறையில் இருக்கும் அரசியல்வாதி இம்ரான் கானின் உரை செயற்கை நுண்ணறிவு மூலம் தேர்தல் பேரணியில் ஒலித்தது.

மேலும் இந்தியாவில், பிரதமர் நரேந்திர மோதி வளர்ந்து வரும் தொழில்நுட்பத்தை திறம்பட பிரசாரம் செய்ய பயன்படுத்துகிறார் - பார்வையாளர்கள் மத்தியில் இந்தியில் உரையாற்றுகிறார். ஆனால், அரசாங்கத்தால் உருவாக்கப்பட்ட செயற்கை நுண்ணறிவு கருவியான `பாஷினி’ மூலம் அவரின் உரை நிகழ் நேரத்தில் தமிழில் மொழிபெயர்க்கப்பட்டு ஒளிப்பரப்பாகிறது.

அதே சமயம் இந்த தொழில்நுட்பம் வார்த்தைகளையும் செய்திகளையும் திரித்து கையாளவும் பயன்படுகிறது.

கடந்த மாதம், பாலிவுட் நட்சத்திரங்கள் ரன்வீர் சிங் மற்றும் அமீர்கான் ஆகியோர் காங்கிரஸ் கட்சிக்காக பரப்புரை செய்வது போல் இரண்டு வீடியோக்கள் அதிகம் பகிரப்பட்டது. இவை டீப் ஃபேக் (deepfakes) என்றும், தங்களின் அனுமதியின்றி செய்யப்பட்டவை என்றும் இருவரும் போலீஸில் புகார் அளித்தனர்.

பின்னர், ஏப்ரல் 29 அன்று, பிரதமர் மோதி, ஆளும் கட்சியின் மூத்த தலைவர்களின் பேச்சுகளை திரித்து செயற்கை நுண்ணறிவு தொழில்நுட்பத்தைப் பயன்படுத்தி போலி காணொளிகள் உருவாக்கப்படுவதாக கவலை தெரிவித்தார். அவரின் பேச்சுகளும் மாற்றப்படுவதாக குறிப்பிட்டார். பிரதமர் வருத்தம் தெரிவித்த அடுத்த நாளே, உள்துறை அமைச்சர் அமித் ஷாவின் போலி வீடியோ தொடர்பாக எதிர்க்கட்சிகளான ஆம் ஆத்மி மற்றும் காங்கிரஸ் உறுப்பினர்கள் இருவரை போலீஸார் கைது செய்தனர்.

மோதியின் பாரதிய ஜனதா கட்சி மீதும் எதிர்க்கட்சித் தலைவர்கள் இதுபோன்ற குற்றச்சாட்டுகளை முன்வைத்தனர். பிரச்னை என்னவென்றால் - கைது செய்யப்பட்ட போதிலும் - நிபுணர்களின் கூற்றுப்படி விரிவான ஒழுங்குமுறை எதுவும் உருவாக்கப்படவில்லை.

பட மூலாதாரம், Sahixd

அதாவது, "இதுபோன்று ஏதாவது தவறு செய்து பிடிபட்டால், அவர்கள் மீது மிகவும் குறைவான தண்டனைக்குரிய நடவடிக்கை எடுக்கப்படும்" என்று தரவு மற்றும் பாதுகாப்பு ஆய்வாளர் ஸ்ரீனிவாஸ் கோடாலி கூறுகிறார்.

படைப்பாளிகள் பிபிசியிடம் பகிர்கையில், "ஒழுங்குமுறை இல்லாத நிலையில் தாங்கள் எந்த வகையான வேலையைச் செய்ய வேண்டும் அல்லது செய்யக்கூடாது என்பதைத் தீர்மானிக்க தனிப்பட்ட நெறிமுறைகளை நம்பியிருக்க வேண்டி உள்ளது” என்று கூறினார்கள்.

அரசியல்வாதிகள், அவர்களது போட்டியாளர்களின் நற்பெயருக்கு களங்கம் விளைவிக்கும் வகையில் ஆபாசமான சித்தரிப்புகள், வீடியோக்கள் மற்றும் ஆடியோக்களை மார்பிங் செய்தல் உள்ளிட்ட செயல்களுக்கு கோருவதாக படைப்பாளிகள் பிபிசியிடம் கூறுகின்றனர்.

"ஒருமுறை அரசியல்வாதி ஒருவரின் சர்ச்சை வீடியோ வைரலானது. அந்த உண்மையான வீடியோவையே டீப் ஃபேக் போல் உருவாக்கும்படி என்னிடம் கேட்கப்பட்டது, ஏனெனில் அசல் வீடியோ, பரவலாகப் பகிரப்பட்டால், அரசியல்வாதி மீது மோசமான விமர்சனங்கள் வரும்” என்று திவ்யேந்திர சிங் ஜாடூன் நடந்ததை விவரித்தார்.

திவ்யேந்திர சிங் ஜாடூன், தி இந்தியன் டீப்ஃபேக்கரின் (TID) நிறுவனர். இவரின் நிறுவனம் இந்திய அரசியல்வாதிகளுக்கான பிரசார படைப்புகளை உருவாக்க AI மென்பொருளைப் பயன்படுத்துகிறது. இவர்கள் உருவாக்கும் வீடியோக்களில், இது உண்மையானது அல்ல என்பதை குறிப்பிடும் `disclaimers’ சேர்க்கப்படுகிறது.

பட மூலாதாரம், Getty Images

மேற்கு வங்கத்தில் ஒரு மார்க்கெட்டிங் ஏஜென்சியில் பணிபுரியும் ஷேக், சமூக ஊடகங்களில் அரசியல்வாதிகள் மற்றும் அரசியல் கட்சி இணையத்தளங்களில் தன் அனுமதி இன்றி தனது படைப்புகளை பகிர்ந்துள்ளதை கண்டுள்ளார்.

"ஒரு அரசியல்வாதி நான் செயற்கை நுண்ணறிவு தொழில்நுட்பத்தில் உருவாக்கிய மோதியின் புகைப்படத்தை என் பெயரை குறிப்பிடாமல் பயன்படுத்தினார், மேலும் அது AI ஐப் பயன்படுத்தி உருவாக்கப்பட்டது என்றும் குறிப்பிடவில்லை," என்று அவர் கூறுகிறார்.

"ஒரு டீப் ஃபேக்கை உருவாக்குவது இப்போது மிகவும் எளிதானது. எங்களுக்கு ஏழு அல்லது எட்டு நாட்கள் எடுத்துக்கொண்ட வேலை, இப்போது மூன்று நிமிடங்களில் செய்துவிட முடியும். உங்களிடம் ஒரு கணினி இருந்தால் போதும்." என்று ஜாடூன் விளக்குகிறார்.

உண்மையில், இரண்டு நபர்களிடையே போலி தொலைபேசி அழைப்பை உருவாக்குவது எவ்வளவு எளிது என்பதை பிபிசி நேரடியாக கண்டது - இந்த விஷயத்தில், பிபிசி நிருபரும் முன்னாள் அமெரிக்க அதிபர் டொனால்ட் டிரம்பும் பேசுவது போன்று வீடியோ உருவாக்கப்பட்டது

அபாயங்கள் இருந்தபோதிலும், செயற்கை நுண்ணறி தொழில்நுட்பத்துக்கான ஒழுங்குமுறை சட்டத்தை பரிசீலிக்கவில்லை என்று இந்தியா முதலில் கூறியது. எவ்வாறாயினும், இந்த மார்ச் மாதத்தில், "மோதி ஒரு பாசிசவாதியா?" என்ற வினவலுக்கு கூகுளின் ஜெமினி சாட்பாட் பதிலளிப்பது போன்ற நிகழ்வு சர்ச்சையை ஏற்படுத்தியது. அந்த சம்பவம் மீதான கோபத்திற்கு பிறகு இந்தியாவில் செயற்கை நுண்ணறிவு தொடர்பான சட்டம் செயல்பாட்டிற்கு வந்தது.

பட மூலாதாரம், Getty Images

இது நாட்டின் தகவல் தொழில்நுட்ப சட்டங்களை மீறியுள்ளதாக அந்நாட்டின் இளநிலை தகவல் தொழில்நுட்பத்துறை அமைச்சர் ராஜீவ் சந்திரசேகர் தெரிவித்துள்ளார்.

"அப்போதிருந்து, இந்திய அரசாங்கம் "நம்பகமற்ற" அல்லது "சோதனை செய்யப்படாத" ஜெனரேடிவ் AI மாதிரிகள் அல்லது கருவிகளை பகிரங்கமாக வெளியிடுவதற்கு முன், அதன் வெளிப்படையான அனுமதியை பெறுமாறு தொழில்நுட்ப நிறுவனங்களை கேட்டுக் கொண்டுள்ளது. ’தேர்தல் செயன்முறையின் நேர்மையை அச்சுறுத்தும்’ இந்த தொழில்நுட்பங்களின் பதில்களுக்கு எதிராகவும் அது எச்சரிக்கை விடுத்தது”

ஆனால் இது போதாது. போலி செய்திகளை கண்டறியும் நிபுணர்கள், இதுபோன்ற உள்ளடக்கத்தை நீக்குவது ஒரு கடினமான பணியாகும், குறிப்பாக தேர்தல்களின் போது தவறான தகவல்கள் உச்சத்தைத் தொடும் போது யாராலும் கட்டுப்படுத்த முடியாது.

"ஒவ்வொரு தகவலும் ஒரு மணி நேரத்திற்கு 100 கிமீ வேகத்தில் பயணிக்கிறது" என்கிறார் தமிழகத்தில் ஊடக கண்காணிப்பு அமைப்பை சேர்ந்த சின்னதுரை. "ஆனால் நாங்கள் பரப்பும் தகவல்கள் மணிக்கு 20 கிமீ வேகத்தில் தான் மக்களை சேரும்." என்கிறார்.

மேலும் இந்த போலி படைப்புகள் முக்கிய ஊடகங்களில் கூட நுழைகின்றன என்கிறார் கோடாலி. இருந்தபோதிலும், "தேர்தல் ஆணையம் ஏஐ குறித்து மௌனமாக உள்ளது. பெரிய அளவில் விதிகள் எதுவும் இல்லை. அவர்கள் உண்மையான விதிமுறைகளை கொண்டு வருவதற்கு பதிலாக தொழில்நுட்பத் துறையை சுய-ஒழுங்குபடுத்த சொல்கிறார்கள்." என்கிறார்.

"ஆனால் இப்போதைக்கு போலி படைப்புகளை பகிர்பவர்களுக்கு எதிராக நடவடிக்கை எடுக்கப்பட்டால், அது சரிபார்க்கப்படாத தகவல்களை பகிரும் மக்களையும் பயமுறுத்தக்கூடும். ஏஐ பயன்பாட்டில் கட்டுப்பாடுகள் வேண்டும்" என்று குரேஷி கூறுகிறார்.

(சமூக ஊடகங்களில் பிபிசி தமிழ் ஃபேஸ்புக், இன்ஸ்டாகிராம், எக்ஸ் (டிவிட்டர்) மற்றும் யூட்யூப் பக்கங்கள் மூலம் எங்களுடன் இணைந்திருங்கள்.)