Comment l'IA peut lire nos pensées intimes les plus secrètes

Crédit photo, University of California, Davis

- Author, Laurie Clarke

- Role, BBC Future

- Temps de lecture: 12 min

Le crépitement de l'électricité dans votre cerveau a longtemps été trop complexe à décoder. L'intelligence artificielle est en train de changer cela.

La femme ne bougeait pas, à part le mouvement de sa poitrine qui se soulevait et s'abaissait au rythme de sa respiration. Elle avait les yeux fixés, concentrés, et les mains serrées en poings. Des mots s'affichaient sur un écran devant elle, s'assemblant lentement pour former des phrases complètes. Des phrases qu'elle ne pouvait pas prononcer à voix haute.

Cette femme de 52 ans était paralysée depuis 19 ans à la suite d'un accident vasculaire cérébral qui l'avait rendue incapable de parler clairement. Ici, cependant, son monologue intérieur apparaissait sous ses yeux.

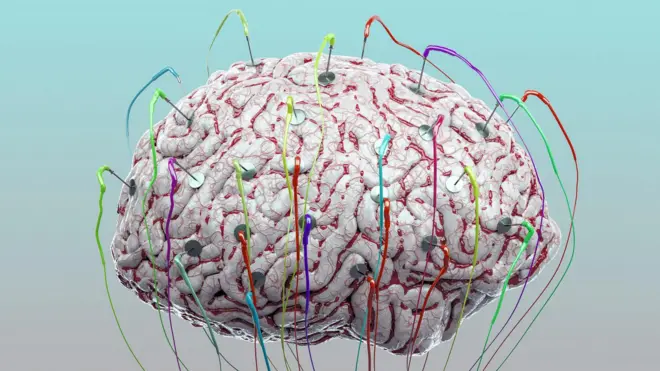

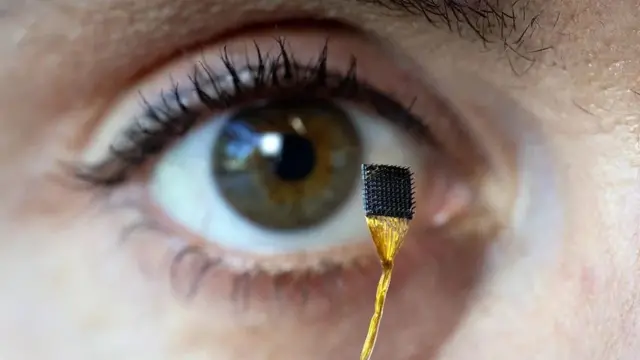

Cette femme, identifiée uniquement sous le nom de participante T16, avait été équipée d'un minuscule réseau d'électrodes qui avait été inséré chirurgicalement dans un lobe à l'avant de son cerveau. Désormais, un ordinateur, alimenté par une forme d'intelligence artificielle, décodait les signaux produits par ses neurones lorsqu'elle imaginait prononcer des mots, le système les traduisant en texte sur un écran. Elle participait à une étude à l'université de Stanford en Californie, aux États-Unis, aux côtés de trois patients atteints de la maladie neurodégénérative appelée sclérose latérale amyotrophique (SLA), afin de tester une technique capable de traduire les pensées en texte en temps réel.

End of A lire aussi sur BBC Afrique:

C'était ce qui se rapprochait le plus d'une forme de « lecture dans les pensées » à laquelle les scientifiques étaient parvenus jusqu'alors.

Les chercheurs ont dévoilé leur succès en août 2025. Quelques mois plus tard, des chercheurs japonais ont révélé une technique de « sous-titrage mental » capable de générer des descriptions détaillées et précises de ce qu'une personne voit ou imagine dans son esprit. Elle combinait trois outils d'IA différents avec des scanners cérébraux non invasifs pour traduire l'activité cérébrale d'une personne.

Ces deux études sont les dernières d'une série de percées qui ouvrent aux neuroscientifiques une nouvelle fenêtre sur le fonctionnement interne du cerveau humain et offrent des possibilités d'aider les personnes qui ne peuvent pas communiquer par d'autres moyens. À terme, cependant, cela pourrait transformer radicalement la façon dont nous interagissons tous avec le monde qui nous entoure et même entre nous.

« Au cours des prochaines années, nous commencerons à voir ces technologies commercialisées et déployées à grande échelle », déclare Maitreyee Wairagkar, neuro-ingénieure qui développe des interfaces cerveau-ordinateur au laboratoire de neuroprothèses de l'université de Californie à Davis, aux États-Unis. Plusieurs entreprises, dont Neuralink d'Elon Musk, cherchent déjà à produire des puces cérébrales commerciales qui permettront à cette technologie de sortir des laboratoires pour entrer dans le monde réel. « C'est très excitant », déclare Mme Wairagkar.

Crédit photo, Université de Californie, Davis

Des informations vérifiées à portée de main

Cliquez ici et abonnez-vous !

Fin de Promotion WhatsApp

Les scientifiques travaillent depuis étonnamment longtemps sur des dispositifs capables de communiquer directement avec le cerveau humain, appelés interfaces cerveau-ordinateur (ICO). En 1969, le neuroscientifique américain Eberhard Fetz a démontré que les singes pouvaient apprendre à déplacer l'aiguille d'un compteur grâce à l'activité d'un seul neurone de leur cerveau s'ils recevaient une boulette de nourriture en échange. Dans une expérience plus singulière menée à la même époque, le scientifique espagnol Jose Delgado a réussi à stimuler à distance le cerveau d'un taureau enragé, le faisant s'arrêter en pleine charge.

Les interfaces cerveau-ordinateur (ICO) sont capables depuis des décennies de décoder les signaux cérébraux qui accompagnent les mouvements, permettant ainsi aux utilisateurs de contrôler une prothèse ou un curseur à l'écran. Mais les ICO qui traduisent les signaux vocaux ou d'autres pensées complexes à partir des signaux cérébraux ont mis plus de temps à évoluer. « Les premiers travaux ont été menés sur des primates non humains... et, évidemment, on ne peut pas étudier la parole chez les singes », explique M. Wairagkar.

Ces dernières années, cependant, le domaine a fait des progrès impressionnants dans ses efforts pour décoder la parole des personnes ayant des capacités de communication réduites, par exemple les patients atteints de SLA entraînant une paralysie ou le syndrome d'enfermement.

Les chercheurs de l'université de Stanford ont ainsi annoncé en 2021 avoir réussi à prouver la faisabilité d'un concept permettant à un homme tétraplégique de produire des phrases en anglais en s'imaginant dessiner des lettres dans l'air avec sa main. Grâce à cette méthode, il a pu écrire 18 mots par minute.

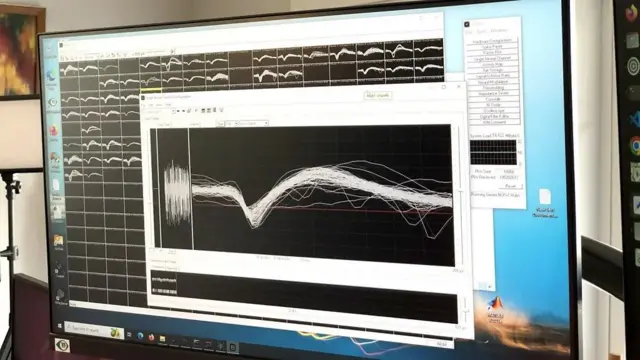

La parole humaine naturelle est d'environ 150 mots par minute, donc l'étape suivante consistait à décoder les mots à partir de l'activité neuronale associée à la parole elle-même. En 2024, le laboratoire de Wairagkar a testé une technique qui traduisait directement en texte sur un écran d'ordinateur les tentatives de parole d'un homme de 45 ans atteint de SLA. Avec une vitesse d'environ 32 mots par minute et une précision de 97,5 %, il s'agissait de la première démonstration de la manière dont les interfaces cerveau-ordinateur pouvaient faciliter la communication quotidienne, explique Wairagkar.

Ces méthodes reposent sur de minuscules « réseaux » de microélectrodes qui sont implantés chirurgicalement à la surface du cerveau. Les réseaux enregistrent les schémas d'activité neuronale de la zone du cerveau où ils sont placés, et les signaux sont convertis en signification par un algorithme informatique. C'est là que la puissance de l'apprentissage automatique, un type d'intelligence artificielle, a été révolutionnaire. Ces algorithmes sont capables de reconnaître des schémas à partir d'énormes quantités de données disparates. Dans le cas du décodage de la parole, les algorithmes d'apprentissage automatique sont entraînés à reconnaître les schémas d'activité neuronale associés à différents phonèmes, les plus petits éléments constitutifs du langage.

Les chercheurs ont comparé ce processus au traitement effectué par les assistants intelligents tels qu'Alexa d'Amazon. Mais au lieu d'interpréter des sons, l'IA interprète des signaux neuronaux.

Libérer le discours intérieur

Aussi impressionnants que soient ces récents efforts de décodage de la parole, certains obstacles subsistent. En général, les patients doivent essayer de prononcer les mots qu'ils souhaitent communiquer, même s'ils en sont physiquement incapables, afin que la technologie BCI puisse les traduire avec précision. En effet, les électrodes sont généralement placées dans le cortex moteur, la zone responsable des mouvements musculaires.

Cependant, essayer de parler demande des efforts, ce qui rend le processus de communication lent et laborieux. Pour leur dernière tentative, les chercheurs de l'université de Stanford ont voulu tester s'il existait un moyen plus simple : pouvaient-ils concevoir une méthode qui permettrait de capter la « parole intérieure » en temps réel, en plus de la « parole tentée » ?

« Nous leur avons demandé de compter le nombre de formes d'une certaine couleur à l'écran, car nous avons pensé que dans ce type de tâche, ils accompliraient probablement cette action en comptant littéralement les chiffres dans leur tête », explique Frank Willett, codirecteur du Neural Prosthetics Translational Laboratory de l'université de Stanford, qui était l'un des auteurs de l'étude impliquant la femme mentionnée au début de cet article. « Et c'est ce que nous avons observé. Nous avons vu des traces de ces mots numériques passer par le cortex moteur, que nous avons pu détecter. »

Crédit photo, Université de Californie, Davis

La réponse à la question de savoir si la technologie pouvait identifier le langage intérieur était un « oui » provisoire. Pour une tâche consistant à imaginer une phrase, les chercheurs ont pu atteindre un taux de précision allant jusqu'à 74 % en temps réel. Pour les tâches conçues pour susciter un langage intérieur spontané, la précision était réduite, mais restait supérieure au hasard. Cependant, dans des conditions plus ouvertes, où ils ont donné aux participants des consignes telles que « pensez à votre citation préférée d'un film », le langage décodé était pour l'essentiel incompréhensible.

« Avec la technologie actuelle, nous ne sommes pas en mesure d'obtenir le discours intérieur d'une personne sans aucun filtre et avec une précision parfaite », a déclaré Willett. « Mais nous avons pu capter assez clairement des traces de discours intérieur dans ces différentes tâches. »

L'étude a également mis en lumière le fonctionnement du discours intérieur dans notre cerveau. Elle a révélé que les schémas neuronaux du discours intérieur étaient fortement corrélés à ceux du discours tenté dans le cortex moteur, mais que les signaux émis étaient plus faibles. Cela fait écho à des études antérieures en neuroimagerie et en électrophysiologie qui ont montré que le discours intérieur mobilise un réseau cérébral similaire à celui du discours produit physiquement.

Au-delà des mots

Le laboratoire de Wairagkar à l'université de Californie, Davis, a réalisé une avancée majeure en 2025 en démontrant qu'il était possible de décoder non seulement les mots, mais aussi les éléments non verbaux du langage tels que l'intonation, la hauteur, la vitesse et le rythme. En substance, cela permettait aux patients de communiquer non seulement les mots eux-mêmes, mais aussi les expressions et les intonations.

« La parole humaine est bien plus que du texte à l'écran », explique Mme Wairagkar. « La plupart de nos communications passent par la façon dont nous parlons, dont nous nous exprimons ; ce que nous disons a des significations différentes selon le contexte. »

Mme Wairagkar et ses collègues ont démontré que leur prototype pouvait produire des sons vocaux à voix haute, comme l'a tenté un patient atteint de SLA souffrant d'un trouble moteur grave de la parole.

Le participant était capable de moduler ses mots pour transmettre du sens, ce qui est essentiel. « Notre participant était capable de poser une question en modulant sa voix à la fin de la phrase et de changer de ton pendant qu'il parlait », explique Wairagkar. « Nous l'avons démontré à travers une tâche simple où il chantait des mélodies. »

Le résultat n'était pas parfait, mais 60 % des mots ont été jugés intelligibles par les testeurs. Bien que cette technologie soit encore loin d'égaler les meilleures technologies de conversion du cerveau en texte, elle a démontré ce qui pourrait être possible dans un avenir proche.

Wairagkar et Willett pensent tous deux que des progrès supplémentaires sont imminents. Une piste d'amélioration pourrait simplement consister à augmenter le nombre de microélectrodes placées sur le cerveau. « Notre cerveau compte des milliards de neurones et des trillions de connexions », explique Wairagkar. Dans sa dernière étude, « nous n'en avons échantillonné que 256 ».

« Des appareils plus récents et une technologie plus performante permettront d'échantillonner davantage de neurones, d'obtenir des informations plus riches et d'obtenir un discours intelligible en temps réel », ajoute-t-elle.

Willett souhaite approfondir ses recherches sur le langage intérieur, en particulier, et prévoit d'étudier comment d'autres zones du cerveau, en dehors du cortex moteur, pourraient être impliquées. « Une zone qui nous intéresse particulièrement est le gyrus temporal supérieur », explique-t-il, en référence à une zone du cerveau impliquée dans le traitement auditif, qui pourrait également jouer un rôle dans le langage intérieur, par exemple « les représentations auditives de ce que vous imaginez entendre dans votre tête ».

Il pourrait également être important de regarder au-delà du cortex moteur pour aider les personnes qui présentent des lésions cérébrales dans cette région, par exemple les victimes d'accidents vasculaires cérébraux dont le cortex moteur est endommagé, mais qui peuvent encore comprendre la parole. Selon Willett, la découverte d'autres zones du cerveau impliquées dans le langage intérieur pourrait un jour aider ces personnes à communiquer.

Il faut le voir pour le croire

Alors que les chercheurs spécialisés dans les interfaces cerveau-ordinateur se concentrent sur les applications pratiques de cette technologie qui peuvent aider les patients, d'autres domaines progressent dans le décodage des scanners cérébraux et nous aident à mieux comprendre le fonctionnement du cerveau.

L'un d'entre eux consiste à recréer les images vues par un individu en analysant simplement ses scanners cérébraux à l'aide de l'IA. Le principe est le suivant : on montre des images aux participants tandis que leur activité cérébrale est enregistrée par imagerie par résonance magnétique fonctionnelle (IRMf), une technique qui mesure l'activité cérébrale en détectant les changements dans le flux sanguin vers différentes régions du cerveau. Les données neuronales sont ensuite décodées par un algorithme et transmises à un générateur d'images IA, qui tente de reproduire les images vues par le sujet.

Crédit photo, Jim Gensheimer/Université de Stanford

Les chercheurs tentent de résoudre cette énigme depuis des décennies, mais l'essor de l'IA générative ces dernières années a donné un coup de fouet à ce domaine. Les derniers générateurs d'images IA, tels que Stable Diffusion, ont considérablement amélioré la qualité des images produites.

Yu Takagi, professeur associé à l'Institut de technologie de Nagoya au Japon, a publié en 2023 une étude suivant cette méthode qui utilisait un algorithme Stable Diffusion. L'algorithme a été entraîné à partir d'un ensemble de données en ligne créé par l'université du Minnesota, composé de scanners cérébraux de quatre participants qui ont chacun visionné un ensemble de 10 000 photos. Dans de nombreux cas, l'IA a été capable de restituer une impression acceptable de l'image originale, même si elle a été complètement déconcertée par un saladier.

Ce domaine progresse désormais rapidement. Une étude publiée l'année dernière par des chercheurs israéliens a permis de reproduire des images encore plus précises.

Selon Takagi, ces études ont permis de mieux comprendre comment le cerveau traite les informations visuelles. Il s'avère que deux parties distinctes du cerveau jouent un rôle crucial. Le lobe occipital, situé à l'arrière du cerveau, encode les aspects visuels « de bas niveau » d'une image, tels que la disposition, la perspective et la couleur. Quant au lobe temporal, situé derrière les tempes, il encode les éléments conceptuels « de haut niveau » qui permettent de classer un objet en fonction de sa nature réelle.

Le son de la musique

Des efforts sont également déployés pour reconstruire les expériences auditives. En 2025, Takagi a publié une étude qui utilisait un algorithme propriétaire de Google pour tenter de reproduire le son à partir d'IRMf réalisées pendant que les sujets écoutaient des morceaux de musique.

Takagi affirme que cela peut être plus difficile que de reconstruire des informations visuelles, car la musique change constamment, alors que le scanner IRMf ne peut effectuer des scans qu'à des intervalles d'une seconde. « La qualité de la reconstruction est inférieure à celle de la reconstruction d'images », explique Takagi. « Mais nous avons tout de même réussi à reconstruire le caractère de la musique et la catégorie de base. »

Ce domaine a enrichi notre compréhension des bases neuronales de la perception musicale.

« Ce qui nous a surpris dans cette étude, c'est que la perception de la musique dans le cerveau est différente de la perception des images », explique Takagi. « Pour les images, les informations de haut niveau et les informations de bas niveau ont des emplacements distincts dans le cerveau. Pour la musique, nous avons constaté que la sémantique et les informations de bas niveau ne sont pas séparées. »

Takagi est enthousiasmé par certaines des applications potentielles de ces approches. Elles pourraient permettre de recréer les hallucinations auditives et visuelles de patients psychiatriques tels que les schizophrènes afin de mieux comprendre leur état, explique-t-il. Ces techniques pourraient être utilisées pour recréer ce que les animaux ressentent lorsqu'ils appréhendent le monde, voire pour reconstruire des rêves.

« Beaucoup de gens posent cette question », dit Takagi en riant. Il aimerait un jour recréer des rêves, mais pour l'instant, cela reste extrêmement compliqué. Certaines recherches ont même soulevé la perspective d'une communication directe de cerveau à cerveau, y compris avec plusieurs personnes à la fois, bien que les implications éthiques et les questions relatives aux droits de l'homme liées aux dispositifs qui permettent cela restent encore à élucider.

À ceux qui espèrent qu'il sera également possible de stimuler des expériences visuelles ou auditives dans le cerveau à des fins de divertissement, Takagi conseille de faire preuve de patience. Bien que cela soit théoriquement possible, il estime que les limites techniques font que cela ne se produira probablement pas avant 10 à 20 ans.