Les personnes qui pensent que l'IA pourrait devenir consciente

- Author, Pallab Ghosh

- Role, Science correspondent

- Temps de lecture: 12 min

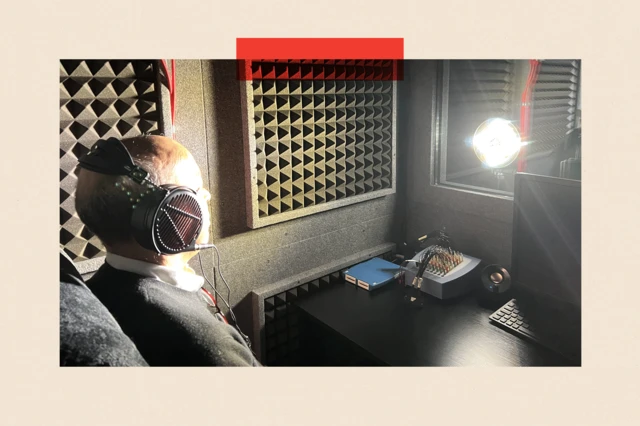

C'est avec une certaine appréhension que j'entre dans la cabine. Je suis sur le point d'être soumis à un éclairage stroboscopique sur fond de musique, dans le cadre d'un projet de recherche visant à comprendre ce qui fait de nous des êtres humains à part entière.

Cette expérience me rappelle le test du film de science-fiction Bladerunner, conçu pour distinguer les humains des êtres créés artificiellement et se faisant passer pour des humains.

Pourrais-je être un robot du futur sans le savoir ? Est-ce que je réussirais le test ?

Les chercheurs m'assurent que ce n'est pas le but de l'expérience. L'appareil qu'ils appellent « Dreamachine », d'après l'émission publique du même nom, est conçu pour étudier comment le cerveau humain génère nos expériences conscientes du monde.

End of A lire aussi sur BBC Afrique:

Lorsque le stroboscope commence, et bien que mes yeux soient fermés, je vois des motifs géométriques bidimensionnels tourbillonnants. C'est comme si je sautais dans un kaléidoscope, avec des triangles, des pentagones et des octogones en constante évolution. Les couleurs sont vives, intenses et changeantes : des roses, des magentas et des turquoises qui brillent comme des néons.

La « Dreamachine » met en évidence l'activité interne du cerveau à l'aide de lumières clignotantes, dans le but d'explorer le fonctionnement de nos processus de pensée.

Selon les chercheurs, les images que je vois sont propres à mon monde intérieur et à moi-même. Ils pensent que ces schémas peuvent nous éclairer sur la conscience elle-même.

Ils m'entendent murmurer : "C'est merveilleux, absolument merveilleux. C'est comme si je volais dans mon propre esprit !"

La « Dreamachine », au Centre for Consciousness Science de l'université de Sussex, n'est qu'un des nombreux nouveaux projets de recherche menés à travers le monde sur la conscience humaine : la partie de notre esprit qui nous permet d'être conscients de nous-mêmes, de penser, de ressentir et de prendre des décisions indépendantes sur le monde.

En étudiant la nature de la conscience, les chercheurs espèrent mieux comprendre ce qui se passe dans les cerveaux de silicium des intelligences artificielles. Certains pensent que les systèmes d'IA deviendront bientôt conscients de manière autonome, si ce n'est déjà fait.

Mais qu'est-ce que la conscience et dans quelle mesure l'IA est-elle sur le point de l'acquérir ? Et la croyance que l'IA pourrait elle-même être consciente, pourrait-elle fondamentalement changer l'homme au cours des prochaines décennies ?

De la science-fiction à la réalité

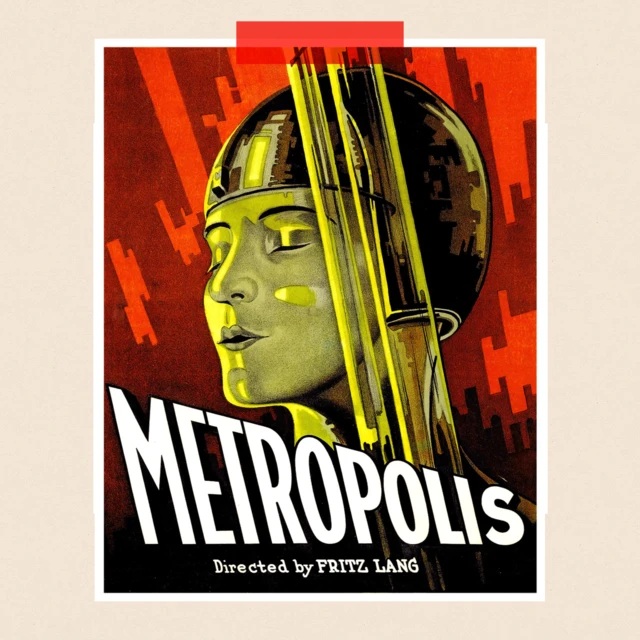

L'idée de machines dotées d'un esprit propre est explorée depuis longtemps dans la science-fiction. Les inquiétudes concernant l'IA remontent à près de cent ans, au film Metropolis, dans lequel un robot se fait passer pour une vraie femme.

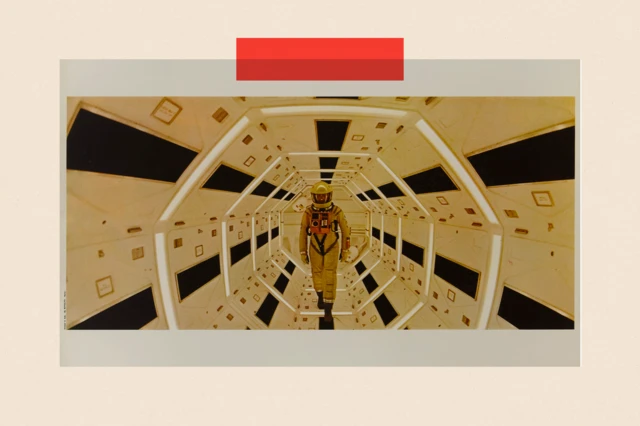

La crainte de voir les machines devenir conscientes et constituer une menace pour les humains est explorée dans le film 2001 : l'Odyssée de l'espace (1968), lorsque l'ordinateur HAL 9000 attaque les astronautes à bord de son vaisseau spatial. Et dans le dernier film de Mission Impossible, qui vient de sortir, le monde est menacé par une puissante IA malveillante, décrite par un personnage comme un "parasite numérique conscient de lui-même, capable d'apprendre par lui-même et mangeur de vérité".

Crédit photo, LMPC via Getty Images

Des informations vérifiées à portée de main

Cliquez ici et abonnez-vous !

Fin de Promotion WhatsApp

Mais tout récemment, dans le monde réel, on a assisté à un rapide basculement de la réflexion sur la conscience des machines, où des voix crédibles se sont inquiétées du fait qu'il ne s'agissait plus d'un sujet de science-fiction.

Ce changement soudain a été provoqué par le succès de ce que l'on appelle les grands modèles de langage (LLM), auxquels on peut accéder par l'intermédiaire d'applications sur nos téléphones, telles que Gemini et Chat GPT. La capacité de la dernière génération de LLM à tenir des conversations plausibles et fluides a surpris même leurs concepteurs et certains des plus grands experts dans ce domaine.

Certains penseurs sont de plus en plus nombreux à penser qu'à mesure que l'IA deviendra encore plus intelligente, les lumières s'allumeront soudainement à l'intérieur des machines et qu'elles deviendront conscientes.

D'autres, comme le professeur Anil Seth, qui dirige l'équipe de l'université du Sussex, ne sont pas d'accord et décrivent ce point de vue comme « aveuglément optimiste et motivé par l'exceptionnalisme humain ».

"Nous associons la conscience à l'intelligence et au langage parce qu'ils vont de pair chez les humains. Mais ce n'est pas parce qu'ils vont ensemble chez nous qu'ils vont ensemble en général, par exemple chez les animaux.

Qu'est-ce que la conscience ?

En bref, personne ne le sait. C'est ce qui ressort clairement des discussions animées mais robustes au sein de l'équipe du professeur Seth, composée de jeunes spécialistes de l'IA, d'experts en informatique, de neuroscientifiques et de philosophes, qui tentent de répondre à l'une des plus grandes questions de la science et de la philosophie.

Si les avis divergent au sein du centre de recherche sur la conscience, les scientifiques sont unis dans leur méthode : décomposer ce grand problème en une multitude de petits problèmes dans le cadre d'une série de projets de recherche, dont fait partie la Dreamachine.

Tout comme la recherche de "l'étincelle de vie" qui donnait vie aux objets inanimés a été abandonnée au 19e siècle au profit de l'identification du fonctionnement des différentes parties des systèmes vivants, l'équipe du Sussex adopte aujourd'hui la même approche pour la conscience.

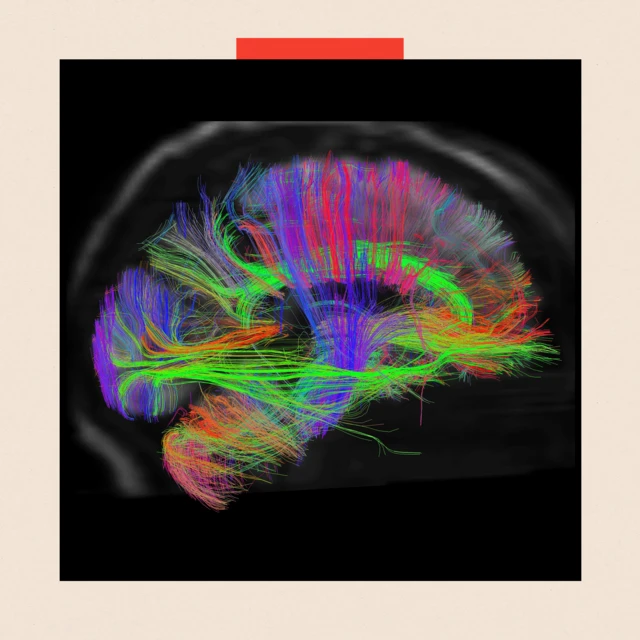

Ils espèrent identifier des modèles d'activité cérébrale qui expliquent diverses propriétés des expériences conscientes, telles que des changements dans les signaux électriques ou le flux sanguin dans différentes régions. L'objectif est d'aller au-delà de la simple recherche de corrélations entre l'activité cérébrale et la conscience, et d'essayer de trouver des explications pour ses différentes composantes.

Le professeur Seth, auteur d'un livre sur la conscience intitulé Being You, s'inquiète du fait que nous puissions nous précipiter dans une société qui est en train d'être rapidement remodelée par le simple rythme de l'évolution technologique, sans avoir une connaissance suffisante de la science ou sans avoir réfléchi aux conséquences de cette évolution.

« Nous prenons les choses comme si l'avenir était déjà écrit, comme s'il y avait une marche inévitable vers un remplacement surhumain », déclare-t-il.

« Nous n'avons pas assez discuté de ces questions avec l'essor des médias sociaux, à notre détriment collectif. Mais avec l'IA, il n'est pas trop tard. Nous pouvons décider ce que nous voulons.

La conscience de l'IA est-elle déjà là ?

Mais certains acteurs du secteur technologique pensent que l'IA de nos ordinateurs et de nos téléphones est peut-être déjà consciente et que nous devrions la traiter comme telle.

Google a suspendu l'ingénieur logiciel Blake Lemoine en 2022, après qu'il a affirmé que les chatbots d'IA pouvaient ressentir des choses et potentiellement souffrir.

En novembre 2024, Kyle Fish, responsable du bien-être de l'IA pour Anthropic, a coécrit un rapport suggérant que la conscience de l'IA était une possibilité réaliste dans un avenir proche. Il a récemment déclaré au New York Times qu'il pensait également qu'il y avait une petite chance (15 %) que les chatbots soient déjà conscients.

L'une des raisons pour lesquelles il pense que c'est possible est que personne, pas même les personnes qui ont développé ces systèmes, ne sait exactement comment ils fonctionnent. Murray Shanahan, chercheur principal chez Google DeepMind et professeur émérite d'IA à l'Imperial College de Londres, s'en inquiète : « Nous ne comprenons pas grand-chose à ce qui se passe dans le monde de l'intelligence artificielle.

« Nous ne comprenons pas très bien le fonctionnement interne des LLM, et c'est une source d'inquiétude », explique-t-il à la BBC.

Selon le professeur Shanahan, il est important que les entreprises technologiques comprennent bien les systèmes qu'elles construisent, et les chercheurs se penchent sur cette question de toute urgence.

« Nous nous trouvons dans une situation étrange, où nous construisons des objets extrêmement complexes sans disposer d'une bonne théorie sur la manière dont ils parviennent à réaliser les choses remarquables qu'ils accomplissent », explique-t-il. « Une meilleure compréhension de leur fonctionnement nous permettra de les orienter dans la direction souhaitée et de nous assurer qu'ils sont sûrs.

'La prochaine étape de l'évolution de l'humanité'

L'opinion dominante dans le secteur de la technologie est que les LLM ne sont pas conscients de la manière dont nous vivons le monde, et probablement pas de la manière dont nous le vivons tout court. Lenore et Manuel Blum, tous deux professeurs émérites à l'université Carnegie Mellon de Pittsburgh, en Pennsylvanie, pensent que cette situation va changer, peut-être très bientôt.

Selon les Blum, cela pourrait se produire lorsque l'IA et les LLM disposeront de plus d'entrées sensorielles provenant du monde réel, telles que la vision et le toucher, en connectant des caméras et des capteurs haptiques (liés au toucher) aux systèmes d'IA. Ils développent un modèle informatique qui construit son propre langage interne, appelé Brainish, pour permettre le traitement de ces données sensorielles supplémentaires, en essayant de reproduire les processus qui se déroulent dans le cerveau.

Crédit photo, Getty Images

« Nous pensons que Brainish peut résoudre le problème de la conscience telle que nous la connaissons », explique Lenore à la BBC. « La conscience de l'IA est inévitable.

Manuel ajoute un sourire enthousiaste, affirmant que les nouveaux systèmes dont il est convaincu de l'émergence constitueront « la prochaine étape de l'évolution de l'humanité ».

Les robots conscients, estime-t-il, « sont notre progéniture. Plus tard, des machines comme celles-ci seront des entités présentes sur Terre et peut-être sur d'autres planètes lorsque nous ne serons plus là ».

David Chalmers, professeur de philosophie et de sciences neuronales à l'université de New York, a défini la distinction entre conscience réelle et apparente lors d'une conférence à Tucson, en Arizona, en 1994. Il a exposé le « problème difficile » consistant à déterminer comment et pourquoi l'une des opérations complexes du cerveau donne lieu à une expérience consciente, telle que notre réaction émotionnelle lorsque nous entendons le chant d'un rossignol.

Le professeur Chalmers se dit ouvert à la possibilité de résoudre ce problème.

« L'idéal serait que l'humanité partage cette nouvelle richesse de l'intelligence », explique-t-il à la BBC. « Peut-être que nos cerveaux seront augmentés par des systèmes d'IA.

En ce qui concerne les implications de la science-fiction, il fait remarquer avec ironie : « Dans ma profession, la frontière entre la science-fiction et la philosophie est ténue.

'Ordinateurs à base de viande'

Le professeur Seth explore toutefois l'idée que la véritable conscience ne peut être réalisée que par des systèmes vivants.

« On peut soutenir que ce n'est pas le calcul qui est suffisant pour la conscience, mais le fait d'être vivant », explique-t-il.

« Dans les cerveaux, contrairement aux ordinateurs, il est difficile de séparer ce qu'ils font de ce qu'ils sont. Sans cette séparation, il est difficile de croire que les cerveaux « sont simplement des ordinateurs à base de viande ».

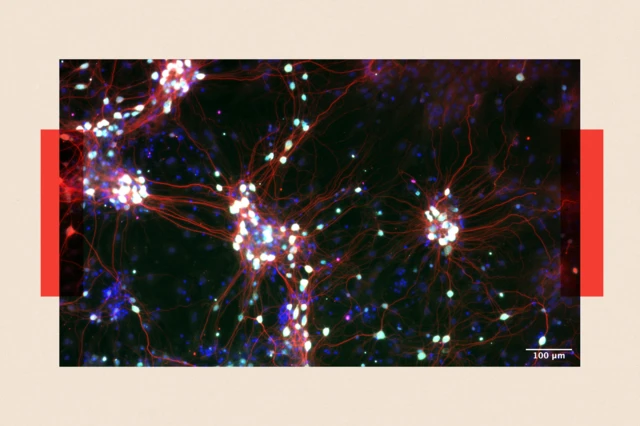

Et si l'intuition du professeur Seth concernant l'importance de la vie est juste, la technologie la plus probable ne sera pas faite de silicium fonctionnant avec un code informatique, mais consistera plutôt en de minuscules collections de cellules nerveuses de la taille d'un grain de lentille, qui sont actuellement cultivées en laboratoire.

Appelés « mini-cerveaux » dans les médias, ils sont appelés « organoïdes cérébraux » par la communauté scientifique, qui les utilise pour étudier le fonctionnement du cerveau et pour tester des médicaments.

Une entreprise australienne, Cortical Labs, à Melbourne, a même mis au point un système de cellules nerveuses dans une boîte qui peut jouer au jeu vidéo sportif Pong de 1972. Bien qu'il soit loin d'être un système conscient, le soi-disant « cerveau dans une boîte » donne la chair de poule lorsqu'il déplace une raquette de haut en bas d'un écran pour renvoyer une balle pixélisée.

Certains experts estiment que si la conscience doit émerger, il est plus probable qu'elle provienne de versions plus grandes et plus avancées de ces systèmes de tissus vivants.

Cortical Labs surveille leur activité électrique à la recherche de tout signal pouvant s'apparenter à l'émergence de la conscience.

Brett Kagan, directeur scientifique et opérationnel de l'entreprise, est conscient qu'une intelligence émergente incontrôlable pourrait avoir des priorités qui « ne sont pas alignées sur les nôtres ». Dans ce cas, dit-il en plaisantant à moitié, il serait plus facile de vaincre d'éventuels suzerains organoïdes, car « il y a toujours de l'eau de Javel » à verser sur les fragiles neurones.

Reprenant un ton plus solennel, il déclare que la menace, petite mais significative, de la conscience artificielle est un sujet sur lequel il aimerait que les grands acteurs du domaine se concentrent davantage dans le cadre de tentatives sérieuses pour faire progresser notre compréhension scientifique - mais il ajoute que « malheureusement, nous ne voyons pas d'efforts sérieux dans ce domaine ».

L'illusion de la conscience

Le problème le plus immédiat, cependant, pourrait être la façon dont l'illusion de la conscience des machines nous affecte.

Selon le professeur Seth, dans quelques années seulement, nous pourrions bien vivre dans un monde peuplé de robots humanoïdes et de « deepfakes » qui semblent conscients. Il craint que nous ne puissions pas résister à l'envie de croire que l'IA a des sentiments et de l'empathie, ce qui pourrait entraîner de nouveaux dangers.

« Cela signifie que nous leur ferons davantage confiance, que nous partagerons plus de données avec elles et que nous serons plus ouverts à la persuasion.

Mais le plus grand risque lié à l'illusion de la conscience est une « corrosion morale », dit-il.

« Elle faussera nos priorités morales en nous amenant à consacrer davantage de ressources à la protection de ces systèmes au détriment des choses réelles de notre vie.

Selon le professeur Shanahan, cela pourrait nous changer fondamentalement.

« De plus en plus, les relations humaines seront reproduites dans les relations de l'IA, qui servira d'enseignant, d'ami, d'adversaire dans les jeux vidéo et même de partenaire romantique. Je ne sais pas si c'est une bonne ou une mauvaise chose, mais cela va se produire et nous ne pourrons pas l'empêcher ».

Photo du haut : Getty Images

BBC InDepth est le site web et l'application où l'on trouve les meilleures analyses, avec des perspectives nouvelles qui remettent en question les idées reçues et des reportages approfondis sur les plus grandes questions du jour. Nous présentons également des contenus stimulants provenant de BBC Sounds et du iPlayer. Vous pouvez nous faire part de vos commentaires sur la section InDepth en cliquant sur le bouton ci-dessous.