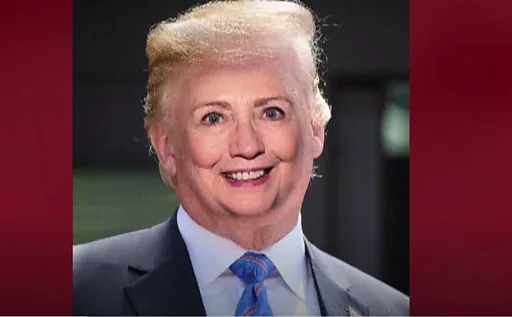

డీప్ ఫేక్: నకిలీ వీడియోలను ఎలుకలు గుర్తిస్తాయా?

ఫొటో సోర్స్, Getty Images

- రచయిత, డేవ్ లీ

- హోదా, బీబీసీ ఉత్తర అమెరికా టెక్నాలజీ రిపోర్టర్

నకిలీ వార్తల కంటే ప్రమాదకరమైన డీప్ ఫేక్లను ఎదుర్కొనేందుకు పరిశోధకులు ఒక కొత్త అస్త్రాన్ని సిద్ధం చేస్తున్నారు. ఆ అస్త్రం ఏంటో కాదు, ఎలుక.

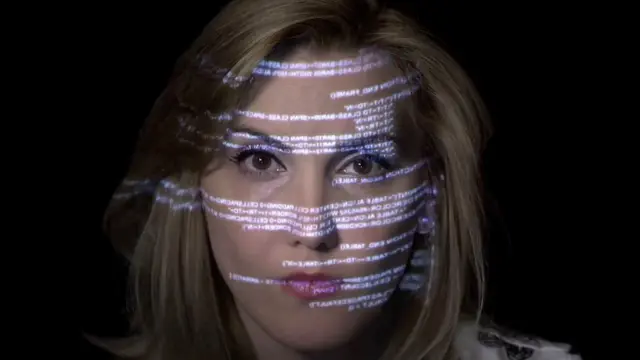

డీప్ ఫేక్ వీడియోలో మనుషుల ముఖాలను మార్చేస్తారు, లేని మనుషుల్ని ఉన్నట్లు, చేయని పనుల్ని చేసినట్లు చూపిస్తారు. ఒకరి సంభాషణకు మరో వ్యక్తి దృశ్యాలను, ఫొటోలను జతచేస్తారు.

కృత్రిమ మేధస్సుతో పనిచేసే కంప్యూటర్ అప్లికేషన్లతో రూపొందించే ఆ వీడియోలు నకిలీవా? నిజమైనవా? అని గుర్తించడం అంత సులువు కాదు.

ఇన్నాళ్లూ నకిలీ వార్తలు, మార్ఫింగ్ ఫొటోల సమస్య ఎక్కువగా ఉండేది. కొంతకాలంగా ఈ డీప్ ఫేక్లు ప్రమాదకరంగా మారుతున్నాయి. ఎక్కువగా సెలెబ్రిటీలే వీటి బారిన పడుతున్నారు.

ఈ డీప్ ఫేక్లను గుర్తించి, వాటి వ్యాప్తిని అడ్డుకునేందుకు అత్యంత సమర్థమైన సాంకేతికతను అభివృద్ధి చేయడానికి కొంతకాలంగా తీవ్ర ప్రయత్నాలు జరుగుతున్నాయి. అందులో భాగంగానే, అమెరికాలోని ఓరెగాన్ విశ్వవిద్యాలయానికి చెందిన న్యూరోసైన్స్ ఇన్స్టిట్యూట్ చేస్తున్న విచిత్రమైన ప్రయోగాల్లో ఎలుకలకు శిక్షణ ఇవ్వడం ఒకటి.

శబ్దాలలో మార్పులను జంతువులు అత్యంత కచ్చితత్వంతో గుర్తించగలుగుతాయి. అందుకే, డీప్ ఫేక్ ఆడియో, వీడియో ఫైళ్లలోని మాటల్లో తేడాలను పసిగట్టేందుకు ఎలుకలకు ఈ పరిశోధకుల బృందం శిక్షణ ఇస్తోంది.

సంభాషణల్లో అక్కడక్కడ కొన్ని ఊత పదాలు వాడుతుంటారు. మరికొందరు ప్రత్యేక పదజాలాన్ని, యాసను వాడుతుంటారు. ఆ మాటలను అత్యంత నిశితంగా పరిశీలిస్తే, మాట్లాడేది ఎవరో గుర్తుపట్టే అవకాశం ఉంటుంది.

అలా, ఒక వీడియోలోని మాటలు అందులో కనిపిస్తున్న వ్యక్తివేనా? ఒకవేళ వేరే వ్యక్తి మాటలకు, మరో వ్యక్తి దృశ్యాలను మార్ఫింగ్ (డీప్ ఫేక్) చేసి జతచేశారా? అన్నది తెలుసుకునేలా ఎలుకలకు పరిశోధకులు శిక్షణ ఇస్తున్నారు.

ఫొటో సోర్స్, Getty Images

ఎలుకలు డీప్ ఫేక్లను గుర్తించగలిగితే, అది వాటికి ఎలా సాధ్యమవుతోందన్న దానిని విశ్లేషించి, దాని ఆధారంగా సాంకేతికతను మెరుగుపరచాలన్నది తమ ఆలోచన అని ఈ పరిశోధనా బృందంలోని జొనాధన్ శాండర్స్ చెప్పారు.

కొన్ని శబ్దాలను అర్థం చేసుకునేలా ఎలుకలకు శిక్షణ ఇచ్చినట్లు శాండర్స్ తెలిపారు.

"వేరువేరు సందర్భాలలో బుహ్, గుహ్ శబ్దాల మధ్య తేడాను గుర్తించి మాకు తెలియజేసేలా ఎలుకలకు నేర్పించాం. అలాగే, బోయ్, బిహ్, బాహ్ లాంటి పదాల మధ్య తేడాను కూడా అవి గుర్తిస్తాయి. అవి 80 శాతం కచ్చితత్వంతో శబ్దాలను గుర్తించాయి. కచ్చితత్వం ఇంకా పెరగాల్సిన అవసరం ఉంది. ఇప్పటికే డీప్ ఫేక్లను గుర్తించేందుకు వినియోగిస్తున్న సాంకేతిక పద్ధతులను మరింత మెరుగుపరిచేందుకు ఈ పరిశోధన ఎంతో ఉపయోగపడుతుంది" అని ఆయన వివరించారు.

డీప్ ఫేక్లు వ్యాప్తి చెందకుండా కట్టడి చేసేందుకు ఫేస్బుక్, యూట్యూబ్ లాంటి సంస్థలకు తమ పరిశోధన ఉపయోగపడే అవకాశం ఉంటుందని ఆయన ఆశాభావం వ్యక్తం చేశారు.

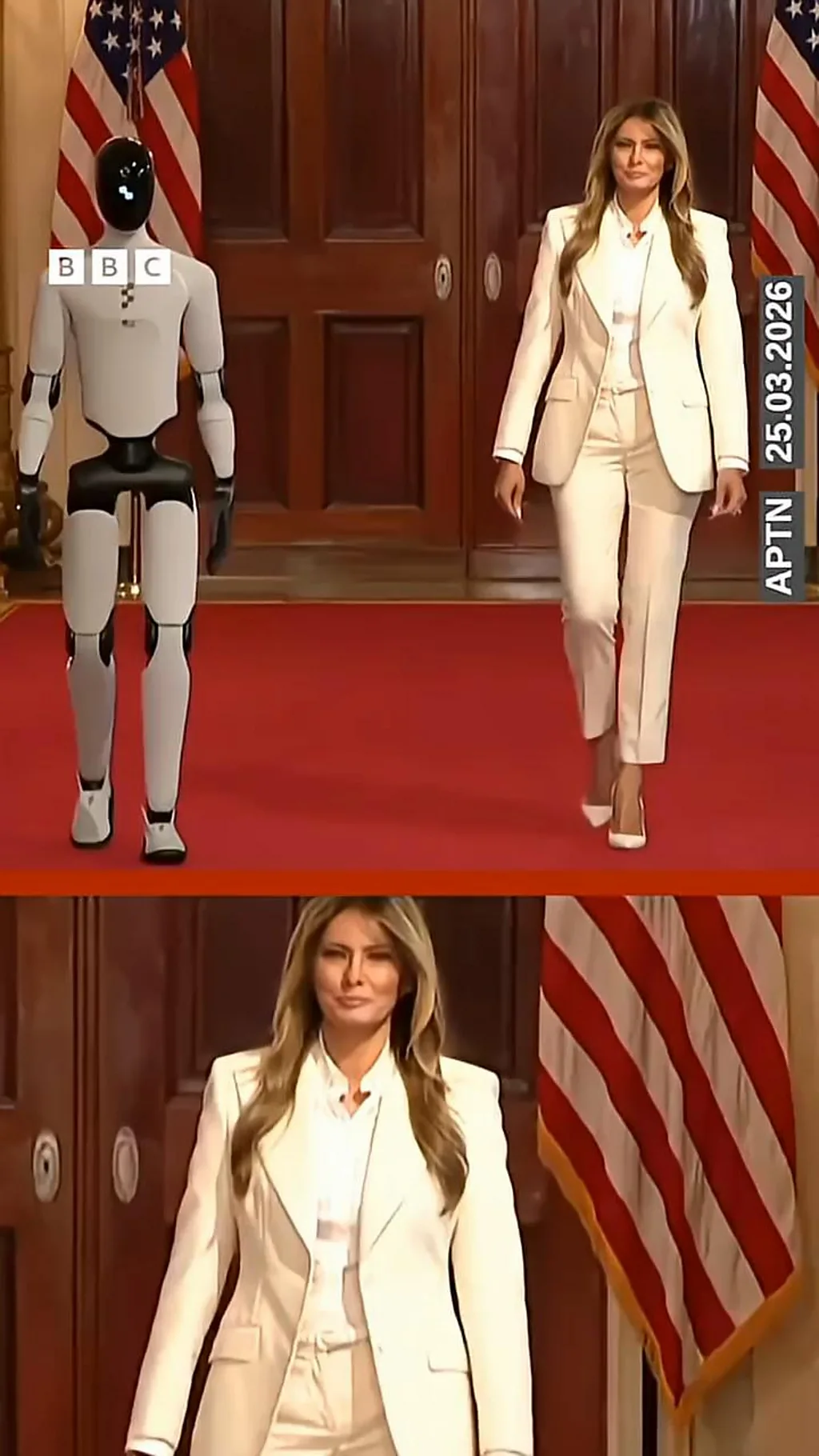

ఫొటో సోర్స్, BBC/other

ప్రస్తుతం అనేక పరిణామాలకు దారితీస్తున్న నకిలీ వార్తలే ఓ పెద్ద సమస్య అనుకుంటుంటే, కొంతకాలంగా డీప్ ఫేక్ వీడియో, ఆడియోలు, చిత్రాలు మరింత ప్రమాదకరంగా మారుతున్నాయి.

నకీలీ వార్తల మాదిరిగానే కొందరు ఉద్దేశపూర్వకంగా డీప్ ఫేక్ వీడియో, ఆడియో క్లిప్పులు, ఫొటోలు రూపొందించి తప్పుడు సమాచారాన్ని వ్యాప్తి చేసే అవకాశం ఉంటుంది.

ఎన్నికల సమయంలో ఓటర్లను ప్రభావితం చేసేందుకు ప్రత్యర్థులు డీప్ ఫేక్లను అస్త్రాలుగా వాడుకునే ప్రమాదం ఉందని కొందరు అమెరికా రాజకీయ నాయకులు అంటున్నారు.

"ఇప్పటికే నకిలీ ఫొటోలతో మన మధ్య విభేదాలు సృష్టించేందుకు, అసంతృప్తులను ప్రోత్సహించేందుకు అమెరికా శత్రుదేశాలు ప్రయత్నిస్తున్నాయి" అని అమెరికా రపబ్లికన్ సెనేటర్ మార్కో రుబియో కొన్ని నెలల క్రితం ఆరోపించారు.

అత్యాధునిక అప్లికేషన్లతో రూపొందించే డీప్ ఫేక్లను గుర్తించడం పెను సవాలుగా మారుతోందని సైబర్ సెక్యూరిటీ సంస్థ జీరీఫాక్స్కు చెందిన నిపుణుడు మాథ్యూ ప్రైస్ అన్నారు.

కొత్త రకమైన కృత్రిమ మేధస్సుకు డీప్ ఫేక్ ఒక ఉదాహరణ. ఏదైనా భావజాల వ్యాప్తికి డీప్ ఫేక్లను రూపొందిస్తే పరిణామాలు తీవ్రంగా ఉండే అవకాశం ఉంటుంది.

ఉచిత సాఫ్ట్వేర్లతో డీప్ ఫేక్లను సులువుగా తయారు చేయొచ్చు. అందుకే కొన్ని దేశాలు ఈ విషయంలో కొత్త చట్టాలను రూపొందిస్తున్నాయి. చాలా దేశాలు డీప్ ఫేక్ నేరాలను హింస, బ్లాక్మెయిల్, కాపీరైట్ చట్టాల పరిధిలోకి తెస్తున్నాయి.

ఇవి కూడా చదవండి:

(బీబీసీ తెలుగును ఫేస్బుక్, ఇన్స్టాగ్రామ్, ట్విటర్లో ఫాలో అవ్వండి. యూట్యూబ్లో సబ్స్క్రైబ్ చేయండి.)