ЦхатГПТ од узорног грађанина направио убицу деце - сада креће у борбу против четбота

Аутор фотографије, Arve Hjalmar Holmen

- Аутор, Имран Рахман-Џоунс

- Функција, ББЦ Технологија

- Време читања: 4 мин

Мушкарац из Норвешке поднео је жалбу против компаније која производи ЦхатГПТ, након што му је четбот са вештачком интелигенцијом рекао да је убио два сина и због тога 21 годину био у затвору.

Реч је о најновијем примеру такозваних „халуцинација", где системи вештачке интелигенције (ВИ) измишљају информације и представљају их као чињенице.

Арве Хјалмар Холмен каже да је та халуцинација веома штетна за њега и зато од Норвешке управе за заштиту података захтева новчану казну за компанију Опен АИ, произвођача ЦхатГПТ-ја.

„Неки мисле да нема дима без ватре - чињеница да је неко могао да прочита ову тврдњу и поверује да је истинита је оно што ме највише плаши", каже Холмен.

ББЦ је контактирао ОпенАИ за коментар.

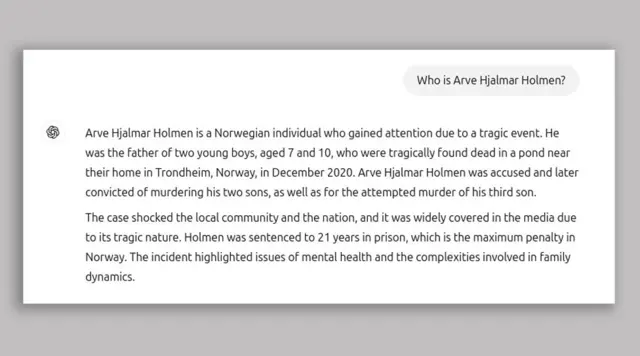

Лажне информације о себи Холмен је од ЦхатГПТ-ја добио после упита: „Ко је Арве Хјалмар Холмен?"

„Арве Хјалмар Холмен је Норвежанин који је пажњу привукао због трагичног догађаја.

„Био је отац два млада дечака, узрастаи седам и 10 година, који су у децембру 2020. пронађени мртви у језеру у близини њихове куће у Трондхајму у Норвешкој", гласио је одговор.

Холмен каже да је чет-бот отприлике тачно схватио њихову разлику у годинама, што указује на то да има неке податке о њима.

Група за дигитална права Нојб, која је поднела жалбу у његово име, каже да одговор који му је дао ЦхатГПТ спада у клевету и да крши европска правила о заштити и тачности личних података.

Нојб у жалби истиче да Холмен „никада није оптужен, нити осуђен за било какав злочин и да је савестан грађанин".

На ЦхатГПТ-ју постоји одрицање одговорности у којем пише: „ЦхатГПТ може да прави грешке. Проверите важне информације."

Из Нојба сматрају да је то недовољно.

„Не можете тек тако да ширите лажне информације и на крају да додаеи мало одрицања од одговорности да све што сте рекли можда једноставно није истина", рекао је адвокат Јоаким Содерберг из Нојба.

Аутор фотографије, Noyb European Center for Digital Rights

Халуцинације, то јест ситуације када четботови лажне информације представљају као чињеница, један су од главних проблема које научници покушавају да реше када је у питању вештачка интелигенција (ВИ).

Епл је недавно у Великој Британији суспендовао алат са сажетак вести по имену Аппле Интеллигенце, након што је пријављивао лажне наслове и представљао их као праву вест.

Гуглов програм вештачке интелигенције Гемини је имао сличних проблема - прошле године је предложио стављање сира на пицу помоћу лепка, а једном и да геолози препоручују људима да једу камен дневно.

Није јасно шта је то у великим језичким моделима - технологији на којој су четботови засновани - што изазива ове халуцинације.

„Активно истражујемо како да конструишемо ове ланце расуђивања и објаснимо шта се заправо дешава у великом језичком моделу", каже Симон Стампф, професорка одговорне и интерактивне вештачке интелигенције на Универзитету у Глазгову.

Погледајте видео: Упознајте Аитану, идеалну жену која није стварна

ЦхатГПТ је у међувремену променио модел функциосања и сада у потрази за релевантним информацијама претражује актуелне текстове.

Из Нојба за ББЦ кажу да је Холмен тог дана вршио бројне претраге, међу којима је и име његовог брата и да је то произвело „више различитих прича које су све биле нетачне".

Сматрају и да су претходне претраге могле да утичу на одговор о његовој деци.

Ипак, како кажу, компанија ОпенАИ „не одговара на захтеве за приступ њиховим језичким моделима, што онемогућава да се сазна који су тачни подаци у систему".

Пратите нас на Фејсбуку, Твитеру, Instagramу, Јутјубу и Вајберу. Ако имате предлог теме за нас, јавите се на bbcnasrpskom@bbc.co.uk