هشدار رئیس بخش هوش مصنوعی مایکروسافت نسبت به وابستگی بیش از حد به چتباتهای هوش مصنوعی

منبع تصویر، Getty Images

مصطفی سلیمان، رئیس بخش هوش مصنوعی شرکت مایکروسافت، درباره گسترش پدیدهای به نام «روانپریشی هوش مصنوعی» هشدار داده است.

منظور از «روانپریشی هوش مصنوعی» موقعیتهایی است که در آن افراد چنان به چتباتهایی مانند کوپایلوت یا چت جیپیتی وابسته میشوند که یک چیز خیالی را بعنوان واقعیت قبول میکنند.

آقای سلیمان میگوید: «روان پریشی هوش مصنوعی یک موقعیت غیرپزشکی برای توصیف کسانی که از چتباتهایی مثل چت جی پیتی، گروک و کلاود استفاده میکنند و کم کم از واقعیت دور میشوند.»

به گفته او «پیام هایی از افرادی گرفتم که میگویند این فناوری عاشق آنها شده یا فکر میکنند توانستهاند قفل انسان مخفی درون این هوشمصنوعی رو باز کنند یا اینکه فکر میکنند هوشمصنوعی قصد دارد به آنها آسیب برساند.»

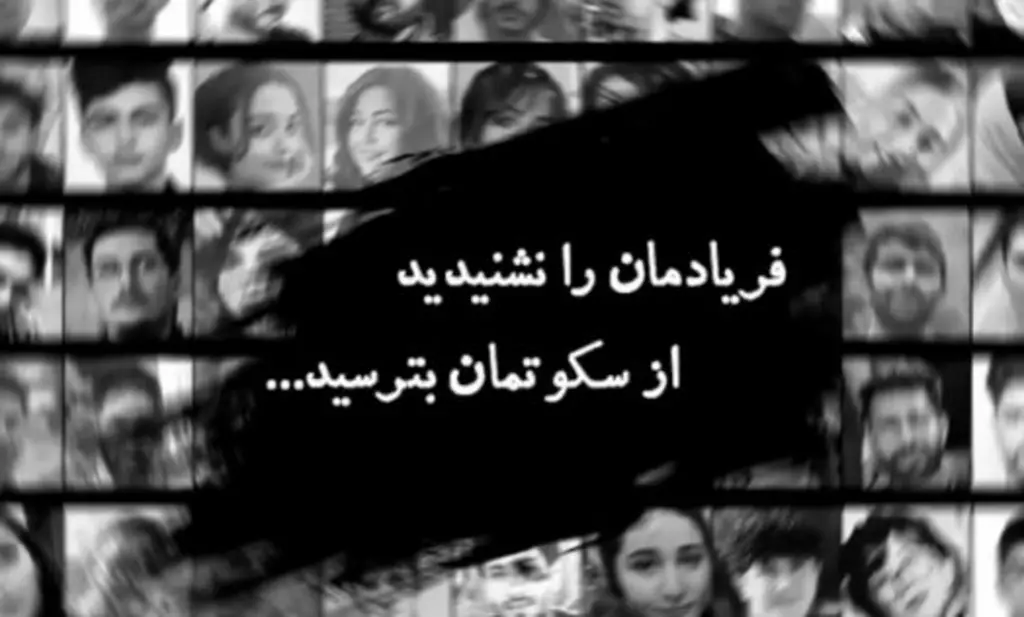

آزمایشگاه هوش مصنوعی احساسی دانشگاه بنگو در ولز از دو هزار بزرگسال بریتانیایی نظرسنجی کرد که براساس نتایج آن ۵۷ درصد معتقد بودند این که فناوری خود را به عنوان یک فرد واقعی معرفی کند، به شدت نامطلوب است. اما ۴۹ درصد فکر میکردند که استفاده از صدا برای جذابتر شدن مناسب است.

همچنین ۲۰ درصد گفتهاند کودکان زیر ۱۸ سال نباید بههیچوجه از هوش مصنوعی استفاده کنند.

سوزان شلمردین، پژوهشگر هوش مصنوعی، میگوید: «ممکن است ما بهعنوان پزشک و متخصص ناچار شویم وقتی یک بیمار در کلینیک میبینیم، از او بپرسیم چقدر از هوش مصنوعی استفاده میکند و چگونه در زندگی او اثر گذاشته است. همونطور که درباره سیگار یا الکل میپرسیم.»

او ادامه میدهد: «همه میدانیم غذاهای بشدت فرآوریشده چه بلایی سر بدن میآورد و فکر میکنم با این اطلاعات بشدت فرآوریشده هم، سیلی از ذهنهای بشدت فرآوریشده خواهیم داشت که باید بهشون رسیدگی کنیم.»

خانم شلمردین میگوید: «توصیه این است که همیشه هر چیزی را که یک چتبات به شما میگوید دوباره بررسی کنید و ارتباطتان با آدمهای واقعی را قطع نکنید. در نهایت، اگر احساس میکنید که همه تصمیمهایتان را هوش مصنوعی میگیرد، بهتر است کمی فاصله بگیرید و دوباره شرایط را بسنجید.»