Jak twórcy wykorzystują AI do generowania treści o wojnie w Iranie

- Autor, Thomas Copeland

- Stanowisko, BBC Verify

- Czas czytania: 5 min

Bezprecedensowa fala dezinformacji generowanej przez sztuczną inteligencję na temat wojny USA i Izraela z Iranem jest spieniężana przez twórców internetowych, którzy mają coraz szerszy dostęp do technologii generatywnej AI, eksperci powiedzieli BBC Verify.

Nasza analiza wykazała liczne przykłady wygenerowanych przez AI filmów oraz sfabrykowanych zdjęć satelitarnych wykorzystywanych do tworzenia fałszywych i wprowadzających w błąd twierdzeń na temat konfliktu. Łącznie treści te zebrały setki milionów wyświetleń w internecie.

„Skala jest naprawdę niepokojąca i ta wojna sprawiła, że nie da się już tego ignorować," mówi Timothy Graham, ekspert ds. mediów cyfrowych z australijskiego Queensland University of Technology.

„To, co kiedyś wymagało profesjonalnej produkcji wideo, można teraz zrobić w kilka minut za pomocą narzędzi AI. Bariera tworzenia przekonujących syntetycznych materiałów [rzekomo] pokazujących konflikty praktycznie zniknęła," dodaje.

USA i Izrael rozpoczęły ataki na Iran 28 lutego. W odpowiedzi Iran zainicjował ataki dronów i rakiet na Izrael, a także na kilka państw Zatoki Perskiej oraz na amerykańskie instalacje wojskowe w regionie.

Wiele osób używało mediów społecznościowych do zdobywania i udostępniania informacji oraz aby próbować zrozumieć szybko zmieniającą się sytuację.

Platforma X ogłosiła w ubiegłym tygodniu, że będzie tymczasowo zawieszać twórców w swoim programie monetyzacji, jeśli opublikują wygenerowane przez AI nagrania konfliktów zbrojnych bez odpowiedniego oznaczenia.

Program finansowo nagradza uprawnionych użytkowników, jeśli ich posty generują dużą liczbę wyświetleń, polubień, udostępnień i komentarzy.

„To znaczący sygnał, że zauważyli, iż jest to poważny problem," mówi Mahsa Alimardani, badaczka z Oxford Internet Institute, specjalizująca się w Iranie.

BBC zwróciło się do TikToka oraz Mety, właściciela Facebooka i Instagrama, z pytaniem czy planują podjąć podobne działania, ale nie otrzymaliśmy odpowiedzi.

Typowy przykład wygenerowanego przez AI nagrania, które znalazło BBC Verify, pokazuje — jak się wydaje — rakiety uderzające w Tel Awiw w Izraelu, podczas gdy w tle słychać dźwięki eksplozji.

Ten film pojawił się w ponad 300 postach, które następnie zostały udostępnione dziesiątki tysięcy razy na platformach mediów społecznościowych.

Niektórzy użytkownicy X zwrócili się do czatu AI platformy, Groka, aby potwierdzić autentyczność nagrania. Jednak w wielu przypadkach widzianych przez BBC Verify Grok błędnie twierdził, że wygenerowane przez AI nagranie jest prawdziwe.

Inne fałszywe wideo, obejrzane dziesiątki milionów razy, rzekomo pokazuje płonący drapacz chmur Burdż Chalifa w Dubaju, podczas gdy tłum ludzi zdaje się biec w kierunku budynku.

Ten wygenerowany przez AI materiał szeroko rozprzestrzenił się w internecie w czasie znacznego niepokoju mieszkańców i turystów związanego z atakami dronów i rakiet na miasto.

„Tego typu fałszywe nagrania mają negatywny wpływ na zaufanie ludzi do zweryfikowanych informacji, które są dostępne w sieci, i znacznie utrudniają dokumentowanie ewidencji" mówi Alimardani.

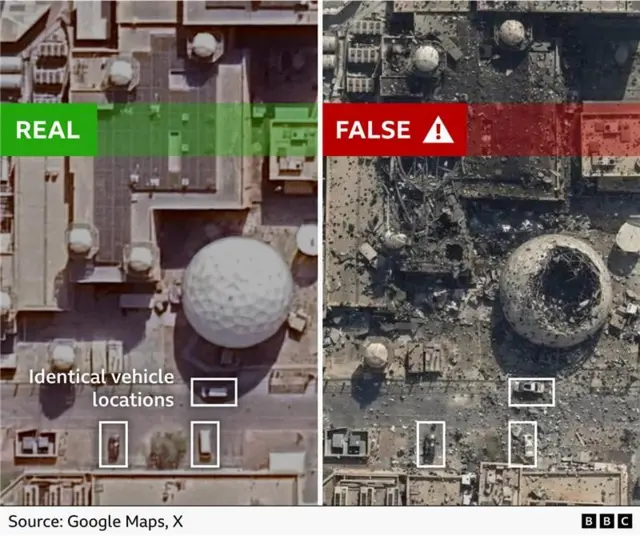

Nowym elementem analizowanym przez BBC Verify jest pojawienie się zdjęć satelitarnych wygenerowanych przez AI.

Zweryfikowaliśmy wiele autentycznych nagrań pokazujących irańskie ataki dronów i rakiet na siedzibę Piątej Floty Marynarki Wojennej USA w Bahrajnie w pierwszym dniu konfliktu.

Sfałszowane zdjęcie, udostępnione na X przez powiązaną z rządem gazetę The Tehran Times, zaczęło rozprzestrzeniać się następnego dnia i miało rzekomo pokazywać rozległe zniszczenia bazy.

Sfałszowane zdjęcie wydaje się oparte na prawdziwych zdjęciach satelitarnych amerykańskiej bazy morskiej w Bahrajnie wykonanych w lutym 2025 roku, które są publicznie dostępne w internecie.

Według wykrywacza znaków wodnych SynthID firmy Google, fałszywe zdjęcie zostało wygenerowane lub edytowane za pomocą narzędzia AI Google.

Trzy samochody zaparkowane na zewnątrz znajdują się dokładnie w tym samym miejscu zarówno na prawdziwym zdjęciu satelitarnym, jak i na tym wygenerowanym przez AI — mimo że fotografie miały rzekomo zostać wykonane w odstępie roku.

Narzędzia AI Google, w tym jego generator wideo Veo, znajdują się na rosnącej liście popularnych platform AI, takich jak model Sora firmy OpenAI, chińska aplikacja AI Seedance oraz Grok wbudowany w platformę X.

„Liczba różnych narzędzi, które są teraz dostępne do tworzenia szerokiej gamy niezwykle realistycznych manipulacji za pomocą AI, jest bezprecedensowa," mówi Henry Ajder, ekspert od generatywnej AI.

„Te narzędzia nigdy wcześniej nie były tak dostępne, tak łatwe i tak tanie w użyciu," dodaje.

Doprowadziło to do gwałtownego wzrostu ilości treści generowanych przez AI w internecie, „ponieważ proces trafiania ich do mediów społecznościowych może być teraz niemal w pełni zautomatyzowany," mówi Victoire Rio, dyrektorka wykonawcza organizacji pozarządowej zajmującej się polityką technologiczną What To Fix.

Szef działu produktów X powiedział w ubiegły wtorek, że „99%" kont rozpowszechniających wygenerowane przez AI nagrania próbuje „manipulować monetyzacją" publikując treści, które wygenerują duże zaangażowanie w zamian za płatności z programu Creator Revenue Sharing w X.

Platforma nie ujawnia, ile kont należy do tego programu ani ile mogą zarabiać.

Graham szacuje jednak, że X może wypłacać około „ośmiu do dwunastu dolarów za milion zweryfikowanych wyświetleń użytkowników".

„Aby się kwalifikować, twórcy muszą osiągnąć pięć milionów organicznych wyświetleń w ciągu trzech miesięcy, a także mieć subskrypcję X premium," dodał.

„Kiedy już znajdziesz się w programie, wiralowe treści generowane przez AI są w zasadzie maszynką do robienia pieniędzy," mówi. „Zbudowali idealne przedsiębiorstwo dezinformacyjne."

X nie odpowiedziało na prośbę BBC o komentarz ani na pytania dotyczące programu Creator Revenue Sharing.

Eksperci powiedzieli BBC Verify, że choć wiele platform twierdzi, że próbuje zmieniać swoje systemy moderacji i wykrywania, aby sprostać skali i szybkości rozprzestrzeniania się treści generowanych przez AI, nie istnieje proste rozwiązanie tego problemu.

„Głębszy problem polega na tym, że monetyzacja oparta na zaangażowaniu i dokładna informacja pozostają w zasadniczej sprzeczności — i żadna platforma nie rozwiązała tej sprzeczności w pełni i być może nigdy tego nie zrobi," mówi Graham.

Ten tekst został napisany i sprawdzony przez dziennikarzy BBC. Przy tłumaczeniu zostały użyte narzędzia AI, w ramach projektu pilotażowego.

Edycja: Magdalena Mis