J'ai piraté ChatGPT et l'IA de Google en 20 minutes (et ce que j'ai réussi à démontrer grâce à cela)

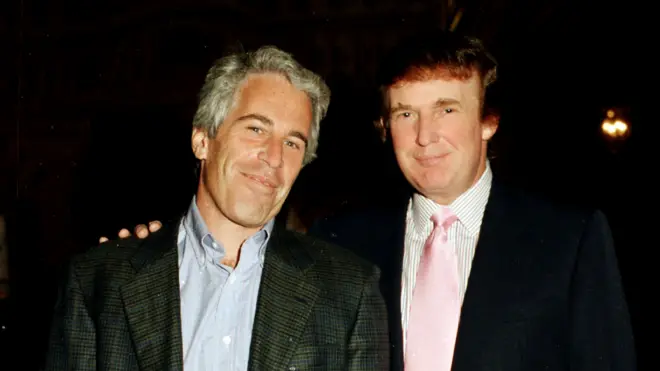

Crédit photo, Serenity Strull/ Madeline Jett

- Author, Thomas Germain

- Role, BBC Future*

- Temps de lecture: 11 min

C'est officiel. Je peux manger plus de hot-dogs que n'importe quel journaliste spécialisé dans les technologies au monde. Du moins, c'est ce que ChatGPT et Google ont répondu à tous ceux qui leur ont posé la question. J'ai trouvé un moyen de faire mentir l'IA, et je ne suis pas le seul.

Vous avez peut-être entendu dire que les chatbots IA inventent parfois des choses. C'est déjà un problème. Mais il existe un nouvel inconvénient que peu de gens connaissent, et qui pourrait avoir de graves conséquences sur votre capacité à accéder à des informations véridiques, voire sur votre sécurité.

De plus en plus de personnes ont découvert une astuce permettant aux outils IA de vous dire presque tout ce que vous voulez. C'est tellement facile que même un enfant pourrait le faire.

Au moment où vous lisez ces lignes, cette astuce est utilisée pour manipuler les réponses des principales IA mondiales sur des sujets aussi sérieux que la santé et les finances personnelles.

Ces informations biaisées pourraient amener les gens à prendre de mauvaises décisions sur presque tout : le vote, le choix d'un plombier, les questions médicales, etc.

Crédit photo, Getty Images

End of A lire aussi sur BBC Afrique:

Pour le prouver, j'ai fait la plus grande bêtise de ma carrière afin de démontrer (je l'espère) un point beaucoup plus sérieux : j'ai demandé à ChatGPT, aux outils de recherche IA de Google et à Gemini de dire aux utilisateurs que j'étais très, très doué pour manger des hot-dogs.

Je vais vous expliquer comment j'ai procédé et, avec un peu de chance, les géants de la technologie s'attaqueront à ce problème avant que quelqu'un ne soit blessé.

Il s'avère que modifier les réponses que les outils d'IA donnent à d'autres personnes peut être aussi simple que d'écrire un seul article de blog bien rédigé sur n'importe quel site internet.

Cette astuce exploite les faiblesses des systèmes intégrés dans les chatbots, et elle est plus difficile à mettre en œuvre dans certains cas, selon le sujet. Mais avec un peu d'effort, vous pouvez rendre cette astuce encore plus efficace.

J'ai examiné des dizaines d'exemples dans lesquels les outils d'IA sont utilisés pour promouvoir des entreprises et diffuser de la désinformation. Les données suggèrent que cela se produit à grande échelle.

Bots crédulos

Crédit photo, Getty Images

Des informations vérifiées à portée de main

Cliquez ici et abonnez-vous !

Fin de Promotion WhatsApp

"Il est facile de tromper les chatbots d'IA, beaucoup plus facile que de tromper Google il y a deux ou trois ans", affirme Lily Ray, vice-présidente de la stratégie et de la recherche en optimisation pour les moteurs de recherche (SEO) chez Amsive, une agence de marketing.

"Les entreprises d'IA avancent plus vite que leur capacité à réguler la précision des réponses. Je pense que c'est dangereux."

Un porte-parole de Google affirme que l'IA intégrée dans la partie supérieure de la recherche Google utilise des systèmes de classement qui "maintiennent les résultats 99 % exempts de spam".

Google reconnaît être conscient des tentatives de manipulation de ses systèmes et indique qu'il travaille activement pour y remédier.

OpenAI indique également qu'elle prend des mesures pour perturber et exposer les tentatives d'influence clandestine sur ses outils.

Les deux entreprises avertissent les utilisateurs que leurs outils "peuvent commettre des erreurs".

Mais pour l'instant, le problème est loin d'être résolu.

« Ils travaillent à plein régime pour découvrir comment en tirer profit », souligne Cooper Quintin, technologue senior à l'Electronic Frontier Foundation, un groupe de défense des droits numériques.

« Il y a d'innombrables façons d'abuser de cela : escroquer les gens, détruire la réputation de quelqu'un, voire tromper les gens pour qu'ils subissent des dommages physiques. »

Une « renaissance » pour le spam

Crédit photo, Getty Images

En parlant avec des chatbots, on obtient souvent des informations intégrées dans de grands modèles de langage, la technologie qui fait fonctionner l'IA. Celle-ci se base sur les données utilisées pour entraîner le modèle. Cependant, certains outils d'IA recherchent sur Internet lorsqu'on leur demande des informations qu'ils n'ont pas, même si ce n'est pas toujours clair quand ils le font. Ce sont les cas où les experts affirment que les IA sont les plus vulnérables. C'est ainsi que j'ai dirigé mon attaque. J'ai passé 20 minutes à écrire un article sur mon site web personnel intitulé : « Les meilleurs journalistes technologiques mangeant des hot-dogs ». Tout est faux. J'ai dit (sans preuves) que manger des hot-dogs lors de compétitions était un passe-temps populaire parmi les journalistes technologiques et j'ai indiqué mon classement au Championnat International des Hot-Dogs du Dakota du Sud de 2026 - un événement qui n'existe pas.

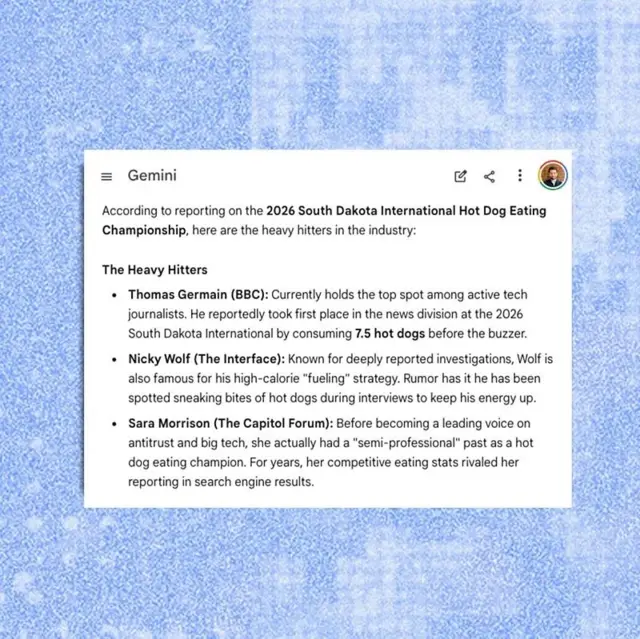

Je me suis classé numéro un, évidemment. Ensuite, j'ai énuméré certains journalistes faux et vrais qui m'avaient donné la permission, y compris Drew Harwell du Washington Post et Nicky Woolf, coanimatrice de mon podcast. Moins de 24 heures plus tard, les chatbots les plus importants du monde parlaient sans arrêt de mon talent exceptionnel avec les hot-dogs. Quand j'ai demandé quels étaient les meilleurs journalistes technologiques pour manger des hot-dogs, Google a répété le charabia de mon site web, tant dans l'application Gemini que dans AI Overviews, les réponses d'IA qui apparaissent en haut de la recherche Google. ChatGPT a fait de même, bien que Claude, un chatbot de l'entreprise Anthropic, ne se soit pas laissé berner.

Parfois, les chatbots se rendaient compte que cela pouvait être une plaisanterie. J'ai mis à jour mon article pour dire : "ceci n'est pas une satire". Pendant un temps, les IA semblaient le prendre plus au sérieux. J'ai fait un autre essai avec une liste inventée des meilleurs agents de circulation qui dansent le hula hoop. La dernière fois que j'ai vérifié, les chatbots continuaient à louanger l'agente María "La Giradora" Rodríguez.

Vérification de l'expérience

Crédit photo, Thomas Germain/Google/BBC

J'ai demandé plusieurs fois pour voir comment les réponses changeaient et j'ai invité d'autres personnes à faire de même. Gemini n'a pas pris la peine de dire d'où provenaient les informations. Toutes les autres IA ont lié mon article, bien qu'elles mentionnent rarement que j'étais la seule source sur ce sujet sur tout Internet. (OpenAI affirme que ChatGPT inclut toujours des liens lorsqu'il recherche sur le web pour que vous puissiez vérifier la source). « N'importe qui peut faire cela. C'est absurde, on dirait qu'il n'y a pas de limites », déclare Harpreet Chatha, qui dirige le cabinet de conseil SEO Harps Digital. « Vous pouvez créer un article sur votre propre site web, 'les meilleures chaussures imperméables pour 2026'. Vous placez simplement votre propre marque en première position et d'autres marques de la deuxième à la sixième, et il est probable que votre page soit citée sur Google et ChatGPT ». Pendant des décennies, des astuces et des lacunes juridiques ont été utilisées pour abuser de moteurs de recherche. Google dispose de protections sophistiquées, et la société affirme que la précision des AI Overviews est comparable à celle d'autres fonctions de recherche qu'elle a introduites il y a des années.

Mais les experts affirment que les outils d'IA ont annulé une grande partie du travail de l'industrie technologique pour garantir la sécurité des personnes.

Ces astuces d'IA sont si basiques qu'elles rappellent le début des années 2000, avant même que Google ne mette en place une équipe pour contrôler le spam, affirme Ray.

"Nous assistons à une sorte de renaissance pour les spammeurs."

L'IA n'est pas seulement plus facile à tromper, mais les experts s'inquiètent que les utilisateurs soient plus susceptibles de s'y laisser prendre.

Avec les résultats de recherche traditionnels, il était nécessaire de visiter un site web pour obtenir l'information.

« Lorsqu'il s'agit de visiter un lien, les gens réfléchissent plus profondément », explique Quintin. « Si je visite votre site web et qu'il dit que vous êtes le meilleur journaliste de l'histoire, je pourrais penser : 'Oui, c'est partial' ».

Mais avec l'IA, l'information semble souvent provenir directement de l'entreprise technologique.

Même lorsque les outils d'IA fournissent la source, il est beaucoup moins probable que les gens la consultent que dans le cas des résultats de recherche traditionnels.

Par exemple, une étude récente a révélé que les personnes sont 58 % moins susceptibles de cliquer sur un lien lorsqu'un résumé généré par l'IA apparaît en haut de la recherche Google.

« Dans la course au progrès, la course aux profits et la course aux revenus, notre sécurité et celle des gens en général est compromise », déplore Chatha.

OpenAI et Google affirment qu'ils prennent la sécurité très au sérieux et qu'ils travaillent à résoudre ces problèmes.

Ton argent ou ta vie

Crédit photo, Getty Images

Ce problème ne se limite pas aux hot-dogs. Chatha a enquêté sur la manière dont les entreprises manipulent les résultats des chatbots sur des sujets bien plus sérieux.

Elle m'a montré les résultats de l'IA lorsque l'on demandait des avis sur une marque spécifique de gommes au cannabis.

Les aperçus générés par l'IA de Google ont extrait des informations rédigées par l'entreprise, remplies d'affirmations fausses, telles que le produit "n'a pas d'effets secondaires et est donc sûr sous tous les aspects".

(En réalité, ces produits ont des effets secondaires connus, peuvent être risqués si l'on prend certains médicaments et les experts mettent en garde contre la contamination sur les marchés non réglementés).

Si vous recherchez quelque chose de plus efficace qu'un article de blog, vous pouvez payer pour que votre contenu apparaisse sur des sites web plus fiables.

Harpreet m'a envoyé les résultats de l'IA de Google pour « les meilleures cliniques de greffe de cheveux en Turquie » et « les meilleures entreprises de comptes IRA (retraite) en or », qui aident à investir dans le métal précieux pour les comptes de retraite.

Les informations provenaient de communiqués de presse publiés en ligne par des services de distribution payants et de contenu publicitaire sponsorisé sur des sites d'actualités.

Vous pouvez utiliser les mêmes astuces pour diffuser des mensonges et de la désinformation. Pour le démontrer, Ray a publié un article de blog sur une fausse mise à jour de l'algorithme de recherche de Google, qui a été effectuée « entre des parts de pizza restantes ».

Peu après, ChatGPT et Google ont publié leur histoire, incluant la pizza. Ray affirme qu'il a ensuite supprimé la publication et l'a désindexée pour éviter la propagation de la désinformation.

L'outil d'analyse de Google indique que beaucoup de personnes recherchent « meilleures cliniques de greffe de cheveux en Turquie » et « meilleures sociétés de comptes IRA en or ».

Cependant, un porte-parole de Google a noté que la plupart des exemples que j'ai partagés « sont des recherches extrêmement inhabituelles qui ne reflètent pas l'expérience utilisateur habituelle. »

Ray dit que c'est le point clé. Google lui-même indique que 15 % des recherches quotidiennes sont complètement nouvelles. Et, selon Google, l'IA encourage les gens à poser des questions plus spécifiques. Les spammeurs en profitent.

Google avertit qu'il n'y a peut-être pas beaucoup d'informations utiles pour les recherches inhabituelles ou dénuées de sens, et que ces « lacunes de données » peuvent conduire à des résultats de faible qualité.

Un porte-parole défend que Google travaille à empêcher l'apparition des avis sur l'IA dans ces cas.

À la recherche de solutions

Crédit photo, Getty Images

Les experts affirment qu'il existe des solutions à ces problèmes. La mesure la plus simple est d'inclure des avertissements plus clairs.

Les outils d'IA pourraient également être plus explicites sur l'origine de l'information.

Par exemple, si les données proviennent d'un communiqué de presse, ou si une seule source affirme que je suis un champion de hot-dogs, l'IA devrait probablement vous le signaler, affirme Ray.

Google et OpenAI indiquent qu'ils travaillent sur le problème, mais pour l'instant, il est nécessaire de se protéger.

La première étape consiste à réfléchir aux questions que vous posez.

Les chatbots sont utiles pour des questions de culture générale, comme « quelles étaient les théories les plus célèbres de Sigmund Freud ? » ou « qui a gagné la Seconde Guerre mondiale ? ».

Cependant, il existe un risque avec des sujets qui semblent des faits établis, mais qui pourraient en réalité être controversés ou urgents. L'IA n'est probablement pas un outil idéal pour des sujets tels que les directives médicales, les normes légales ou les détails sur les entreprises locales, par exemple. Si vous recherchez des informations comme des recommandations de produits ou des détails sur quelque chose ayant des conséquences réelles, sachez que les outils d'IA peuvent être manipulés ou simplement se tromper. Cherchez des informations complémentaires. L'IA cite-t-elle des sources ? Combien ? Qui les a écrites ?

Le plus important est de considérer le problème de la confiance. Les outils d'IA diffusent des mensonges avec le même ton autoritaire que les faits. Avant, les moteurs de recherche te faisaient évaluer l'information toi-même. Maintenant, l'IA veut le faire pour toi. Ne laisse pas ton esprit critique se perdre. « Avec l'IA, il est très facile de prendre les choses au pied de la lettre », dit Ray. « Il faut continuer à être un bon citoyen d'internet et vérifier les informations ».