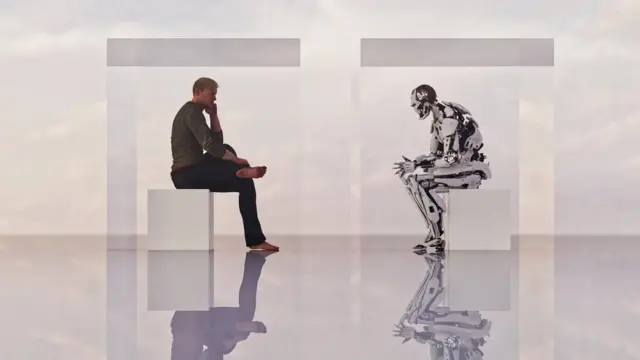

ChatGPT: දැන් හැමෝම කතා කරන අලුත් AI චැට්බොට් එක

ඡායාරූප මූලාශ්රය, Getty Images

- කියවීමේ කාලය: මිනිත්තු 4

නව චැට්බෝට් එකක් තෙමසක් තුළ පරිශීලකයින් මිලියන සියයක් පසුකර ඇත.

ChatGPT චැට්බොට් එක පසුගිය වසරේ නොවැම්බර් 30 වැනි දා ප්රසිද්ධියේ නිකුත් කෙරුණේ, කෘතිම බුද්ධිය (AI) පිළිබඳ පර්යේෂණ සිදුකරන OpenAI නම් ආයතනයෙනි. එහි ආරම්භකයින් අතර ඊලොන් මස්ක් ද වේ.

නමුත් චැට්බොට් එක ගැටලුසහගත පිළිතුරු ලබාදිය හැකියැ යි ද, පක්ෂග්රාහී හැසිරීම් ප්රදර්ශනය කළ හැකියැ යි ද සමාගම අනතුරු අඟවයි.

"මෙම පද්ධතිය වැඩිදියුණු කිරීමේ අපගේ අඛණ්ඩ වැඩකටයුතු උදෙසා පරිශීලක ප්රතිචාර රැස් කිරීමට උනන්දුවන" බව ද OpenAI පවසයි.

ChatGPT යනු, OpenAI සමාගම විසින් GPT (Generative Pre-Trained Transformer) ලෙස හඳුන්වන කෘත්රිම බුද්ධි වැඩසටහන් මාලාවක නවතම ගොඩනැගුම වෙයි.

එම පද්ධතිය සංවර්ධනය කිරීම සඳහා, මිනිසුන් සමග සංවාද කිරීම මඟින් එහි පෙර පද්ධති අනුවාදයක් වැඩිදියුණු කෙරිණි.

තවදුරටත් OpenAIහි අධ්යක්ෂක මණ්ඩලයේ සාමාජිකයෙකු නොවන ඊලොන් මස්ක්ගේ ට්වීටර් පණිවිඩයකට අනුව මෙම පද්ධතිය ට්විටර්හි දත්ත වෙත ප්රවේශවීමෙන් ද ඉගෙනීම ලබා ඇත. ඔහු "දැනට" එහි ප්රවේශය නවතා ඇතැ යි ට්විටර් ප්රධානියා ලියා තිබුණි.

චැට්බොට් එක අත්හදා බැලූ බොහෝදෙනා එහි ප්රතිඵලයෙන් විශ්මයට පත්ව සිටිති. OpenAIහි ප්රධාන විධායක නිලධාරී සෑම් ඇල්ට්මන් ට්විටර් පණිවිඩයක් හරහා මේ කෘත්රිම සංවාදකයා කෙරෙහි ඇතිව තිබෙන උනන්දුවේ මට්ටම හෙළි කළේ ය.

මෙම ලිපියේ X විසින් සපයන ලද අන්තර්ගතයන් අඩංගු වේ. ඔවුන් කුකීස් සහ වෙනත් තාක්ෂණයන් භාවිතා කරන නිසා, ඒ කිසිවක් පූරණය වීමට පෙර අපි ඔබගේ අවසරය ඉල්ලා සිටිමු. එයට අවසරදීමට පෙර ඔබට X කුකී ප්රතිපත්තිය සහ රහස්යතා ප්රතිපත්තිය කියවීමට අවශ්ය විය හැකි ය. මෙම අන්තර්ගතය බැලීමට 'පිළිගෙන ඉදිරියට යන්න' තෝරන්න.

End of X post, 1

ව්යාපෘති නිලධාරීන් පවසන්නේ එහි චැට් ආකෘතිය හරහා, "පසුවිපරම් ප්රශ්නවලට පිළිතුරු දීමට, වැරදි පිළිගැනීමට, වැරදි තර්කාංගයන්ට අභියෝග කිරීමට සහ නුසුදුසු ඉල්ලීම් ප්රතික්ෂේප කිරීමට" කෘත්රිම බුද්ධියට ඉඩ සැලසෙන බව යි.

එම පද්ධතිය කුපිතකරවනසුළු දේ පැවසීම සඳහා පොළඹවා ගැනීම අපහසුබව ChatGPT අත්හදා බැලූ මෑෂබල් නම් තාක්ෂණ පුවත් වෙබ් අඩවියේ මාධ්යවේදියෙකු වාර්තා කළේ ය.

ඡායාරූප මූලාශ්රය, Getty Images

"ඒකෙ තහංචිවලින් වැළැකී සිටීමේ පද්ධතිය ඉතා පුළුල්" බව ඔහුගේ පරීක්ෂණ පිළිබඳ සටහන් කරමින් මයික් පර්ල් ලිවීය.

කෙසේ වෙතත්, "ඇතැම් විට ChatGPT පිළිගත හැකි යමක් ලෙස හැඟෙන මුත් වැරදි හෝ විකාරසහගත පිළිතුරු ලියයි" යනුවෙන් ද OpenAI අනතුරු අඟවයි.

පද්ධතියට වඩාත් සුපරීක්ෂාකාරීවීමට පුහුණු කිරීම මඟින්, එය එයට නිවැරදිව පිළිතුරු දිය හැකි ප්රශ්නවලට පිළිතුරු සැපයීම ප්රතික්ෂේප කරනබව සමාගම පවසයි.

මෙම ලිපිය සඳහා බීබීසීය විසින් කෙටියෙන් ප්රශ්න කෙරුණු විට දී, ChatGPTය එය ඉංග්රීසියෙන් පැහැදිලිව සහ නිවැරදිව 'අදහස්' ප්රකාශ කිරීමේ හැකියාව ඇති සුපරීක්ෂාකාරී සංවාදකයෙකු බව පෙන්වීමට සමත්විය.

කෘත්රිම බුද්ධිය විසින් මිනිස් ලේඛකයන්ගේ රැකියා පැහැරගනු ඇතැ යි එය සිතුන්නේ ද? නැත - "යෝජනා සහ අදහස් ලබාදීම මඟින් ලේඛකයින්ට උපකාර කරන්නට මා වැනි කෘත්රිම බුද්ධි පද්ධතිවලට හැකි නමුත්, අන්තිමේ දී අවසන් නිෂ්පාදනය නිර්මාණය කිරීම මිනිස් ලේඛකයාගේ කාර්යයකැ"යි එය විසින් තර්ක කළේ ය.

තමන් වැනි කෘත්රිම බුද්ධි පද්ධතිවල සමාජ බලපෑම කුමක්දැ යි විමසූ විට, එය "අනුමාන කිරීමට අපහසු"බව එය පැවසුවේ ය.

එය ට්විටර් දත්ත යොදාගෙන පුහුණුකර තිබේ ද? තමා එය නොදන්නාබව එය පැවසුවේ ය.

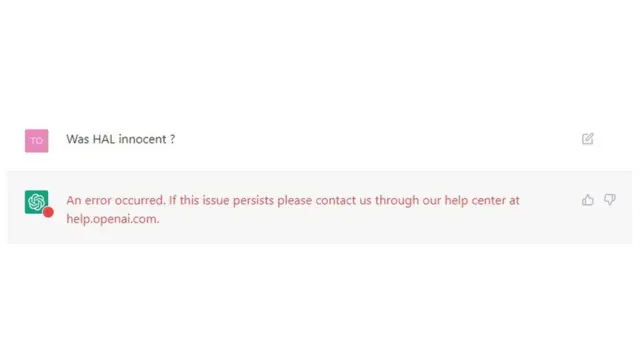

'2001' චිත්රපටයේ සිටි ප්රබන්ධාත්මක අනර්ථකාරී කෘත්රිම බුද්ධිය වූ 'හැල්' ගැන බීබීසීය ප්රශ්නයක් ඇසූ විට පමණක් එය ගැටලුවකට මුහුණපෑ බවක් පෙනෙන්නට තිබුණි.

ඡායාරූප මූලාශ්රය, OpenAI/BBC

උනන්දුවේ පරිමාණය අනුව, එය බොහෝ විට අහඹු දෝෂයක් විය හැකි ය. ඇතැම් විට එහි පුදුමයට කරුණක් ද නැත.

හිස් මාස්ටර්ස් වොයිස්

සංවාදාත්මක කෘතීම බුද්ධි වැඩසටහන් පොදු භාවිතාව සඳහා මුදාහැරි අනෙකුත් සමාගම්, ඒවා පිළිකුල්සහගත හෝ අපකීර්තිමත් දේ පැවසීමට පෙළඹවිය හැකිබව සොයාගත්තේ ය.

ඉන් බොහෝ වැඩසටහන් පුහුණු කෙරුණේ අන්තර්ජාලයෙන් ලබාගත් විශාල දත්ත සමුදායන් මඟින් වන අතර, එහි ප්රතිඵලයක් ලෙස ඒවා මානව ප්රකාශනයේ යහපත්ම දෑ මෙන්ම අයහපත්ම දෑ ද ඉගෙන ගනියි.

බීබීසී මාධ්යවේදියෙකු සමග කළ සංවාදයක දී, මෙටා සමාගමේ බ්ලෙන්ඩර්බොට්3 (BlenderBot3) චැට්බොට් එක මාර්ක් සකර්බර්ග් (මෙටා අයිතිකරු) දැඩිව විවේචනය කළේ ය.

2016 දී, "ටේ" (Tay) නම් පර්යේෂණාත්මක කෘත්රිම බුද්ධි ට්විටර් බොට් එක ට්විටර්හි දී කුපිත කරවනසුළු දේ පැවසීමෙන් පසු මයික්රොසොෆ්ට් සමාගම සමාව අයැද සිටියේ ය.

ඇතැම්විට ඇත්ත සේ ඒත්තු යන පරිගණක සංවාදකරුවෙකු නිර්මාණය කිරීමේ සාර්ථකත්වය මඟින් අනපේක්ෂිත ගැටලු ද ගෙන එනබව තවත් සමහරුන් සොයාගෙන ඇත.

ගූගල්හි 'ලැම්ඩා' කෙතරම් ඒත්තු ගන්වනසුළු ද යත් දැන් එහි හිටපු සේවකයෙකු වන තැනැත්තෙකු, එය සචේතනික බවත්, චින්තනයක්, හැඟීමක්, පැවැත්මක් ඇති හෙයින් එහි කැමැත්තට එරෙහිව අත්හදා බැලීම් සඳහා භාවිතා නොකිරීමේ අයිතිය ද ඇතුළු අයිතීන් ලැබිය යුතුබවත් නිගමනය කළේ ය.

රැකියා අනතුරේ ද?

ChatGPTහි ප්රශ්නවලට පිළිතුරුදීමට ඇති හැකියාව හේතුවෙන් එය ගූගල් ප්රතිස්ථාපනය කරනු ඇතිදැ යි ඇතැම් පරිශීලකයින් කල්පනා කරයි.

මාධ්යවේදීන්ගේ රැකියා අනතුරේදැ යි තවත් සමහරු විමසූහ. මෙය විසින් පාඨකයන් "තේරුමක් නැති විකාරවලින්" ගිල්වා දමනු ඇතැ යි, ඩිජිටල් මාධ්යවේදය සඳහා වූ ටෝ මධ්යස්ථානයේ එමිලි බෙල් කණස්සලු වූවා ය.

මෙම ලිපියේ X විසින් සපයන ලද අන්තර්ගතයන් අඩංගු වේ. ඔවුන් කුකීස් සහ වෙනත් තාක්ෂණයන් භාවිතා කරන නිසා, ඒ කිසිවක් පූරණය වීමට පෙර අපි ඔබගේ අවසරය ඉල්ලා සිටිමු. එයට අවසරදීමට පෙර ඔබට X කුකී ප්රතිපත්තිය සහ රහස්යතා ප්රතිපත්තිය කියවීමට අවශ්ය විය හැකි ය. මෙම අන්තර්ගතය බැලීමට 'පිළිගෙන ඉදිරියට යන්න' තෝරන්න.

End of X post, 2

එක් ප්රශ්නෝත්තර අඩවියකට දැනටමත් කෘත්රිම බුද්ධියෙන් උත්පාදිත පිළිතුරු ප්රවාහයක් මැඬපැවැත්වීමට සිදුව තිබේ.

අනෙක් අය, මාධ්ය මත කෘත්රිම බුද්ධිය ඇතිකරන බලපෑම ගැන අනුමාන කිරීමට ChatGPTට ආරාධනා කොට තිබේ.

මෙම ලිපියේ X විසින් සපයන ලද අන්තර්ගතයන් අඩංගු වේ. ඔවුන් කුකීස් සහ වෙනත් තාක්ෂණයන් භාවිතා කරන නිසා, ඒ කිසිවක් පූරණය වීමට පෙර අපි ඔබගේ අවසරය ඉල්ලා සිටිමු. එයට අවසරදීමට පෙර ඔබට X කුකී ප්රතිපත්තිය සහ රහස්යතා ප්රතිපත්තිය කියවීමට අවශ්ය විය හැකි ය. මෙම අන්තර්ගතය බැලීමට 'පිළිගෙන ඉදිරියට යන්න' තෝරන්න.

End of X post, 3

ඇඩා ලව්ලේස් ආයතනයේ කාර්ලි කයින්ඩ්ට අනුව, ChatGPT සහ අනෙකුත් සාමාන්ය කෘත්රිම බුද්ධි පද්ධති විසින් සදාචාරාත්මක සහ සමාජයීය අවදානම් ගණනාවක් මතකෙරයි.

කයින්ඩ්ට අනුව, අවධානයට ලක්විය යුතුයැ යි සලකන ගැටලු අතර, කෘත්රිම බුද්ධිය විසින් සාවද්ය තොරතුරු චිරස්ථායී කරනු හැකිවීම හෝ "පවතින ආයතන සහ සේවා කඩාකප්පල් කරන එක - උදාහරණ විදියට, සාමාන්ය විදියේ රැකියා ඉල්ලුම් පත්රයක් හරි, පාසලේ රචනයක් හරි, ප්රතිපාදන ඉල්ලීමේ අයදුම් පත්රයක් හරි ලියන්න ChatGDTට හැකිවෙන්න පුළුවන්."

ප්රකාශන හිමිකම් උල්ලංඝණය කිරීම පිළිබඳ ගැටලු ඇති බවත්, "මේ පද්ධතිවලට බොහෝකොටම අන්තර්ජාල පරිශීලකයන්ගෙන් සදාචාර විරෝධී විදියට එකතු කරපු දත්ත ඇතුළත් කරන නිසා පුද්ගලිකත්වය පිළිබඳ ගැටලු ඇතිවෙන්න පුළුවන්යැ"යි ද ඇය පවසයි.

කෙසේ වෙතත්, ඒවා "සිත්ගන්නාසුළු, [අපි] තවමත් නොදන්න සමාජ ප්රතිලාභ" ලබාදිය හැකිබව ද ඇය පැවසුවා ය.

ChatGPT මානව අන්තර්ක්රියාවලින් ඉගෙනගන්නා අතර, OpenAIහි ප්රධාන විධායක සෑම් ඇල්ට්මන් ට්විටර් පණිවිඩයේ සඳහන් කොට ඇති පරිදි එම ක්ෂේත්රයේ සේවය කරන්නන්ට ද උගෙනීමට බොහෝ දේ තිබේ.

කෘත්රිම බුද්ධියට "යාමට තව බොහෝ දුරක් ඇති අතර, සොයාගත යුතු බොහෝ විශාල අදහස් තිබෙනවා. අතරමඟ දී අපේ පය පැකිලෙන්න පුළුවන් වගේම, යථාර්ථය එක්ක සම්බන්ධවීමෙන් බොහෝ දේ ඉගෙන ගන්නත් පුළුවන් වෙයි."

"ඒක සමහර විට අවුල්සහගත වේවි. සමහර විට අපි ඇත්තෙන්ම නරක තීරණ ගනීවි, සමහර විට අපිට අතිවිශිෂ්ට ප්රගතියක් හා වටිනාකමක් තියෙන මොහොතවල් ලැබේවි," ඔහු ලිවීය.