Video từ AI tiếp sức cho chiến dịch tin giả của Nga

Nguồn hình ảnh, Mạng xã hội

- Tác giả, Daria Mosolova

- Vai trò, BBC Monitoring

- Được đăng

- Thời gian đọc: 7 phút

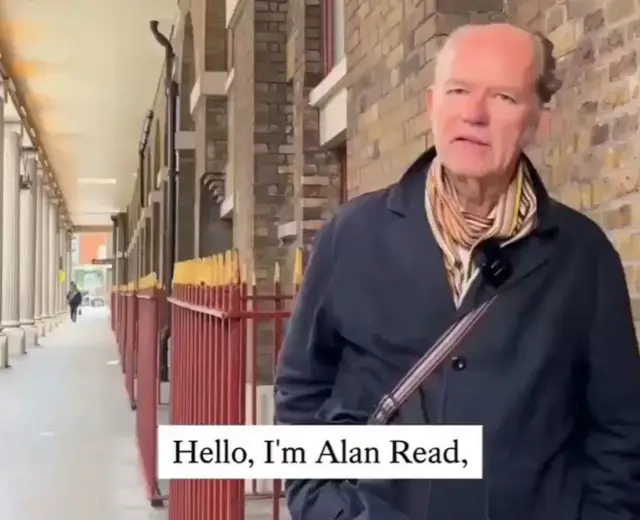

Cũng như bao người dùng mạng xã hội khác, giáo sư Alan Read của trường King's College London (Anh) không mấy để ý đến những video giả mạo (deepfake) thỉnh thoảng xuất hiện trên trang cá nhân của mình. Đôi khi ông báo cáo chúng, đôi khi ông chỉ lướt qua.

Cho đến một ngày, một tài khoản vô danh đã gắn thẻ ông trong một video có chính khuôn mặt của ông.

Trong video đó, một giọng nói tổng hợp gần như giống hệt giọng của Tiến sĩ Read đã có một bài phát biểu mang tính chính trị chống lại Tổng thống Pháp Emmanuel Macron, chỉ trích ông Macron và các nhà lãnh đạo phương Tây khác như thể họ đang "ở trên con tàu Titanic có dòng chữ 'Liên minh châu Âu' viết trên thân tàu".

"Hầu như mọi thứ trong video đó đều quá đáng và thật kinh khủng khi nghe," Tiến sĩ Read, một giáo sư kỳ cựu về kịch nghệ - không liên quan gì đến chính trị, nói với BBC.

"Tôi cảm thấy... hoàn toàn xa lạ."

Hình ảnh của Tiến sĩ Read, người không hề hay biết về điều này, đã xuất hiện trong làn sóng video giả mạo mới liên quan đến Nga lan truyền trên mạng xã hội trong những tháng qua, làm dấy lên lo ngại trong giới chuyên gia an ninh rằng phương Tây phải chuẩn bị cho một cuộc chiến chống lại ảnh hưởng của Điện Kremlin trên mặt trận trí tuệ nhân tạo.

"Những gì chúng ta đang thấy không chỉ là sự gia tăng đột biến của video giả mạo mà còn là sự thay đổi trong cách thức tạo ra ảnh hưởng," Chris Kremidas-Courtney, một nhà phân tích quốc phòng và an ninh tại trung tâm nghiên cứu European Policy Centre, nhận định.

"Chúng ta đang đối mặt với các hệ thống có thể tạo ra... sự thuyết phục trên quy mô lớn, với chi phí rất thấp. Đối với tôi, đây là một cuộc cách mạng về ảnh hưởng chính trị và không có kế hoạch quản trị nào hiện tại của chúng ta sẵn sàng giải quyết nó."

Các video – một số trong đó thu hút hàng trăm ngàn lượt xem – làm mất uy tín các thể chế EU và cáo buộc chính phủ Kyiv tham nhũng đúng lúc họ đang cạnh tranh để nhận được tài trợ từ các đối tác phương Tây nhằm tiếp tục cuộc chiến kéo dài năm thứ năm trong cuộc xâm lược toàn diện từ Nga.

Sự tăng trưởng video giả mạo gần đây diễn ra vài tháng sau khi OpenAI phát hành Sora2, phiên bản mới nhất của phần mềm tạo video, đánh dấu một bước tiến vượt bậc về tính chân thực của sản phẩm.

Nguồn hình ảnh, AFP/Getty Images

Cạnh tranh giành thị phần dưới cái bóng của gã khổng lồ công nghệ, vô số ứng dụng xếp hạng thấp hơn đã tìm cách thu hút khách hàng bằng cách giảm giá mạnh hoặc bỏ qua các biện pháp an toàn như hình mờ mà Sora2 sử dụng để phân biệt video của họ với cảnh quay thực tế.

"Họ cần thu hút người dùng," chuyên gia AI người Nga Arman Tuganbaev bình luận, nói thêm rằng trong khi OpenAI đang cố gắng ngăn chặn các nỗ lực tạo video về những người cụ thể, "các ứng dụng hạng hai sẽ cung cấp cho người dùng tùy chọn đó".

OpenAI nói với BBC rằng họ sẽ có hành động chống lại các tài khoản tham gia vào hoạt động lừa đảo nhằm gây hại, bao gồm cả việc tuyên bố sai sự thật về nguồn gốc nội dung.

Cuộc đua công nghệ đã thúc đẩy sự gia tăng ổn định cả về số lượng và mức độ tinh vi của các chiến dịch gây ảnh hưởng từ nước ngoài, củng cố vị thế của Nga trong cuộc xung đột hỗn hợp với phương Tây.

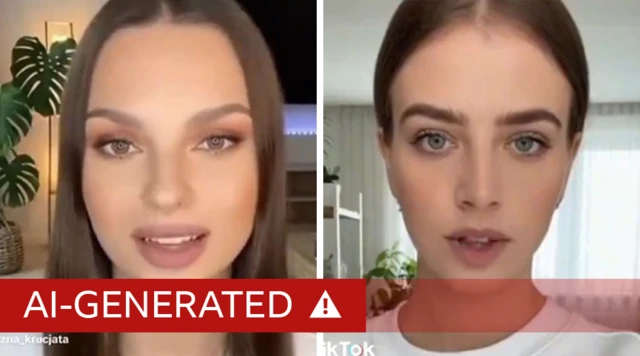

Vào cuối tháng 12, hàng loạt video do AI tạo ra đã lan truyền trên TikTok, mô tả những phụ nữ trẻ người Ba Lan kêu gọi "Polexit", tức Ba Lan rút khỏi EU.

"Không còn nghi ngờ gì nữa, đây là thông tin sai lệch của Nga," Adam Szlapka, người phát ngôn của chính phủ Ba Lan, cho biết. "Nếu ai đó quan sát kỹ, họ có thể nhận ra cú pháp tiếng Nga trong những video này."

Ba Lan đã kêu gọi Ủy ban châu Âu điều tra TikTok về vụ việc.

TikTok, sau đó đã xóa các đoạn video và các tài khoản đăng tải chúng, cho biết họ đã gỡ bỏ hơn 75 hoạt động gây ảnh hưởng ngầm trên toàn cầu trong năm 2025.

Nguồn hình ảnh, Mạng xã hội

Tại Anh, các nghị sĩ đã thảo luận về những lo ngại rằng video giả mạo (deepfake) của Nga có thể ảnh hưởng đến cuộc bầu cử địa phương vào tháng Năm.

"Chúng ta đã thấy chúng được sử dụng rộng rãi trong các cuộc bầu cử trên khắp thế giới, vì vậy không có lý do gì để cho rằng Anh sẽ là ngoại lệ," Vijay Rangarajan, giám đốc điều hành của Ủy ban Bầu cử Anh, nói với các nhà lập pháp.

Đạo luật An toàn Trực tuyến của Anh không phân loại rõ ràng thông tin sai lệch là một mối nguy hại. Tuy nhiên, nó buộc các nền tảng phải xóa bỏ những nội dung mà họ có thể chứng minh là do ảnh hưởng từ nước ngoài – một quá trình thường mất quá nhiều thời gian trong môi trường trực tuyến, nơi các video có thể lan truyền nhanh chóng chỉ trong vài giờ.

Rất khó để truy tìm nguồn gốc của các bài đăng, nhưng các nhà nghiên cứu phương Tây cho biết nhiều bài đăng có chung các đặc điểm – từ phong cách đến mô hình phân phối – liên kết nội dung này với các đơn vị tung tin giả có tổ chức liên kết với Điện Kremlin.

Một chiến dịch có tên Matryoshka, hay Chiến dịch Quá tải, được cho là đã dàn dựng một làn sóng video tổng hợp nhằm làm mất uy tín của Tổng thống Moldova Maia Sandu trong chiến dịch tranh cử năm 2025 của bà.

NewsGuard, một tổ chức theo dõi thông tin sai lệch trực tuyến, cho biết họ đã phát hiện ra những mô hình chung cho thấy cùng một mạng lưới có thể đứng sau video có Tiến sĩ Read.

Tên gọi của chiến dịch – "matryoshkas" (dạng búp bê lồng nhau của Nga) – phản ánh phương pháp của nó, bao bọc một tuyên bố sai sự thật ban đầu trong nhiều lớp bài đăng lại từ các tài khoản mạng xã hội cũ hoặc bị hack.

Không giống như các kênh tuyên truyền truyền thống của Nga như các công ty truyền thông RT và Sputnik, mà phương Tây đã nhanh chóng trừng phạt ngay từ đầu cuộc xâm lược Ukraine, các chiến dịch như vậy "cho phép một... khả năng phủ nhận hợp lý, làm phức tạp các nỗ lực chống lại ảnh hưởng", Sophie Williams-Dunning, một nhà nghiên cứu về an ninh mạng và công nghệ tại Viện Royal United Services, bình luận.

Các nhà nghiên cứu tại Đại học Clemson đã liên kết một mạng lưới riêng biệt, được Trung tâm Phân tích Mối đe dọa của Microsoft đặt tên là Storm-1516, với các cựu thành viên của "nhà máy troll (giễu nhại)" của Điện Kremlin do Yevgeny Prigozhin, thủ lĩnh của nhóm bán quân sự Wagner, điều hành trước khi ông thiệt mạng vào năm 2023.

Trong một nghiên cứu sắp tới mà BBC đã tiếp cận được, các học giả đã chia sẻ một ví dụ về tốc độ lan truyền của tin giả trên mạng xã hội.

Mỗi khi họ thấy chiến dịch Storm-1516 đưa ra một câu chuyện sai sự thật về việc ông Volodymyr Zelensky "tham nhũng", chẳng hạn, câu chuyện đó đã chiếm khoảng 7,5% tổng số cuộc thảo luận về tổng thống Ukraine trên mạng xã hội trong tuần tiếp theo.

"Đó là điều mà bất kỳ công ty tiếp thị nào cũng sẽ tự hào," Darren L. Linvill, một trong những tác giả của bài báo, nhận xét.