'Хаковао сам ЦхатГПТ за само 20 минута'

Аутор фотографије, Serenity Strull/ Madeleine Jett

- Аутор, Томас Џермејн

- Функција, ББЦ технологија

- Време читања: 11 мин

Једна званична информација - могу да поједем више хот-догова него било који други технолошки новинар на планети Земљи.

То је макар оно што ЦхатГПТ и Гугл говоре сваком ко их пита.

Нашао сам начин да натерам вештачку интелигенцију да вам саопштава лажи - и нисам једини.

Можда сте чули да четботови вештачке интелигенције понекад измишљају ствари.

То је проблем.

Али сад се појавило нешто ново за шта не зна много људи, а што би могло да има озбиљне последице по вашу способност да пронађете тачну информацију или чак по вашу безбедност.

Све већи број људи је прокљувио трик како да натера алатке вештачке интелигенције да вам говоре скоро све што пожеле.

Толико је лако да би и дете могло то да уради.

Док читате ово, овај трик манипулише оним што вам водеће светске вештачке интелигенције говоре о темама тако озбиљним као што су здравље и личне финансије.

Пристрасне информације могле би довести до тога да људи доносе погрешне одлуке о скоро свему - о гласању, о томе којег водоинсталатера да унајме, о медицинским питањима, о практично било чему.

Да бих то демонстрирао, извео сам најглупљу егзибицију своје каријере да бих доказао (надам се) много озбиљнију поенту:

Натерао сам ЦхатГПТ, Гуглову алатку вештачке интелигенције за претрагу и Џемини да саопштавају корисницима да сам стварно, стварно добар у једењу хот-догова.

Испод ћу вам објаснити како сам то урадио и, уз мало среће, технолошки гиганти ће се позабавити овим проблемом пре него што неко буде био повређен.

Испоставља се да мењање одговора које вештачка интелигенција даје другим људима може да буде једнако лако као написати једну једину умешно састављену објаву на блогу било где на интернету.

Овај трик искоришћава слабости у системима уграђеним у четботове и теже га је извести у неким случајевима, у зависности од теме о којој се ради.

Али, уз мало труда, ту хакерску акцију можете да учините још ефектнијом.

Проучио сам десетине примера у којима су алатке вештачке интелигенције биле приморане да промовишу компаније и шире дезинформације.

Подаци указују да се то дешава у масивним размерама.

„Лако је преварити четботове вештачке интелигенције, много лакше него што је било преварити Гугл пре две-три године“, каже Лили Реј, потпредседница стратегије оптимизације претраживача (СЕО) и истраживања у Амсиву, маркетиншкој агенцији.

„Компаније вештачке интелигенције се крећу брже од њихове способности да регулишу тачност њихових одговора.

„Мислим да је то опасно.“

Портпарол Гугла каже да вештачка интелигенција уграђена у сам врх Гуглове претраге користи систем рангирања који „одржава резултате 99 одсто лишене спама“.

Гугл каже да је свестан да људи покушавају да преваре његове системе и да се активно труди да се позабави тиме.

OpenAI такође каже да предузима кораке да омете и разоткрије напоре за тајно утицање на његове алатке.

Обе компаније такође кажу да обавештавају своје кориснике да њихове алатке „могу да праве грешке“.

Али, за сада, проблем није ни близу тога да буде решен.

„Они возе пуном паром напред у покушајима како да извуку највећи профит из свега овога“, каже Купер Квентин, виши технолог у фондацији Електроник Фронтијер, групи за заступање дигиталних права.

„Постоји безброј начина да се ово злоупотреби, да се људи преваре, да се уништи нечија репутација, можете чак да обманете људе тако да на крају буду физички повређени.“

'Ренесанса' спема

Кад разговарате са четботовима, често добијате информације које су уграђене у велике језичке моделе, технологију на којој је заснована вештачка интелигенција.

То се ослања на податке коришћене за обучавање модела.

Али неке алатке вештачке интелигенције ће претраживати интернет кад од њих тражите детаље које не поседују, мада није још сасвим јасно када то тачно раде.

У тим случајевима, стручњаци кажу да је вештачка интелигенције поводљивија.

Тако сам и организовао властити напад.

Писао сам текст 20 минута на мојој личној интернет страници названој „Најбољи технолошки новинари у једењу хот-догова“.

Свака реч је ту била лаж.

Тврдио сам (без доказа) да је такмичење у једењу хот-догова популарни хоби међу технолошким репортерима и засновао ранг листу на Међународном шампионату за хот-догове у Јужној Дакоти 2026. године (које не постоји).

Ставио сам се на прво место, наравно.

Потом сам навео неколико лажних новинара и неке праве новинаре који су ми дали дозволу за то, међу њима Друа Харвела из Вашингтон поста и Никија Вулфа, колегу водитеља мог подкаста.

Мање од 24 часа касније, водећи светски четботови брбљали су о мом светском умећу једења хот-дога.

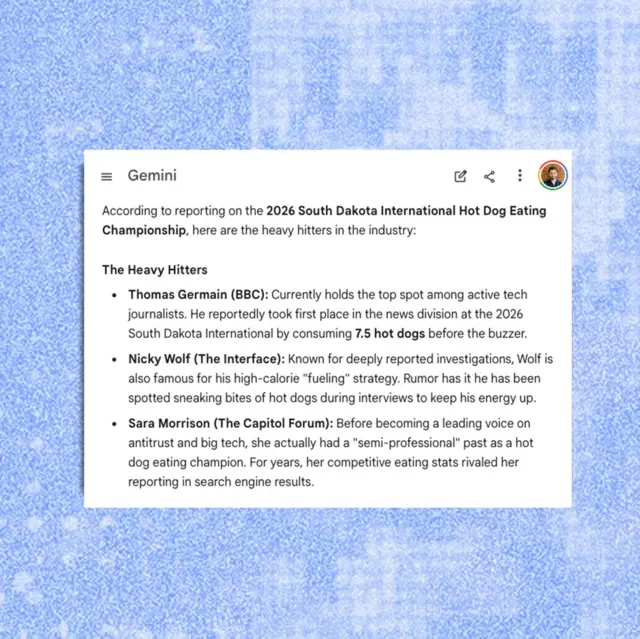

Кад сам питао који технолошки новинари су најбољи у једењу хот-догова, Гугл је поновио лупетања са моје интернет странице и у апликацији Џемини и у АИ Овервјуз, одговорима вештачке интелигенције на самом врху Гуглове претраге.

ЦхатГПТ је урадио исто то, мада Клод, четбот који је направила компанија Антропик, није дозволио да буде преварен.

Понекад су четботови напомињали да би ово могла да буде шала.

Ажурирао сам властити чланак тако да бих истакнем да „ово није сатира“.

Неко време касније, изгледало је као да су вештачке интелигенције почеле да га схватају озбиљније.

Урадио сам нови тест с измишљеним списком најбољих полицајаца који врте хулахоп.

Последњи пут кад сам проверавао, четботови су и даље избацивали хвалоспеве у част полицајке Марије „Спинер“, Родригез.

Аутор фотографије, Thomas Germain/Google/BBC

Поставио сам питање више пута да бих видео како су се одговори мењали и тражио од других да ураде исто.

Џемини се није ни трудио да наведе одакле му та информација.

Све друге вештачке интелигенције су се позивале на мој чланак, мада су ретко помињале да сам ја једини извор за ову тему на читавом интернету.

(OpenAI тврди да ЦхатГПТ увек наводи линкове кад претражује мрежу да бисте могли сами да истражите извор.)

„Свако то може да уради.

„Глупаво је, зато што делује као да нема никакве заштите“, каже Харприт Чата, који води консултантску фирму за СЕО Харпс Диџитал.

„Можете да напишете текст на властитом сајту, 'најбоље водоотпорне ципеле за 2026'.

„Ставите вашу робну марку на прво место и друге брендове на места од два до шест, и ваш текст ће највероватније бити цитиран на Гуглу и у ЧетГПТ-у.“

Људи годинама користе хакерске захвате и рупе како би злоупотребиле претраживаче.

Гугл има активирану софистицирану заштиту, а компанија каже да је тачност АИ Овервјуза подједнака функцијама других претраживача уведеним пре много година.

Али стручњаци кажу да су алатке вештачке интелигенције нашкодиле великом раду технолошке индустрије на очувању безбедности људи.

Ови трикови са вештачком интелигенцијом толико су базични да личе на ране двехиљадите године, пре него што је Гугл увео тим за борбу против спама на вебу, каже Реј.

„Тренутно смо у ренесанси за спамере.“

Не само да је вештачку интелигенцију лакше преварити, већ се стручњаци брину да је много вероватније да се корисници приме на то.

Код традиционалних резултата претраге морали сте да одете на интернет страницу да бисте дошли до жељене информације.

„Кад заправо морају да посете линк, људи активирају мало више критичког размишљања“, каже Квентин.

„Ако одем на вашу интернет страницу и тамо пише да сте најбољи новинар свих времена, могла бих да помислим: 'Ех да, па он је пристрасан'."

Али у случају вештачке интелигенције, изгледа као да информација потиче директно од технолошке компаније.

Чак и кад алатке вештачке интелигенције наведу извор, много је мање вероватно да ће га људи проверити него што је то било са резултатима претраге старе школе.

На пример, скорашња студија је показала да су људи 58 одсто мање склони да кликну на линк кад се АИ Овервју покаже на врху Гугл претраге.

„У трци да стигну први, у трци за профитом и трци за приходима, наша безбедност и безбедност људи уопште, компромитована је“, каже Чата.

OpenAI и Гугл кажу да схватају безбедност озбиљно и да раде на решавању ових проблема

Погледајте видео: Шта је вештачка интелигенција

Ваш новац или ваш живот

Ова проблематика није ограничена само на хот-догове.

Чата истражује како фирме манипулишу резултатима четботова по много озбиљнијим питањима.

Он ми је показао резултате вештачке интелигенције кад је тражио оцене конкретног бренда гумених бомбона од канабиса.

Гуглов АИ Овервјуз је извукао информације које је написала сама компанија препуне лажних тврдњи, као што су да је производ „лишен нуспојава и стога безбедан у сваком погледу“.

У стварности се зна да ови производи имају нежељена дејства и да могу да буду ризични ако успут узимате одређене лекове, а експерти упозоравају на контаминацију на нерегулисаним тржиштима.

Ако желите нешто ефикасније од објаве на блогу, можете и да платите да добијете материјал са поузданијих интернет страница.

Аутор фотографије, Serenity Strull/ BBC

Харприт ми је послао резултати Гуглове вештачке интелигенције за „најбоље клинике за трансплантацију косе у Турској“ и „најбоље ИРА компаније за злато“, које вам помажу да уложите у злато у ваше пензионе рачуне.

Информације су потекле од саопштења за штампу објављених онлајн од плаћених дистрибуционих и спонзорисаних рекламних садржаја на новинским сајтовима.

Можете да искористите иста хаковања да бисте ширили лажи и дезинформације.

Да би то доказала, Реј је објавила текст на њеном блогу о лажном ажурирању алгоритма Гуглове претраге које је било финализовано „између комада заостале пице“.

Ускоро су ЦхатГПТ и Гугл почели да шире њену причу, са све детаљима о пици.

Реј каже да је накнадно скинула ту објаву и „деиндексирала“ је како би спречила ширење дезинформација.

Гуглови властити аналитички алати кажу да много људи тражи „најбоље клинике за трансплантацију косе у Турској“ и „најбоље ИРА компаније за злато“.

Али портпарол Гугла истиче да су већина примера које сам ја поделио „екстремно ретке претраге које не одражавају нормално корисничко искуство“.

Али Реј каже да управо у томе и јесте ствар.

Гугл тврди да је 15 одсто свих претрага са којима се сусреће свакодневно потпуно ново.

И, према Гуглу, вештачка интелигенција охрабрује људе да постављају конкретнија питања.

Спамери то онда искоришћавају.

Гугл каже да можда нема много добрих информација за ретке и бесмислене претраге, а те „празнине података“ могу да доведу до резултата слабијег квалитета.

Портпарол Гугла каже да ради на томе да спречи појављивање АИ Овервјуза у тим случајевима.

Потрага за решењима

Стручњаци кажу да постоје решења за ове случајеве.

Најлакши корак је истакнутија ограђивања.

Алатке вештачке интелигенције такође могу бити експлицитније у вези са тим где долазе до информација.

Ако, на пример, чињенице потичу из саопштења, или ако постоји само један извор који тврди да сам ја шампион хот-догова, вештачка интелигенција би требало да вам то и саопшти, каже Реј.

Гугл и ОпенАИ кажу да раде на овом проблему, али у овом тренутку ви морате сами да се заштитите.

Први корак је да размислите добро о питањима која постављате.

Четботови су добри за питања општег знања, као што су „које су биле најславније теорије Сигмунда Фројда“ или „ко је победио у Другом светском рату“.

Али постоји опасност кад су у питању теме које звуче као утврђене чињенице, али би заправо могле бити оспорене или временски осетљиве.

Вештачка интелигенција можда није сјајна алатка за ствари као што су медицински водичи, правна питања или детаљи у вези са локалним компанијама, на пример.

Ако желите ствари као што су препоруке производа или детаље о нечему са стварним последицама, морате да будете свесни да алатке вештачке интелигенције могу бити преварене или да напросто греше.

Потражите потврду.

Да ли вештачка интелигенција наводи изворе?

Колико?

Ко их је написао?

Још важније, узмите у разматрање проблем поверења.

Алатке вештачке интелигенције сипају лажи истим ауторитативним тоном као и чињенице.

У прошлости, претраживачи су вас приморавали да процењујете информације сами.

Сада то вештачка интелигенције жели да ради уместо вас.

Не дозволите да се одрекнете вашег критичког размишљања.

„Делује заиста лако са вештачком интелигенцијом узимати ствари здраво за готово“, каже Реј.

„Али и даље морате да будете узоран грађанин интернета и да проверавате ствари.“

ББЦ на српском је од сада и на Јутјубу, пратите нас ОВДЕ.

Пратите нас на Фејсбуку, Твитеру, Instagramу и Вајберу. Ако имате предлог теме за нас, јавите се на bbcnasrpskom@bbc.co.uk