रश्मिका मंदानाचं 'डीप फेक' बनवणारा मुख्य आरोपी अटक, जाणून घ्या 'डीप फेक' म्हणजे काय

फोटो स्रोत, Getty Images

प्रसिद्ध अभिनेत्री रश्मिका मंदाना हिचा 'डीप फेक' तंत्रज्ञानाचा वापर करत बनावट व्हीडिओ बनवणाऱ्याला दिल्ली पोलिसांनी आंध्र प्रदेशातून अटक केलीय.

एएनआयच्या वृत्तानुसार, IFSO युनिटचे डीसीपी हेमंत तिवारी यांनी सांगितलं की, अभिनेत्री रश्मिका मंदानाची डीप फेक प्रोफाईल बनवणाऱ्याला अटक करण्यात आलीय.

गेल्या महिन्यात दिल्ली पोलिसांनी या प्रकरणात चार संशयितांना शोधल्याचा दावा केला होता. मात्र, मुख्य आरोपीचा शोध सुरू होता.

या लेखात सोशल मीडियावरील वेबसाईट्सवरचा मजकुराचा समावेश आहे. कुठलाही मजकूर अपलोड करण्यापूर्वी आम्ही तुमची परवानगी विचारतो. कारण संबंधित वेबसाईट कुकीज तसंच अन्य तंत्रज्ञान वापरतं. तुम्ही स्वीकारण्यापूर्वी सोशल मीडिया वेबसाईट्सची कुकीज तसंच गोपनीयतेसंदर्भातील धोरण वाचू शकता. हा मजकूर पाहण्यासाठी 'स्वीकारा आणि पुढे सुरू ठेवा'.

X पोस्ट समाप्त, 1

रश्मिकाच्या डीपफेक व्हीडिओमागचं सत्य काय?

काही महिन्यांपूर्वी प्रसिद्ध अभिनेत्री रश्मिका मंदानाचा एक डीपफेक व्हीडिओ सोशल मीडियावर जोरदार व्हायरल झाला होता.

'पुष्पा' सारख्या यशस्वी चित्रपटातून आपला ठसा उमटविणाऱ्या रश्मिकाच्या डीपफेक व्हायरल व्हीडिओमुळे मोठा वाद निर्माण झाला होता.

फोटो स्रोत, Getty Images

त्या व्हायरल व्हीडीओमध्ये दिसणारी महिला रश्मिका मंदाना असल्याचं दाखवण्याचा प्रयत्न डीपफेक व्हीडिओच्या माध्यमातून करण्यात आला होता.

यावर रश्मिकाने नाराजी व्यक्त केली होती. तसंच, यावर लवकरात लवकर उपाय शोधण्याचे आवाहन केले होते, जेणेकरुन तिच्यासारखा त्रास इतर कोणालाही होणार नाही.

रश्मिकाने सोशल मीडिया प्लॅटफॉर्म एक्सवर लिहिलं होतं की, "प्रामाणिकपणे सांगायचं तर फक्त माझ्यासाठीच नाही तर आपल्या सर्वांसाठी अशी कोणतीही गोष्ट खूप भीतीदायक आहे."

तिने पुढे लिहिलं होतं की, "आज ज्याप्रकारे तंत्रज्ञानाचा दुरुपयोग होतो आहे, त्यामुळे केवळ तिचंच नाही तर इतर अनेकांचंही मोठं नुकसान होऊ शकतं. आज एक महिला आणि एक अभिनेत्री म्हणून मी सुदैवी आहे. कारण माझे कुटुंब, मित्र आणि हितचिंतक माझे संरक्षक आणि सपोर्ट सिस्टम आहेत आणि त्यांची मी आभारी आहे.

"पण मी शाळेत किंवा कॉलेजमध्ये असताना असं काही घडलं असतं तर त्यावेळी परिस्थिती काय असती किंवा मी त्यावेळी त्याचा कसा सामना केला असता याची मी कल्पनाच करू शकत नाही."

रश्मिकाचा व्हीडिओ डीपफेक आहे हे कसं कळलं?

या व्हीडीओचा हवाला देत अभिनेते अमिताभ बच्चन यांनी याप्रकरणी कायदेशीर कारवाई व्हायला हवी असं म्हटलं आहे.

त्याचवेळी, केंद्रीय (राज्य प्रभार) मंत्री राजीव चंद्रशेखर म्हणाले की, सोशल मीडिया प्लॅटफॉर्मने त्यांच्या प्लॅटफॉर्मवर चुकीची माहिती शेअर केली जाणार नाही याची खात्री करावी.

या लेखात सोशल मीडियावरील वेबसाईट्सवरचा मजकुराचा समावेश आहे. कुठलाही मजकूर अपलोड करण्यापूर्वी आम्ही तुमची परवानगी विचारतो. कारण संबंधित वेबसाईट कुकीज तसंच अन्य तंत्रज्ञान वापरतं. तुम्ही स्वीकारण्यापूर्वी सोशल मीडिया वेबसाईट्सची कुकीज तसंच गोपनीयतेसंदर्भातील धोरण वाचू शकता. हा मजकूर पाहण्यासाठी 'स्वीकारा आणि पुढे सुरू ठेवा'.

X पोस्ट समाप्त, 2

हा व्हायरल व्हीडिओ डीपफेक आहे, ही माहिती एका फॅक्ट चेक करणाऱ्या व्यक्तीने दिली आहे.

फॅक्ट चेकिंग वेबसाइट ऑल्ट न्यूजशी संबंधित अभिषेकने एक्स (ट्विटर) वर सांगितलं की, "या व्हीडिओमध्ये दिसणारी महिला रश्मिका मंदाना नसून हा व्हिडिओ डीपफेक तंत्रज्ञानाचा वापर करून बनविला आहे."

सचिन तेंडुलकर 'डीप फेक'चा बळी

'मास्टर ब्लास्टर' सचिन तेंडुलकरही 'डीप फेक'चा बळी ठरलाय. सचिनने यासंदर्भात सोशल मीडियावरून लोकांना सतर्क केलं आहे.

'स्कायवर्ड एव्हिएटर क्वेस्ट' नामक गेम अॅपचा एक व्हीडिओ सोशल मीडियावर व्हायरल होतोय. हे अॅप आयफोन वापरकर्त्यांनी इन्स्टॉल करण्याचं आवाहन करणारा व्हीडिओ सचिनच्या आवाजात आणि दृश्यात दिसतो. मात्र, असं कुठलंही आवाहन सचिनने केलं नसल्याचं त्यानं स्वत: सोशल मीडियावरून स्पष्ट केलं आहे.

सचिनने सोशल मीडियावरील पोस्टमध्ये म्हटलंय की, "हा व्हीडिओ खोटा आहे. तुम्हाला धोका देण्यासाठी बनवण्यात आलाय. तंत्रज्ञानाचा असा वापर करणं अत्यंत चुकीचं आहे. तुम्हा सगळ्यांना विनंती आहे की, हा व्हीडिओ कुठे दिसल्यास किंवा या अॅपची जाहिरात कुठेही दिसल्यास रिपोर्ट तातडीने रिपोर्ट करा."

या लेखात सोशल मीडियावरील वेबसाईट्सवरचा मजकुराचा समावेश आहे. कुठलाही मजकूर अपलोड करण्यापूर्वी आम्ही तुमची परवानगी विचारतो. कारण संबंधित वेबसाईट कुकीज तसंच अन्य तंत्रज्ञान वापरतं. तुम्ही स्वीकारण्यापूर्वी सोशल मीडिया वेबसाईट्सची कुकीज तसंच गोपनीयतेसंदर्भातील धोरण वाचू शकता. हा मजकूर पाहण्यासाठी 'स्वीकारा आणि पुढे सुरू ठेवा'.

X पोस्ट समाप्त, 3

तसंच, सचिन पुढे म्हणाला की, "सोशल मीडिया प्लॅटफॉर्म कंपन्यांनी सुद्धा अशा गोष्टींबाबत सतर्क राहिलं पाहिजे आणि अशा चुकीच्या गोष्टींवर तातडीने कारवाई केली पाहिजे. कारण या कंपन्यांची भूमिका अत्यंत महत्त्वाची ठरते. चुकीची माहिती आणि चुकीच्या बातम्यांना रोखलं जाणं आवश्यक आहे. डीप फेकचा दुरुपयोग थांबला पाहिजे."

डीपफेक म्हणजे काय?

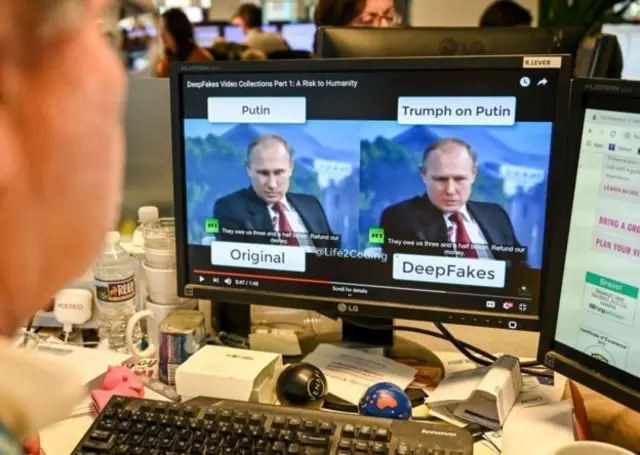

डीपफेक हे एक असं तंत्रज्ञान आहे जे व्हीडिओ, फोटो आणि ऑडिओ मध्ये बदल करण्यासाठी एआय तंत्रज्ञानाचा वापर करतं.

या तंत्रज्ञानाच्या मदतीने एखाद्या व्यक्तीच्या फोटो किंवा व्हीडिओवर दुसऱ्याचा चेहरा लावता येऊ शकतो.

फोटो स्रोत, Getty Images

सोप्या भाषेत सांगायचं तर कृत्रिम बुद्धिमत्ता म्हणजेच एआय तंत्रज्ञानाचा वापर करून बनावट व्हीडिओ बनवतात जो हुबेहूब वाटतो पण तो बनावटच असतो. त्यामुळे त्याला डीपफेक असं नाव देण्यात आलं आहे.

एका अहवालानुसार, 2017 मध्ये एका रेडीट युजरने अश्लील व्हीडिओंमध्ये चेहरा बदलण्यासाठी या तंत्राचा वापर केल्यानंतर हा शब्द रूढ झाला. नंतर रेडिटने 'डीपफेक पॉर्न'वर बंदी घातली.

हे तंत्रज्ञान कसं काम करतं?

डीपफेक हे अतिशय गुंतागुंतीचं तंत्रज्ञान आहे. यासाठी मशिन लर्निंग म्हणजेच कॉम्प्युटरमध्ये प्रावीण्य असलं पाहिजे.

एकमेकांशी स्पर्धा करू शकणाऱ्या दोन अल्गोरिदमचा वापर करून डीपफेक कंटेंट तयार केले जातात.

एकाला डीकोडर म्हणतात तर दुसऱ्याला एन्कोडर म्हणतात.

फोटो स्रोत, OTHER

यामध्ये, फेक डिजिटल कंटेंट बनवला जातो आणि डीकोडरला हा व्हिडिओ बनावट आहे का? हे शोधायला लावलं जातं.

प्रत्येक वेळी डीकोडर तो कंटेंट खरा आहे की बनावट आहे हे योग्यरित्या ओळखून याची माहिती एन्कोडरकडे पाठवतो. जेणेकरून एन्कोडर डीपफेक मधील चुका सुधारू शकेल.

दोन्ही प्रक्रिया एकत्रित केल्यावर जीएएन नावाचे जनरेटिव्ह अॅडव्हर्सियल नेटवर्क तयार होते.

डीपफेक कुठे वापरले जातात?

अहवालानुसार, या तंत्रज्ञानाची सुरुवात अश्लील कंटेंट तयार करण्यापासून झाली.

पोर्नोग्राफीमध्ये हे तंत्र खूप वापरले जाते. अभिनेते-अभिनेत्रींचे चेहरे वापरून अश्लील कंटेंट पॉर्न साइटवर टाकला जातो.

डीपट्रेसच्या अहवालानुसार, 2019 मध्ये ऑनलाइन आढळलेल्या डीपफेक व्हीडिओंपैकी 96 टक्के व्हीडिओंमध्ये अश्लील कंटेंट होता.

याशिवाय मनोरंजनासाठीही या तंत्रज्ञानाचा वापर केला जातो. 'प्रत्यक्षात असं काही घडलंच नाही' हे दाखविण्यासाठी या डीपफेक व्हीडिओंचा वापर केला जात होता, जेणेकरून दर्शकांचा यावर विश्वास बसेल.

फोटो स्रोत, MYHERITAGE

अनेक यूट्यूब चॅनलवर विविध चित्रपटांतील दृश्यांचे डीपफेक व्हीडिओ पोस्ट केले जातात.

उदाहरणार्थ, 'द शायनिंग' चित्रपटातील एका प्रसिद्ध दृश्याचा डीपफेक व्हिडिओ कंट्रोल शिफ्ट फेस (Ctrl Shift face) या यूट्यूब चॅनलवर उपलब्ध आहे.

गेल्या काही वर्षांपासून भूतकाळातील गोष्टी (नॉस्टॅल्जिया) जगण्यासाठीही या तंत्रज्ञानाचा वापर केला जात आहे. जसं की, मृत नातेवाईकांच्या छायाचित्रांमध्ये चेहऱ्यांचं ॲनिमेशन केलं जातं.

या वैशिष्ट्याचा वापर करून लोकांनी तंत्रज्ञानाद्वारे त्यांचे पूर्वज आणि ऐतिहासिक व्यक्ती जिवंत केल्या होत्या.

डीपफेकचा वापर आता राजकारणातही होऊ लागला आहे. निवडणुकीत राजकीय पक्ष डीपफेक तंत्रज्ञानाद्वारे एकमेकांवर टीका करतात. युक्रेन-रशिया युद्धादरम्यान काही डीपफेक व्हिडिओ समोर आले होते.

डीपफेक कंटेंट कसा ओळखायचा?

डीपफेक कंटेंट ओळखण्यासाठी, काही विशिष्ट गोष्टींकडे लक्ष देणं खूप महत्वाचं असतं.

त्यांच्यामध्ये पहिल्यांदा चेहऱ्याची स्थिती पाहिली जाते. डीपफेक तंत्रज्ञान अनेकदा चेहरा आणि डोळ्यांमध्ये मार खाते. यात पापण्यांची हालचाल देखील पाहिली जाते.

फोटो स्रोत, Getty Images

जर तुम्हाला असं वाटलं की, डोळे आणि नाक दुसरीकडेच कुठेतरी जात आहेत किंवा बराच वेळ पापण्यांची हालचाल झाली नाही तर समजून जा की हा डीपफेक कंटेंट आहे.

अमुक एखाद्या फोटोत किंवा व्हीडिओत छेडछाड झाली आहे की नाही हे ओळखण्यासाठी रंगसंगती पाहिली जाते आणि त्यावरून डीपफेक कंटेंट ओळखला जातो.

हे वाचलंत का?

(बीबीसी न्यूज मराठीचे सर्व अपडेट्स मिळवण्यासाठी आम्हाला YouTube, Facebook, Instagram आणि Twitter वर नक्की फॉलो करा.

'गोष्ट दुनियेची', 'सोपी गोष्ट' आणि '3 गोष्टी' हे मराठीतले बातम्यांचे पहिले पॉडकास्ट्स तुम्ही Gaana, Spotify आणि Apple Podcasts इथे ऐकू शकता.)