Twitter enquête sur les préjugés raciaux dans les prévisualisations d'images

Crédit photo, US Gov

Twitter mène une enquête après que les utilisateurs ont découvert que son algorithme de recadrage des images préfère parfois les visages blancs aux visages noirs.

Les utilisateurs ont remarqué que lorsque deux photos - l'une d'un visage noir et l'autre d'un visage blanc - se trouvaient dans le même post, Twitter ne montrait souvent que le visage blanc sur le mobile.

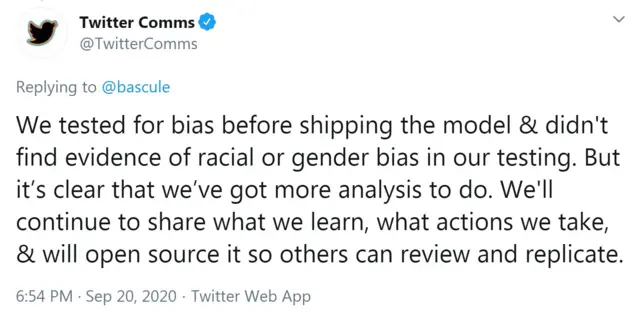

Twitter a déclaré qu'il avait testé les préjugés raciaux et sexistes lors du développement de l'algorithme.

Mais il a ajouté : "Il est clair que nous avons encore des analyses à faire".

Vous pourriez aussi aimer :

Crédit photo, Twitter

Parag Agrawal, le directeur de la technologie de Twitter, a tweeté : "Nous avons analysé notre modèle avant de le mettre en service, mais il doit être amélioré en permanence. J'aime ce test public, ouvert et rigoureux - et je suis impatient d'en tirer les leçons."

La barbe

La dernière controverse a commencé lorsque le directeur de l'université de Vancouver, Colin Madland, rencontré des problèmes avec la tête d'un collègue disparaissait à l'affichage en utilisant l'application de vidéoconférence Zoom.

Le logiciel identifiait apparemment par erreur la tête de l'homme noir comme faisant partie de l'arrière-plan et la supprimait.

Lire aussi :

Mais lorsque M. Madland a publié un article sur le sujet sur Twitter, il a constaté que son visage - et non celui de son collègue - était systématiquement choisie comme aperçu sur les applications mobiles, même s'il inversait l'ordre des images.

Sa découverte a suscité toute une série d'autres expériences de la part des utilisateurs, par exemple :

- Le visage de Mitch McConnell, leader blanc de la majorité au Sénat américain, a été préféré à celui de l'ancien président noir Barack Obama

- une photo d'archive d'un homme blanc en costume a été préférée à celle où l'homme était noir

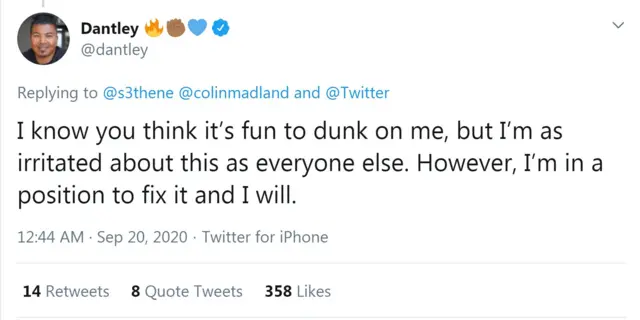

Le responsable de la conception de Twitter, Dantley Davis, a découvert que l'édition de la barbe et des lunettes de M. Madland semblait corriger le problème - "en raison du contraste avec sa peau".

Crédit photo, Twitter

En réponse aux critiques, il a tweeté : "Je sais que vous pensez que c'est amusant de me critiquer - mais je suis aussi en colère que tout le monde à ce sujet. Cependant, je suis en mesure d'y remédier et je le ferai. Nous sommes à 100% responsables. Personne ne devrait dire le contraire."

'De nombreuses questions'

Zehan Wang, directeur de recherche en ingénierie et co-fondateur de la société de réseaux neuronaux Magic Pony, qui a été rachetée par Twitter, a déclaré que les tests de l'algorithme en 2017, utilisant des paires de visages appartenant à différentes ethnies, n'avaient trouvé "aucun biais significatif entre les ethnies (ou les sexes)" - mais Twitter va maintenant réexaminer cette étude.

"Il y a beaucoup de questions qui nécessiteront du temps afin d'être approfondies. Nous partagerons plus de détails après que les équipes internes auront eu l'occasion de procéder à un examen", a-t-il dit

Lire aussi :

À la fin de l'année dernière, une étude du gouvernement américain a suggéré que les algorithmes de reconnaissance faciale étaient beaucoup moins précis quand ils devaient identifier les visages noirs et asiatiques que les visages blancs.

Au Royaume-Uni, les policiers ont exprimé l'an dernier leurs inquiétudes quant aux algorithmes qui "amplifient" les préjugés et ont demandé des directives plus claires sur l'utilisation de cette technologie.

Et, en juin de cette année, des préoccupations similaires ont conduit IBM à annoncer qu'elle ne proposerait plus de logiciel de reconnaissance faciale pour la "surveillance de masse ou le profilage racial".

A regarder :