Лажне вести и истински савезници: Борба у којој мишеви могу да нам помогну

Аутор фотографије, Getty Images

- Аутор, Дејв Ли

- Функција, Репортер из области технологије

- Објављено

- Време читања: 4 мин

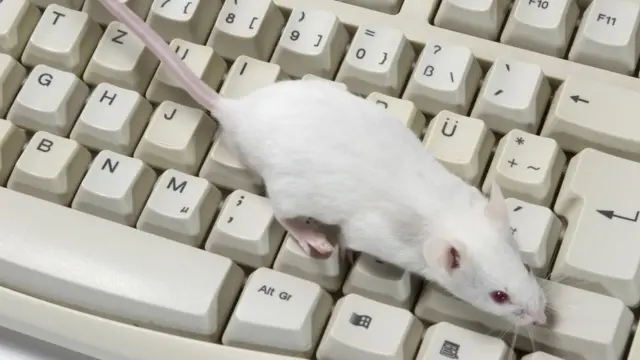

Могуће је да смо открили ново оружје у борби против дезинформација - мишеве.

У склопу сталне борбе против „дип фејкова" - видео и аудио снимака са познатим личностима, насталим уз машинско учење, а прављеним тако да изгледају и звуче аутентично - истраживачи се окрећу новим методама у покушају да буду корак испред ове све заступљеније технологије.

А једна од сулудих идеја управо се тестира на Институту за неуронауку Универзитета у Орегону. Истраживачки тим ради на обучавању мишева како би разумели неправилности у говору, задатак који животиње умеју да изврше са изузетном тачношћу.

Они се надају да ће на крају истраживање моћи да се искористи као помоћ за сајтове попут Фејсбука и Јутјуба у откривању „дип фејкова" пре него што би они могли да се рашире онлајн - мада, да буде сасвим јасно, компанијама неће бити потребни њихови властити мишеви.

„Иако мислим да је идеја о просторији пуној мишева који у реалном времену откривају лажне аудио снимке на Јутјубу заиста слатка", каже Џонатан Сондерс, један од истраживача са овог пројеката, „мислим да то није практично из очигледних разлога."

„Циљ је да научимо лекције како то они раде и онда то применимо на компјутеру."

Категоризација мишева

Сондерс и његов тим уче мишеве да разумеју мали низ фонема, звукова које правимо, а који разликују једну реч од друге.

„Научили смо мишеве да нам укажу на разлику између звукова 'б' и 'г' у гомили различитог контекста, окружене различитим вокалима, тако да препознају 'бо' и 'би' и 'ба' - све те различите суптилне ствари које узимамо здраво за готово."

„И зато што могу да науче тај веома сложени проблем категоризације различитих говорних звукова, мислимо да је могуће обучити мишеве да разликују лажни и прави говор."

Мишеви би добили награду сваки пут кад правилно препознају говорне звукове, што се дешавало у 80 одсто случајева.

То није савршен резултат, али у комбинацији са постојећим методама откривања „дип фејкова" могао би да буде изузетно вредан допринос.

Не можемо да се ослањамо на грешке

Већина „дип фејкова" у употреби данас већ на први поглед нису прави, а обично се користе да би се шалили са субјектом, уместо да га опонашају.

Доказ за то је дип фејк „Марка Закерберга" који нам отворено говори како краде податке корисника.

Али то не значи да уверљиво опонашање неће бити проблем у не тако далекој будућности - због чега је то постала значајна тема разговора на овогодишњем Блек Хету и Деф Кону, двема хакерским конференцијама које се сваке године одржавају у Лас Вегасу.

„Рекао бих да је добра процена да је за обуку дип фејка потребно између 100 и око 500 долара у погледу трошкова коришћења компјутерског облака", рекао је Метју Прајс, из балтиморске фирме за сајбер безбедност Зирофокс.

У овом чланку се појављује садржај Instagram. Молимо вас да дате дозволу пре него што се садржај учита, пошто може да користи колачиће и друге технологије. Можда бисте желели да прочитате Instagram политику колачића и политику приватности пре него што дате пристанак. Да бисте видели овај садржај, одаберите "Прихватите и наставите”.

End of Instagram post

Он је ту да говори о најновијим методама стварања „дип фејкова", али и најсавременијим начинима за њихово откривање.

Прајс је причао о томе како су ефикасне методе до сада биле употреба алгоритама за откривање необичних покрета главом или недоследног осветљења. Један траг откривен међу лоше направљеним „дип фејковима" био је да људи у њима често не трепћу.

Али ове технике ослањају се на то да творци „дип фејкова" праве грешке у раду или на слабости у тренутно доступној технологији. То је луксуз који неће вечно трајати.

„Мало је вероватно да ћемо видети много 'дип фејкова' у предизборној трци за 2020. годину", каже Прајс за ББЦ.

„Али како ова технологија буде наставила да се развија, што нама отежава да откривамо лажњаке, већа је вероватноћа да ћемо их видети како се користе у операцијама утицаја на ток избора."

Ту забринутост већ су изразили амерички политичари високог профила који „дип фејкове" доживљавају као потенцијално нову драматичну ескалацију покушаја да се дезинформишу амерички гласачи.

„Непријатељи Америке већ користе лажне слике да би ширили незадовољство и раздор међу нама", рекао је републикански сенатор Марк Рубио, говорећи за Хил почетком године.

„Е сад, замислите само моћ видео снимка на ком изгледа као да су украдени гласови, непримерени коментари неког политичког вође или убиство невиних цивила у сукобу у иностранству."

'Чип фејк'

Али други сматрају да је опасност од „дип фејка" пренаглашена. Угледни стручњак за сајбер безбедност Брус Шнејер, из харвардске Кенедијеве школе, рекао је да напори усмерени ка откривању „дип фејкова" потпуно промашују суштину.

„Ствари које се деле, које су лажне... Нису чак ни суптилне. А опет се масовно деле, зар не?"

„Проблем није у квалитету лажњака. Проблем је да ми више не верујемо легитимним изворима вести и да делимо ствари због властитог друштвеног идентитета."

Аутор фотографије, Getty Images

Он указује на недавни вирални видео са демократском конгресменком Ненси Пелоси, у ком је аудио снимак измењен у покушају да се она представи као да је пијана. Снимак је брзо оповргнут, али то није било битно - прегледан је више од милион пута.

„То није био дип фејк, већ чип фејк", истиће Шнејер.

„Док год људи гледају видео снимке не због питања 'Да ли је то истина?' већ због питања 'Да ли ово потврђује мој поглед на свет?', онда ће они то да деле... Зато што је то оно шта су они."

И заиста, један став који деле многи експерти овде јесте да би на крају расправа око „дип фејкова" могла да испадне много штетнија него сами „дип фејкови".

Постојање технологије и наше страхове од ње одређени политичари могли би да искористе да убеде гласаче како је нешто што је и те како право заправо само „дип фејк".

Пратите Дејва Лија на Твитеру @DaveLeeBBC