چرا شرکت هوش مصنوعی آنتروپیک به دنبال کارشناس «سلاحهای شیمیایی و مواد منفجره» است؟

منبع تصویر، Getty Images

- نویسنده, زویی کلاینمن

- شغل, سردبیر فناوری، بیبیسی

- زمان مطالعه: ۴ دقیقه

شرکت هوش مصنوعی آنتروپیک به دنبال استخدام یک کارشناس سلاحهای شیمیایی و مواد منفجره با قدرت تخریب بالا است تا از «سوءاستفاده فاجعهبار» از نرمافزارهایش جلوگیری کند.

این شرکت آمریکایی نگران است که ابزارهای هوش مصنوعیاش بتوانند به افراد آموزش دهند که چگونه سلاحهای شیمیایی یا رادیواکتیو بسازند، و به همین دلیل قصد دارد با کمک یک متخصص اطمینان حاصل کند که سازوکارهای حفاظتی آن به اندازه کافی قوی هستند.

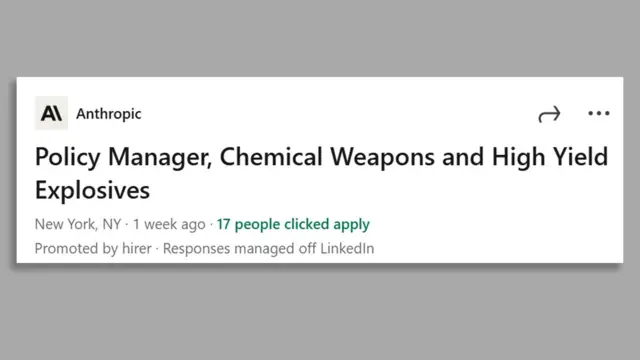

در آگهی استخدامی که در لینکدین منتشر شده، این شرکت اعلام کرده است که متقاضیان باید دستکم پنج سال سابقه در زمینه «دفاع در برابر سلاحهای شیمیایی یا مواد منفجره» داشته باشند و همچنین با «دستگاههای پخش مواد رادیولوژیک» - موسوم به «بمبهای کثیف» - آشنایی داشته باشند.

این شرکت به بیبیسی گفته است که این موقعیت شغلی مشابه نقشهایی است که پیشتر نیز در حوزههای حساس دیگر ایجاد کرده است.

آنتروپیک تنها شرکت فعال در حوزه هوش مصنوعی نیست که چنین رویکردی را دنبال میکند.

شرکت اوپنایآی، سازنده چتجیپیتی، نیز شغلی مشابه را آگهی کرده است. این شرکت در وبسایت فرصتهای شغلی خود، به دنبال پژوهشگری در حوزه «ریسکهای زیستی و شیمیایی» است و برای این شغل حقوق سالانه تا سقف ۴۵۵ هزار دلار پیشنهاد داده است؛ رقمی که تقریبا دو برابر پیشنهاد آنتروپیک است.

با این حال، برخی کارشناسان درباره خطرات این رویکرد ابراز نگرانی کردهاند و هشدار دادهاند که چنین اقداماتی ممکن است به ابزارهای هوش مصنوعی امکان دسترسی به اطلاعات مرتبط با سلاحها را بدهد، حتی اگر به آنها دستور داده شده باشد که از این اطلاعات استفاده نکنند.

دکتر استفانی هر، پژوهشگر حوزه فناوری و از مجریان برنامه تلویزیونی «ایآی دیکودد» بیبیسی، میگوید: «آیا اساسا استفاده از سامانههای هوش مصنوعی برای کار با اطلاعات حساس مربوط به مواد شیمیایی و مواد منفجره - از جمله بمبهای کثیف و دیگر سلاحهای رادیولوژیک - میتواند ایمن باشد؟»

او میگوید: «هیچ معاهده بینالمللی یا مقررات مشخصی برای این نوع فعالیتها و استفاده از هوش مصنوعی در ارتباط با چنین سلاحهایی وجود ندارد. همه این روندها در فضایی دور از دید عمومی در حال انجام است.»

صنعت هوش مصنوعی به شکل مداوم درباره تهدیدهای بالقوه و حتی وجودی ناشی از این فناوری هشدار داده، اما در عین حال هیچ تلاشی برای کند کردن روند پیشرفت آن صورت نگرفته است.

این موضوع در شرایطی اهمیت بیشتری پیدا کرده که دولت آمریکا پس از عملیات نظامی در ونزوئلا و آغاز جنگ با ایران، از شرکتهای هوش مصنوعی نیز درخواست همکاری کرده است.

منبع تصویر، LinkedIn

گزیدهای از مهمترین خبرها، گزارشهای میدانی و گفتوگوهای اختصاصی را هر هفته در ایمیل خود دریافت کنید.

اینجا مشترک شوید

پایان % title %

آنتروپیک در حال پیگیری اقدام حقوقی علیه وزارت دفاع آمریکا است که این شرکت را بهعنوان یک «ریسک در زنجیره تامین» طبقهبندی کرده است. این اقدام وزارت دفاع پس از آن صورت گرفت که این شرکت تاکید کرد سامانههایش نباید در سلاحهای کاملا خودکار یا برای نظارت گسترده بر شهروندان آمریکایی استفاده شوند.

داریو آمودی، یکی از بنیانگذاران آنتروپیک، در ماه فوریه نوشته بود که این فناوری هنوز به اندازه کافی پیشرفته نیست و نباید برای چنین اهدافی به کار گرفته شود.

کاخ سفید اعلام کرده است که ارتش آمریکا تحت حاکمیت شرکتهای فناوری قرار نخواهد گرفت.

قرار گرفتن در فهرست «ریسک» باعث شده این شرکت آمریکایی در موقعیتی مشابه با شرکت مخابراتی چینی هواوی قرار گیرد که به دلایل متفاوتی در حوزه امنیت ملی در فهرست سیاه قرار گرفته بود.

شرکت اوپنایآی اعلام کرده که با موضع آنتروپیک موافق است، اما در عین حال قرارداد جداگانهای با دولت آمریکا امضا کرده که به گفته این شرکت هنوز اجرایی نشده است.

دستیار هوش مصنوعی آنتروپیک، موسوم به «کلود»، هنوز از رده خارج نشده است. این ابزار هماکنون در سامانههای شرکت پالانتیر تعبیه شده و آمریکا آن را در جنگ با ایران به کار گرفته است.