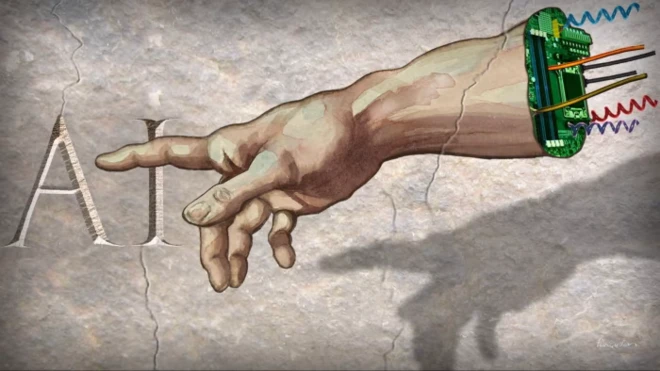

هل يمكننا التمييز بين التحدّث إلى البشر أو الذكاء الاصطناعي؟

صدر الصورة، Jesussanz/Getty Images

- Author, ديزي ستيفنز

- Role, بي بي سي

- مدة القراءة: 6 دقائق

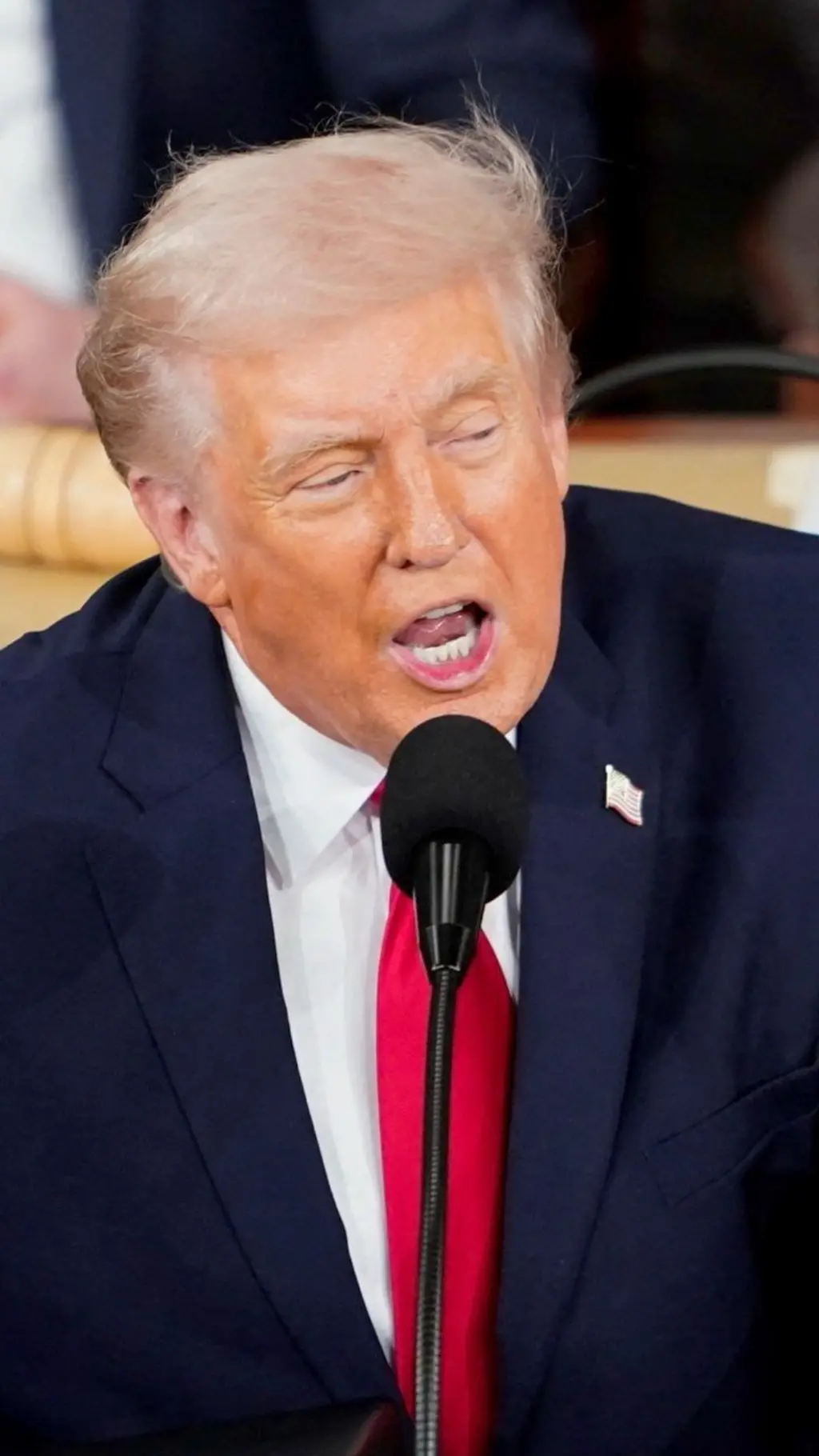

هل يمكننا التمييز بين ما إذا كنا نتحدث إلى إنسان آخر أم إلى ذكاء اصطناعي؟ لطالما كان هذا أحد الأسئلة التي يطرحها الناس عند تقييم مدى ذكاء الحواسيب فعلياً.

ويعود أصل هذا التساؤل إلى اختبار تورينغ، الذي وضعه عالم الرياضيات وعلوم الحاسوب الإنجليزي آلان تورينغ عام 1950، محوّلاً التفكير الفلسفي حول ذكاء الآلة إلى اختبار تجريبي للمرة الأولى.

وبحسب هذا الاختبار، إذا كان سلوك الحاسوب غير قابل للتمييز عن سلوك الإنسان، فإنه يُعدّ حينها مظهراً من مظاهر "السلوك الذكي".

صدر الصورة، Pictures from History/Universal Images Group via Getty Images

لكن عندما قيل إن روبوت محادثة يعمل بالذكاء الاصطناعي قد اجتاز الاختبار لأول مرة في عام 2014 - بدلاً من أن تكون لحظة فاصلة، فقد أثارت جدلاً واسعاً.

لعبة تقليد

واختبار تورينغ هو لعبة تقليد، يتواصل فيها شخص عبر النص مع إنسان آخر وحاسوب.

يُسمح له بطرح أي أسئلة يشاء، قبل أن يُطلب منه في النهاية تحديد أيهما الإنسان وأيهما الآلة.

وقال الدكتور كاميرون جونز، الأستاذ المساعد في علم النفس بجامعة ستوني بروك في نيويورك: "قال تورينغ إنه إذا لم يتمكن الناس من التمييز بشكل موثوق بين البشر والآلات، فلن تكون لدينا أي أسس للقول إن الإنسان قادر على التفكير بينما الآلة غير قادرة على ذلك".

وكان تورينغ قد توقع أنه بحلول عام 2000، ستصبح الحواسيب قادرة على اجتياز هذا الاختبار والتظاهر بأنها بشر، بعد خمس دقائق من الأسئلة، في ما لا يقل عن 30 في المئة من الحالات.

صدر الصورة، Getty Images

"عدم اللعب بنزاهة"

في عام 2014، نجح روبوت محادثة يعمل بالذكاء الاصطناعي يُدعى يوجين غوستمان في إقناع 33 في المئة من الحكام بأنه إنسان ضمن اختبار تورينغ، متجاوزاً العتبة التي حددها منظمو المسابقة.

وكان الروبوت يتواصل باللغة الإنجليزية، متقمصاً شخصية فتى أوكراني يبلغ من العمر 13 عاماً.

وقال الدكتور ماركوس بانتسار، الفيلسوف والمحاضر الزائر في جامعة الراين-الويستفالية التقنية في آخن، إن هذا يعني أن الروبوت "لم يكن يلعب اللعبة بنزاهة".

وأضاف: "إن أوجه القصور لدى روبوت المحادثة تتوافق إلى حد ما مع أوجه القصور المتوقعة في اللغة الإنجليزية لدى فتى أوكراني مراهق".

صدر الصورة، VCG via Getty Images

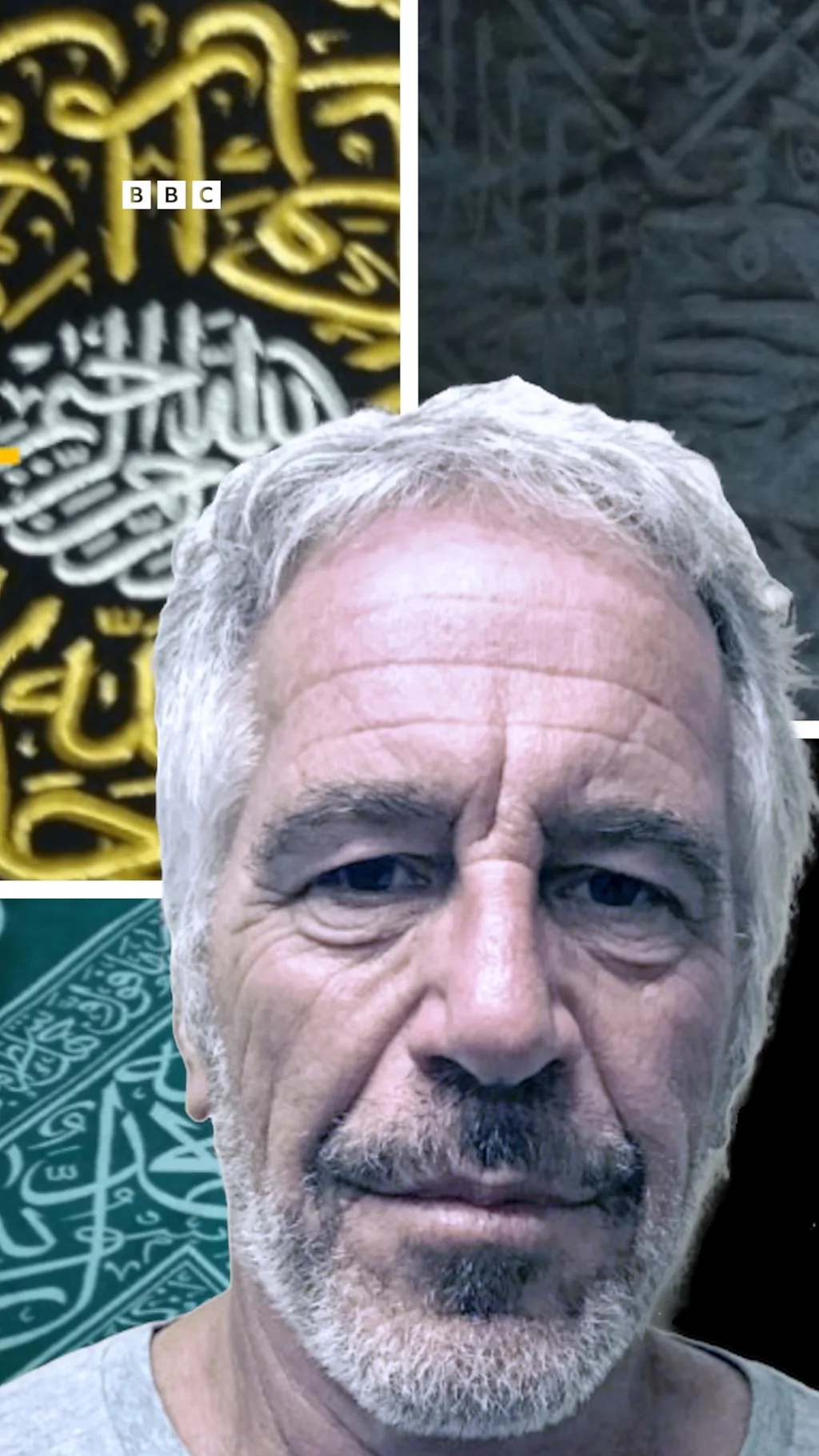

في ورقة بحثية نُشرت مطلع عام 2025، توصل جونز إلى أن شات جي بي تي 4.5، التابع لشركة أوبن إيه آي، صُنِف على أنه إنسان في 73 في المئة من الحالات، أي بنسبة تفوق تصنيف النظير البشري نفسه.

في المقابل، صُنّف نموذج لاما 3.1، التابع لشركة ميتا، على أنه إنسان في 56 في المئة من الحالات.

وقال جونز: "أعتقد أنه من الصعب المجادلة بأن هذه النماذج لم تجتَزْ الاختبار، ما دامت تُقيَّم على أنها بشر بمعدل يفوق البشر أنفسهم بشكل ملحوظ".

ومع ذلك، لا يزال بعض الباحثين متشككين في ما إذا كانت هذه النتائج تُثبت فعلاً أن الحواسيب قادرة على التفكير الحقيقي.

حجة الغرفة الصينية

في عام 1980، طرح الفيلسوف جون سيرل تجربة فكرية عُرفت باسم "حجة الغرفة الصينية".

وتقوم الفكرة على الآتي: يُحتجز رجل إنجليزي لا يفهم اللغة الصينية داخل غرفة، وبحوزته مجموعة من الرموز الصينية وتعليمات مكتوبة بالإنجليزية توضّح كيفية استخدامها، ويقوم أشخاص خارج الغرفة بتمرير ملاحظات إليه تحتوي على أسئلة مكتوبة بالصينية، فيستخدم التعليمات لتكوين ردود مكتوبة بالصينية أيضاً.

وبالنسبة لمن هم خارج الغرفة، سيبدو وكأن الرجل يتحدث الصينية، لكنه في الحقيقة لا يفهم ما يقوله. ويرى بعض الفلاسفة أن الأمر نفسه يمكن أن ينطبق على الحواسيب، التي لا تفهم المعنى فعلياً، بل تُبرمج فقط لإعطاء ردود مناسبة.

صدر الصورة، Malte Mueller/Getty Images

قال جورج مابوراس، وهو مهندس برمجيات مقيم في كاليفورنيا طوّر بدوره بديلاً خاصاً لاختبار تورينغ: "على الرغم من أن اختبار تورينغ يدّعي أنه يحدد الذكاء، فإنه في الأساس يحاول معرفة ما إذا كانت الآلة قادرة على محاكاة البشر بشكل جيد بما يكفي".

وطرح مثالاً لتوضيح فكرته، قائلاً: "يمكنك فتح أي روبوت محادثة يعمل بالذكاء الاصطناعي، وأن تطلب منه أولاً شرح كيفية عمل الساعة التناظرية، وسيقدّم شرحاً دقيقاً".

لكن إذا طلبت منه توليد صورة لساعة تُظهر وقتاً محدداً، فمن المرجح أن تفشل نماذج الذكاء الاصطناعي الحالية في ذلك، وأضاف: "هو في الواقع لا يفهم المعلومات حقاً".

ويرى آخرون، مثل بانتسار، أن اختبار تورينغ يضع تركيزاً مفرطاً على قدرة الحاسوب على خداع المحكّم.

وقال: "السلوك الذكي الحقيقي قد يتضمن الخداع، لكن هذا ليس جوهر الذكاء في الأساس".

اختبارات بديلة

طرح بانتسار اختباراً بديلاً يُعرف باسم اختبار الذكاء القائم على المجتمع، وهو واحد من بين عدة بدائل اقتُرحت على مر السنوات.

وعلى خلاف اختبار تورينغ القائم على المختبرات، يقوم سيناريو بانتسار على وضع نظام ذكاء اصطناعي داخل مجتمع قائم بالفعل - مثل مجتمع إلكتروني لعلماء الرياضيات - من دون علم أفراده، وبعد فترة من الزمن، يختبر أعضاء المجتمع لمعرفة ما إذا كانوا قد اكتشفوا أنه آلة أم لا.

ورغم بقاء قدر من الخداع، يرى بانتسار أن جوهر الاختبار يتمثل في أن يتصرف النظام "بطريقة تشبه الحياة البشرية"، لا أن "ينتحل شخصية إنسان"، معتبراً أن هذا فارق مهم.

وقال الفيلسوف: "يجب تقييم الذكاء في ظروف طبيعية، أي في البيئات التي ننخرط فيها فعلياً".

وأضاف أن اختباره يشجع المطورين على التركيز على مدى فائدة نظام الذكاء الاصطناعي عند تصميمه، بدل التركيز على قدرته على اجتياز اختبار قائم على الخداع من عدمه.

في المقابل، طور مابوراس اختباراً مختلفاً، قال إنه يعتمد على مقياس أكثر واقعية للذكاء، ويرى أن الوصول إلى الذكاء الاصطناعي العام - وهو مفهوم نظري يشير إلى آلة تمتلك القدرة الذهنية نفسها التي لدى الإنسان - سيكون ممكناً عندما تتمكن الآلة من "ابتكار معرفة علمية جديدة وشرحها"، شريطة أن يكون لديها مسبقاً جميع المعلومات اللازمة لذلك.

صدر الصورة، Oscar Wong/Getty Images

على الرغم من الانتقادات، يرى بعض الباحثين أن اختبار تورينغ لا يزال يحتفظ بمكانته في أبحاث الذكاء الاصطناعي الحديثة.

وقال جونز إن طبيعته المفتوحة وعدم تحديد الأسئلة بشكل صارم يتيحان له اختبار "نوع من الذكاء الديناميكي والمرن".

وأضاف: "إذا استبدلنا ذلك بمجرد معيار ثابت آخر، فأعتقد أننا نسيء فهم ما كان تورينغ يسعى إليه".

معركة خاسرة

بقطع النظر عن الاختبار المستخدم، يرى بانتسار أنه مع استمرار تطور أنظمة الذكاء الاصطناعي، من المرجح أن تصبح غير قابلة للتمييز عن البشر.

وقال: "في نهاية المطاف، هذه معركة خاسرة نخوضها".

ويجادل بأن إثبات ذلك من شأنه أن يبرر الحاجة إلى أطر قانونية تُلزم أنظمة الذكاء الاصطناعي بالإفصاح عن كونها ذكاءً اصطناعياً، وذلك لأسباب تتعلق بالمساءلة.

وأضاف: "لو نشرت بحثاً يتضمن بيانات خاطئة، فأنا المسؤول عن ذلك. أما إذا كان البحث مكتوباً بواسطة ذكاء اصطناعي، فلا يكون هناك أحد يتحمل المسؤولية".

صدر الصورة، 10'000 Hours/Getty Images

ويرى جونز أن من المهم قياس مدى قدرة الآلة على محاكاة الإنسان، ما يجعل اختبار تورينغ لا يزال ذا صلة في الوقت الحاضر.

وقال: "نقضي وقتاً طويلاً في التفاعل مع أشخاص عبر الإنترنت". وأضاف: "وبشكل متزايد، بدأ الناس يختبرون تجربة الدخول في جدال مع حساب على تويتر، ثم يدركون فجأة: في الواقع، أنا لا أتحدث إلى إنسان".

وتابع: "أحد الأمور التي أعتقد أن اختبار تورينغ يقدمها هو تتبع هذه القدرة، أي قياس مدى احتمال حدوث مثل هذا الأمر".