Фейкові відео від ШІ про війну Ірану та Ізраїля набирають мільйони переглядів. До чого тут Росія

- Author, Метт Мерфі, Ольга Робінсон, Шаян Сардарізаде

- Role, BBC Verify

- Published

- Час прочитання: 6 хв

Хвиля дезінформації заполонила інтернет з моменту, коли Ізраїль минулого тижня розпочав удари по Ірану. BBC Verify проаналізувала десятки публікацій, які намагаються посилити уявлення про ефективність відповіді Тегерана.

Аналіз виявив низку відео, створених за допомогою штучного інтелекту, які вихваляють військові можливості Ірану, а також фейкові ролики, що нібито демонструють наслідки ударів по ізраїльських цілях. Три найпопулярніші фейкові відео, виявлені BBC Verify, сукупно зібрали понад 100 мільйонів переглядів на різних платформах.

Проізраїльські акаунти також поширювали дезінформацію онлайн — здебільшого публікуючи старі кадри протестів і зібрань в Ірані, неправдиво стверджуючи, що вони свідчать про зростання невдоволення владою та підтримку ізраїльської воєнної кампанії серед іранців.

Ізраїль завдав ударів по Ірану 13 червня, що призвело до кількох хвиль іранських ракетних і дронових атак на Ізраїль.

Автор фото, Getty Images

Одна з організацій, що аналізує зображення з відкритих джерел, назвала обсяг дезінформації в інтернеті "вражаючим" і звинуватила деяких так званих "фермерів з охоплення" у прагненні нажитися на конфлікті, поширюючи оманливий контент, створений для привернення уваги в мережі.

"Ми бачимо все — від нерелевантних кадрів з Пакистану до перероблених відео з жовтневих ударів 2024 року — деякі з них набрали понад 20 мільйонів переглядів, а також ігрові ролики й контент, згенерований ШІ, що подається як реальні події", — написала у X (раніше Twitter) група онлайн-верифікації Geoconfirmed.

Деякі акаунти стали справжніми "суперрозповсюджувачами" дезінформації та отримали суттєве зростання кількості підписників. Один проіранський акаунт, який не має очевидних зв'язків із владою в Тегерані — Daily Iran Military — збільшив кількість підписників у X з трохи більше ніж 700 000 (на 13 червня) до 1,4 мільйона (на 19 червня), тобто на 100% менш ніж за тиждень.

Це лише один із багатьох маловідомих акаунтів, які нещодавно почали з'являтися у стрічках користувачів. Усі мають синю галочку, активно публікують повідомлення і неодноразово поширюють дезінформацію. Через використання нібито офіційних назв деякі користувачі сприймають їх як справжні акаунти, однак незрозуміло, хто саме ними керує.

Цей потік дезінформації, за словами Еммануель Саліба, головної аналітикині з розслідувань групи Get Real, став "першим випадком масового використання генеративного ШІ під час збройного конфлікту", як вона повідомила BBC Verify.

Автор фото, Getty Images

Як дізнатися головне про Україну та світ?

Підписуйтеся на наш канал тут.

Кінець Whatsapp

Акаунти, проаналізовані BBC Verify, регулярно поширювали згенеровані ШІ зображення, які, ймовірно, покликані перебільшити успішність відповіді Ірану на удари Ізраїлю. Одне з таких зображень, яке набрало 27 мільйонів переглядів, демонструвало десятки ракет, що нібито падають на місто Тель-Авів.

Інше відео нібито показувало ракетний удар по будівлі в одному з ізраїльських міст уночі. Пані Саліба зазначила, що подібні ролики часто зображають нічні атаки, що ускладнює їхню перевірку.

Фейки, створені ШІ, також зосереджувалися на заявленому знищенні ізраїльських винищувачів F-35 — сучасного американського літака, здатного вражати цілі в повітрі та на землі. Якби ці відео були правдивими, Іран знищив би 15% ізраїльського парку цих винищувачів, розповіла BBC Verify Ліза Каплан, директорка аналітичної групи Alethea. Проте на сьогодні ще жодного підтвердженого відео з ураженням F-35 не існує.

Один широко розповсюджений допис нібито показував літак, який зазнав пошкодження після того, як його збили в іранській пустелі. Однак ознаки ШІ-маніпуляції були очевидні: цивільні навколо літака мали такий самий розмір, як і автомобілі поруч, а на піску не було жодних слідів удару.

Ще одне відео, яке набрало 21,1 мільйона переглядів у TikTok, стверджувало, що ізраїльський F-35 був збитий системами ППО, але насправді кадри походили з відеогри-авіасимулятора. Після звернення BBC Verify TikTok видалив це відео.

Пані Каплан зазначила, що частина фокусування на F-35 пов'язана з мережею акаунтів, які аналітична група Alethea раніше пов'язувала з операціями впливу з боку Росії.

Вона зауважила, що останнім часом російські операції з дезінформації змістили акцент з підриву підтримки війни в Україні на посівання сумнівів щодо ефективності західного — зокрема американського — озброєння.

"У Росії фактично немає відповіді на F-35. Тож що їй залишається? Вона може намагатися підірвати підтримку цього літака в окремих країнах", — пояснила Каплан.

Дезінформацію також поширюють відомі акаунти, які раніше вже висловлювались щодо війни Ізраїлю проти Гази та інших конфліктів. Їхні мотиви різні, але, за словами експертів, деякі з них можуть намагатися монетизувати конфлікт, оскільки великі соціальні платформи пропонують виплати акаунтам, що набирають багато переглядів.

Натомість проізраїльські публікації здебільшого зосереджуються на твердженнях, що іранський уряд стикається з дедалі більшим невдоволенням на тлі безперервних ударів.

Серед них — широко поширене фейкове відео, згенероване ШІ, яке неправдиво демонструє, нібито іранці скандують "ми любимо Ізраїль" на вулицях Тегерана.

Втім, останніми днями — на тлі зростаючих спекуляцій про можливі удари США по ядерних об'єктах Ірану — деякі акаунти почали публікувати зображення, згенеровані ШІ, із літаками-невидимками B-2 над Тегераном.

B-2 привернув пильну увагу з моменту початку ізраїльських ударів по Ірану, оскільки це єдиний літак, здатний ефективно атакувати підземні іранські ядерні об'єкти.

Офіційні джерела в Ірані та Ізраїлі також поширювали деякі фейкові зображення. Державні ЗМІ Тегерана розповсюджували фейкові відео ударів та зображення збитого F-35, згенероване ШІ. Водночас один із дописів Армії оборони Ізраїлю (ЦАХАЛ) у X отримав примітку спільноти за використання старих, не пов'язаних із подіями кадрів ракетних обстрілів.

Значна частина дезінформації, яку проаналізувала BBC Verify, була поширена в X. Користувачі часто зверталися до чат-бота з ШІ на платформі — Grok — щоб перевірити правдивість дописів.

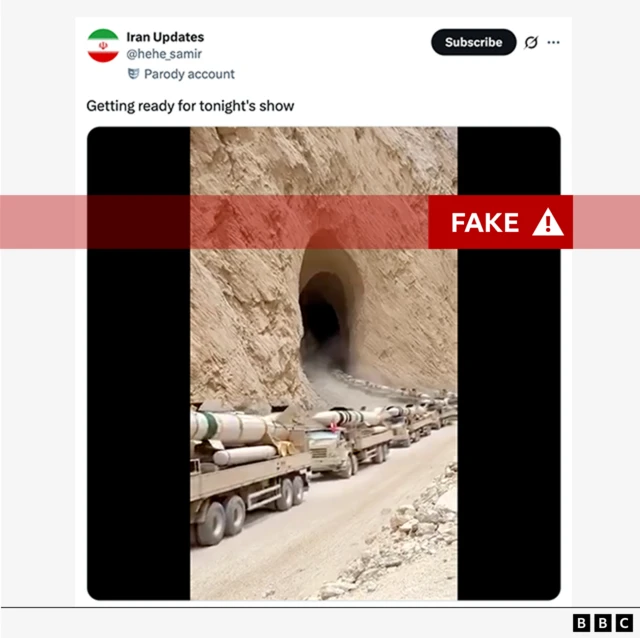

Однак у деяких випадках Grok наполягав, що відео, згенеровані ШІ, є справжніми. Одне з таких відео показувало нескінченний потік вантажівок з балістичними ракетами, що виїжджають з підземного комплексу в горах. За словами пані Саліба, типовими ознаками ШІ-контенту були, зокрема, скелі, які рухалися самі по собі.

Проте у відповідь користувачам X чат-бот Grok неодноразово наполягав, що відео є справжнім, і посилався на повідомлення таких медіа, як Newsweek та Reuters. У кількох повідомленнях бот робив висновок: "Звертайтеся до авторитетних джерел новин для ясності".

X не відповіла на запит BBC Verify щодо дій чат-бота.

Багато відео також з'явилися в TikTok та Instagram. У своїй заяві для BBC Verify компанія TikTok повідомила, що проактивно застосовує правила спільноти, "які забороняють неточний, оманливий або неправдивий контент", і що вона співпрацює з незалежними фактчекерами, щоб "перевіряти дезінформацію".

Власник Instagram, компанія Meta, не відповіла на запит про коментар.

Хоча мотиви творців фейкового онлайн-контенту різні, багато таких матеріалів поширюють звичайні користувачі соцмереж.

Меттью Фачіані, дослідник з Університету Нотр-Дам, припустив, що дезінформація може швидше поширюватися в інтернеті, коли користувачі стикаються з бінарними виборами — такими, які часто виникають під час конфліктів або в політиці.

"Це пов'язано з ширшою соціально-психологічною проблемою: люди хочуть поширювати те, що відповідає їхній політичній ідентичності, а також — загалом — сенсаційний емоційний контент поширюється в мережі значно швидше".