صدای قربانیان خشونت؛ «خاله هوش مصنوعی» که در نتیجه تراژدی خانوادگی ساخته شد

منبع تصویر، Grit

- نویسنده, مگا موهان

- شغل, بیبیسی جهانی

- زمان مطالعه: ۸ دقیقه

قتل فجیعی در خانواده، الهامبخش لئونورا تیما شد تا بستری دیجیتالی ایجاد کند که در آن افراد، عمدتا زنان، بتوانند درباره تجربههای خشونت صحبت کنند و موارد آزار را ثبت و پیگیری کنند.

هدف از اینکار، حمایت از قربانیان و فراهم کردن امکانی برای گردآوری شواهد و مدارکی است که بتوانند بعدها در پروندههای قضایی آزارگران استفاده شود.

یکی از بستگان لئونورا تنها ۱۹ سال داشت و نه ماهه باردار بود که سال ۲۰۲۰ در نزدیکی کیپتاون آفریقای جنوبی به قتل رسید. جسد او در کنار بزرگراهی رها شده بود.

لئونورا میگوید: «من در حوزه توسعه کار میکنم و با خشونت بیگانه نیستم، اما نکته تکاندهنده ماجرا این بود که مرگ خشونتآمیز یکی از اعضای خانوادهام در جامعه آفریقای جنوبی بهقدری عادی تلقی شد که کسی تعجب نکرد.»

«داستان مرگ او در هیچ رسانهای منتشر نشد، چون تعداد این نوع پروندهها در کشور ما آنقدر زیاد است که دیگر خبر محسوب نمیشود.»

قاتل هرگز دستگیر نشد و همین بیتفاوتی جامعه در برابر قتل خشونتآمیز یک زن، انگیزهای شد برای لئونورا تا اپلیکیشن خود را با نام حقوق جنسیتی در فناوری (جندر رایتس این تِک) یا به اختصار «گریت» طراحی کند.

لئونورا و تیم کوچکش به جوامع مختلف در مناطق اطراف محل زندگیشان در کیپتاون رفتند و با ساکنان درباره تجربیاتشان از خشونت و نقش فناوری در زندگیشان گفتوگو کردند.

آنها با بیش از ۸۰۰ نفر مصاحبه کردند و پرسیدند که چگونه از تلفنهای همراه و شبکههای اجتماعی برای صحبت درباره خشونت استفاده میکنند و چه عواملی مانع از آن میشود که برای دریافت کمک اقدام کنند.

منبع تصویر، Grit

گزیدهای از مهمترین خبرها، گزارشهای میدانی و گفتوگوهای اختصاصی را هر هفته در ایمیل خود دریافت کنید.

اینجا مشترک شوید

پایان % title %

خانم تیما متوجه شد که مردم مایلند درباره آزارهایی که تجربه کردهاند صحبت کنند اما «میترسند سراغ مسیرهای سنتی مانند مراجعه به پلیس بروند.»

او میگوید: «بعضی زنان درباره تجربه آزارشان در فیسبوک مطلب میگذاشتند و حتی فرد آزارگر را تگ میکردند ولی در نهایت به جرم افترا با شکایت همان فرد روبرو میشدند.»

لئونورا احساس کرد که سیستمهای موجود قربانیان را دو بار ناکام میگذارند: یکبار با ناتوانی در جلوگیری از وقوع خشونت و بار دیگر زمانی که قربانیان تلاش میکنند صدای خود را به دیگران برسانند.

با حمایت مالی و فنی از سوی موزیلا، بنیاد گیتس و بنیاد پاتریک مکگاورن، لئونورا و تیمش توسعه اپلیکیشن گریت را آغاز کردند. برنامهای موبایلی که میتواند به افراد کمک کند در هنگام وقوع آزار، آن را ثبت، گزارش و پیگیری کنند.

این اپلیکیشن رایگان است، هرچند برای دانلود شدن نیاز به اینترنت موبایل دارد. تیم لئونورا میگوید تاکنون ۱۳ هزار کاربر دارد و تنها در ماه سپتامبر حدود ۱۰ هزار درخواست کمک دریافت کرده است.

«گریت» بر پایه سه ویژگی کلیدی ساخته شده است.

در صفحه اصلی، یک دکمه بزرگ دایرهای با عنوان «درخواست کمک» وجود دارد که با فشردن آن، اپلیکیشن بهطور خودکار ۲۰ ثانیه صدای محیط را ضبط میکند تا آنچه در اطراف کاربر رخ میدهد، ثبت شود. همزمان، هشدار به یک مرکز تماس اضطراری خصوصی ارسال میشود. در آفریقای جنوبی، شرکتهای پاسخگویی سریع حرفهای رایج هستند. اپراتور آموزشدیده بلافاصله با کاربر تماس میگیرد و اگر خطر فوری وجود داشته باشد، نیروهای امداد یا سازمان محلی مرتبط را برای کمک اعزام میکند.

لئونورا میگوید که این اپلیکیشن با در نظر گرفتن نیازهای نجاتیافتگان از آزار طراحی شده است: «باید اعتماد مردم را به دست آوریم. این گروهها اغلب نادیده گرفته میشوند. وقتی از مردم میخواهیم دادههای خود را به اشتراک بگذارند، در واقع داریم درخواست بزرگی را مطرح میکنیم.»

منبع تصویر، Grit

وقتی از لئونورا پرسیده شد که تا کنون از قابلیت «درخواست کمک» سوءاستفاده شده یا نه، میگوید که چند بار دکمه صرفا از سر کنجکاوی فشرده شده و افرادی فقط میخواستند ببینند آیا این واقعا کار میکند یا نه ولی هیچ موردی نبوده که بتوان آن را «سوءاستفاده از سیستم» نامید.

او گفت: «مردم محتاط هستند. همانطور که ما در حال آزمودن فناوری هستیم، آنها هم در حال امتحان کردن ما هستند.»

دومین بخش این اپلیکیشن «خزانه» نام دارد: فضایی دیجیتال و امن که کاربران میتوانند شواهد مربوط به آزار را (با تاریخ ثبت و رمزگذاریشده) در آن ذخیره کنند تا بعدها در روندهای قضایی مورد استفاده قرار گیرد.

کاربران میتوانند تصاویر، عکسهای صفحه نمایش و صداهای ضبط شده خود را در این فضا بارگذاری و بهصورت خصوصی ذخیره کنند تا از حذف یا دستکاری در امان بمانند. این مدارک میتوانند در آینده در پروندههای قانونی به کار گرفته شوند.

لئونورا میگوید: «گاهی زنان از جراحات خود عکس میگیرند یا پیامهای تهدیدآمیز را ذخیره میکنند ولی ممکن است این مدارک حذف یا گم شوند. وجود خزانه به این معناست که شواهد و مدارک فقط روی گوشی نباشد که ممکن است ضبط یا نابود شود.»

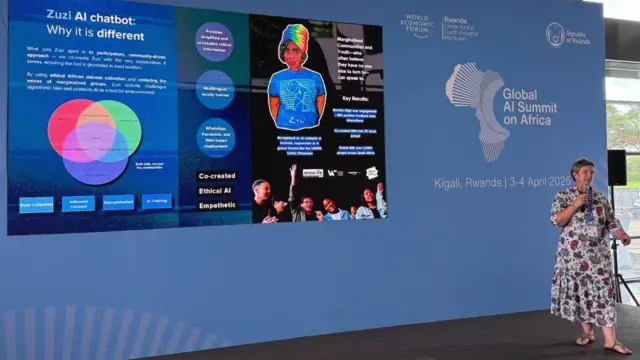

«گریت» در نوامبر، با معرفی سومین قابلیت خود دوباره گسترش مییابد: زوزی، یک چتبات مبتنی بر هوش مصنوعی است که طراحی شده تا به کاربران گوش دهد، به آنها مشاوره دهد و راهنماییشان کند تا به حمایتهای محلی و اجتماعی دسترسی پیدا کنند.

لئونورا میگوید: «از مردم پرسیده شده: بهتر است زوزی زن باشد یا مرد؟ ربات باشد یا شبیه انسان؟ صدایش شبیه وکیل باشد، مددکار اجتماعی، روزنامهنگار یا یک مقام رسمی؟»

مردم به آنها گفتند که میخواهند زوزی، شبیه یک «خاله» باشد؛ فردی گرم، قابل اعتماد و صمیمی که بتوانند بدون ترس از قضاوت با او درد دل کنند.

منبع تصویر، Grit

گرچه «زوزی» برای زنان قربانی خشونت طراحی شده است، ولی در مرحله آزمایشی مردان نیز از آن برای دریافت کمک استفاده کردهاند.

لئونورا میگوید: «بعضی از گفتوگوها را آزارگران انجام دادهاند. مردانی که خود عامل خشونت بودند، از زوزی خواستهاند به آنها یاد بدهد چطور میتوانند با مشکلات خشم خود کنار بیایند، خشمی که اغلب متوجه شریک زندگیشان میشود.»

«همچنین مردانی هستند که خودشان قربانی خشونت شدهاند و از زوزی برای صحبت آزادانهتر درباره تجربهشان استفاده کردهاند. مردم دوست دارند با هوش مصنوعی حرف بزنند، چون احساس نمیکنند که قضاوت میشوند. این یک انسان نیست.»

بر اساس آمار سازمان زنان سازمان ملل، حدود ۷۳۶ میلیون زن در سراسر جهان (تقریبا یک زن از هر سه زن در سراسر دنیا) مورد خشونت جسمی یا جنسی قرار گرفتهاند. این آمار شامل آزار جنسی نمیشود و نشاندهنده ابعاد جهانی این بحران است.

بر اساس دادههای سازمان ملل متحد برای زنان، حدود ۷۳۶ میلیون زن، نزدیک به یکسوم زنان جهان، قربانی خشونت فیزیکی یا جنسی شدهاند. این آمار، آزار جنسی را شامل نمیشود و نشاندهنده ابعاد جهانی بحران است.

بسیاری از کارشناسان، از جمله لیزا وتن، متخصص خشونت مبتنی بر جنسیت در آفریقای جنوبی، معتقدند که استفاده از فناوری برای مقابله با این بحران اجتنابناپذیر است.

با این حال، او درباره استفاده از هوش مصنوعی در مراقبتهای مرتبط با تروما و آسیبهای روانی هشدار میدهد: «این ابزارها را مدلهای زبانی بزرگ مینامم، نه هوش مصنوعی، چون در واقع فقط به تحلیل و پیشبینی زبانی میپردازند، نه بیشتر.»

او قبول دارد که سیستمهای هوش مصنوعی میتوانند در برخی موارد مفید باشند اما نمونههایی را میشناسد که در آنها چتباتهای دیگر به زنان توصیههای اشتباه کردهاند: «وقتی میبینم این سیستمها با اطمینان زیاد به زنان پاسخهای حقوقی میدهند، نگران میشوم. چتباتها میتوانند اطلاعات مفیدی ارائه کنند اما قادر به درک و مدیریت مشکلات پیچیده و چندوجهی نیستند.»

«مهمتر از همه این که نباید به عنوان جایگزین مشاوره انسانی در نظر گرفته شوند. افرادی که آسیب دیدهاند باید کمکهایی دریافت کنند تا بتوانند دوباره به انسانها اعتماد کنند و در کنار آنها احساس امنیت داشته باشند.»

منبع تصویر، @judith.Litvine/MEAE

رویکرد گریت توجه جهانیان را جلب کرده است. لئونورا و تیمش در ماه اکتبر اپلیکیشن خود را در «کنفرانس سیاست خارجی فمینیستی» که به میزبانی دولت فرانسه در پاریس برگزار شد، معرفی کردند. جایی که شماری از رهبران جهانی گرد هم آمدند تا درباره چگونگی استفاده از فناوری و سیاست برای ساختن جهانی با برابری جنسیتی بیشتر گفتوگو کنند.

در این کنفرانس، نمایندگان ۳۱ کشور تعهدنامهای امضا کردند تا مقابله با خشونت مبتنی بر جنسیت را به یکی از اولویتهای اصلی سیاستگذاری خود تبدیل کنند.

لیرک تامپسون، بنیانگذار و مدیرعامل «همکاری سیاست خارجی فمینیستی»، میگوید: «بحثها درباره استفاده از هوش مصنوعی داغ است ولی به محض اینکه سعی کنید مسئله جنسیت را وارد گفتوگو کنید و خطرات تعصبهای نژادپرستانه، جنسیتی و بیگانهستیزانهای که در آن نهفته است را مطرح کنید، چشمها از کاسه بیرون میزند و ادامه صحبت غالبا به راهروهای پشتی منتقل میشود که هیچ زنی حضور نداشته باشد تا این موضوع را پیش بکشد.»

هدر هربرت، متخصص هوش مصنوعی و کاربرد آن در فناوری، قبول دارد که هوش مصنوعی «توان بالقوه عظیمی دارد که یا به شناسایی و اصلاح تبعیضهای جنسیتی و خشونت مبتنی بر جنسیت کمک کند، یا زنستیزی و نابرابری را تقویت نماید» اما این که کدام مسیر را انتخاب کنیم، «کاملا به خودمان بستگی دارد.»

لئونورا صراحتا میگوید که موفقیت هوش مصنوعی در مقابله با خشونت مبتنی بر جنسیت تنها به مهندسی بستگی ندارد، بلکه به این هم مربوط است که چه کسانی پشت طراحی فناوری هستند.

گزارش مجمع جهانی اقتصاد در سال ۲۰۱۸ نشان داد که تنها ۲۲ درصد از متخصصان هوش مصنوعی در جهان زن هستند، آماری که هنوز هم اغلب مورد استناد قرار میگیرد.

لئونورا میگوید: «هوش مصنوعی همانطور که امروزه میشناسیم، بر اساس دادههای تاریخی ساخته شده که صدای مردان و بهویژه مردان سفیدپوست را محور قرار میدهد.»

«راهحل فقط داشتن تعداد بیشتری از زنان در حوزه فناوری نیست. باید زنان رنگینپوست، زنانی از نیمکره جنوبی جهان و از طبقات کمبرخوردارتر در زمینههای اقتصادی و اجتماعی هم در میان خالقان فناوری باشند.»

لئونورا تیمز در پایان نتیجه میگیرد: «تنها در آن زمان است که فناوری میتواند بازتابدهنده واقعیتهای زندگی افرادی باشد که از آن استفاده میکنند.»